差分放大电路利用电路参数的对称性和负反馈作用,有效地稳定静态工作点,以放大差模信号抑制共模信号为显著特征,广泛应用于直接耦合电路和测量电路的输入级。但是差分放大电路结构复杂、分析繁琐,特别是其对差模输入和共模输入信号有不同的分析方法,难以理解,因而一直是模拟电子技术中的难点。

差分放大器工作状态

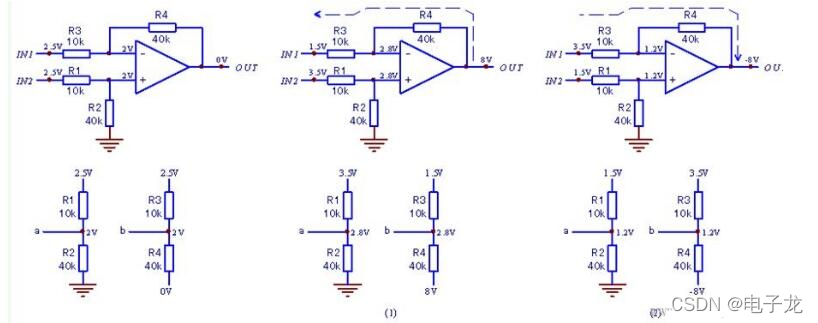

先看图1电路,是输入信号 IN1 = IN2 的状态。

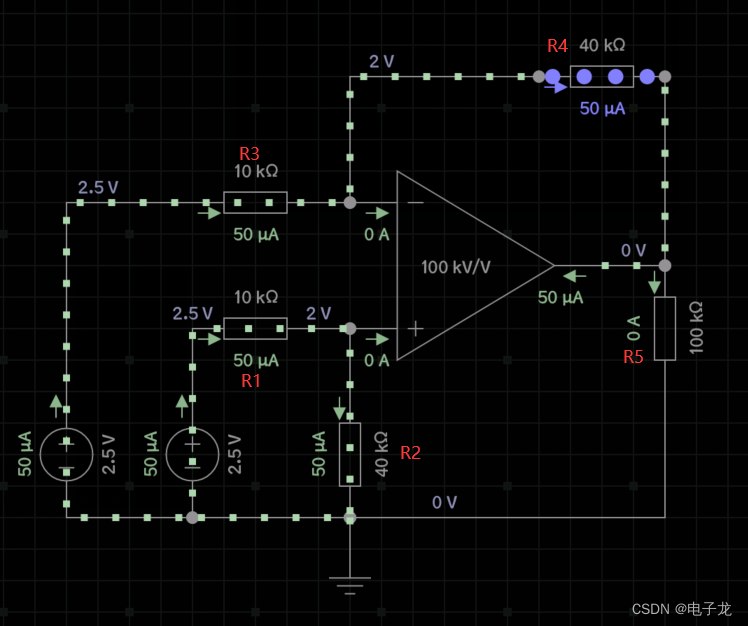

(1)因输入端的“ 虚断 ”特性(理想状态下可理解为输入端对地为断路的,即没有任何电流流入运算放大器的输入端),同相输入端为高阻态,其输入电压值仅仅取决于R1、R2分压值,即2.5V * (40K / (10K+40K)) 为2V。同相输入端的2V电压可以看作成为输入端比较基准电压;

(2)因两输入端的“ 虚短 ”特性(可理解为两输入端是短路的,所以两输入端的电压相等),可进而推知其反相输入端,即R3、R4串联分压电路,其运输放大器的反相输入端电压 等于 同相输入端电压 等于2V。这是反馈电压。运算放大器的控制目的是使反馈电压等于基准电压;

(3)由R1=R3,R2=R4条件可知,放大器输出端只有处于“虚地”状态,即输出端为0V,才能满足同相输入端 等于 反相输入端 等于 2V,这可以由此导出差分放大器的一个工作特征。

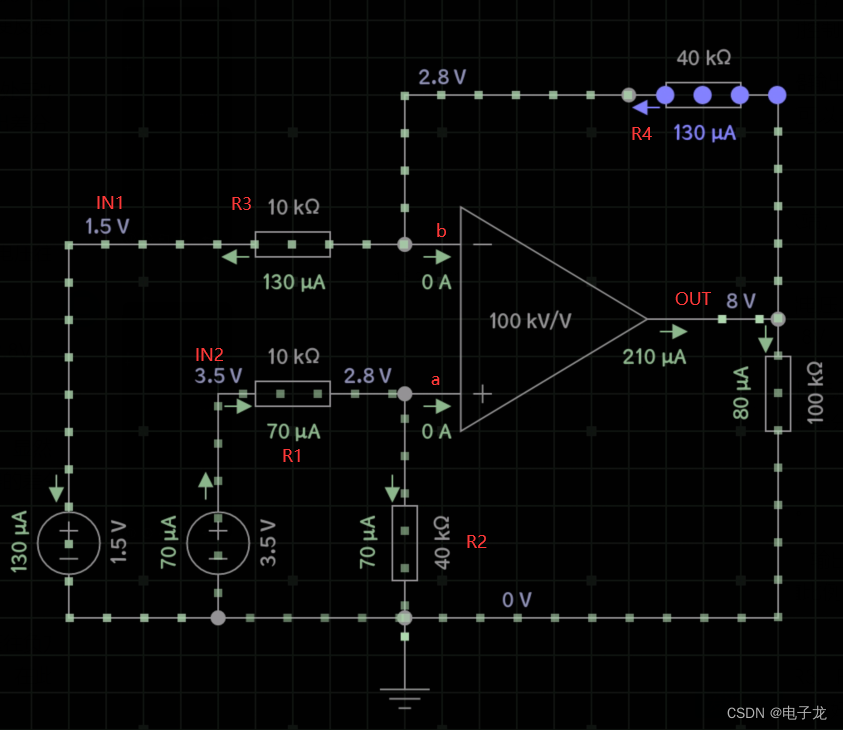

再看图2电路,是 IN1 < IN2 的状态。

(1)此时因 IN2 高于 IN1,因为

运算放大器总是有着将同相输入端和反相输入端的电压相等的一个趋势,

或者说对于运算放大器来说:

如果同相输入端的电压高,那么输出便会往正电压方向偏;

如果反相输入端的电压高,那么输出便会往负电压方向偏 。

所以输出端电压往正方向变化,其R3、R4偏置电路中的电流方向如图所示;

(2)由R3、R4的阻值比例可知,R3两端电压降为(2.8V-1.5V) = 1.3V。根据串联分压的原理,则R4两端的压降 为1.3V × 4 = 5.2V;如果这个不理解,也可以另外理解为同一个支路中电流相等,现在已经知道R3的压降是1.3V,则流过R3的电流为1.3 / 10K = 0.13mA,流过R4的电流也等于0.13mA,则根据V = IR可计算出 R4上的压降为 0.13mA * 40K = 5.2V,其输出端电压为2.8V+5.2V=8V。

(4)此时的输入电压差为IN2 - IN1 = 2V,输出电压为8V。显然,该差分放大器的差分电压放大倍数 = R4/R3 = 40K / 10K = 4倍。由此可以推知差分放大器的输出为

(IN2 - IN1)× R4/R3 = OUT

当R1 = R3, R2 = R4,输出放大倍数为 R4 / R3

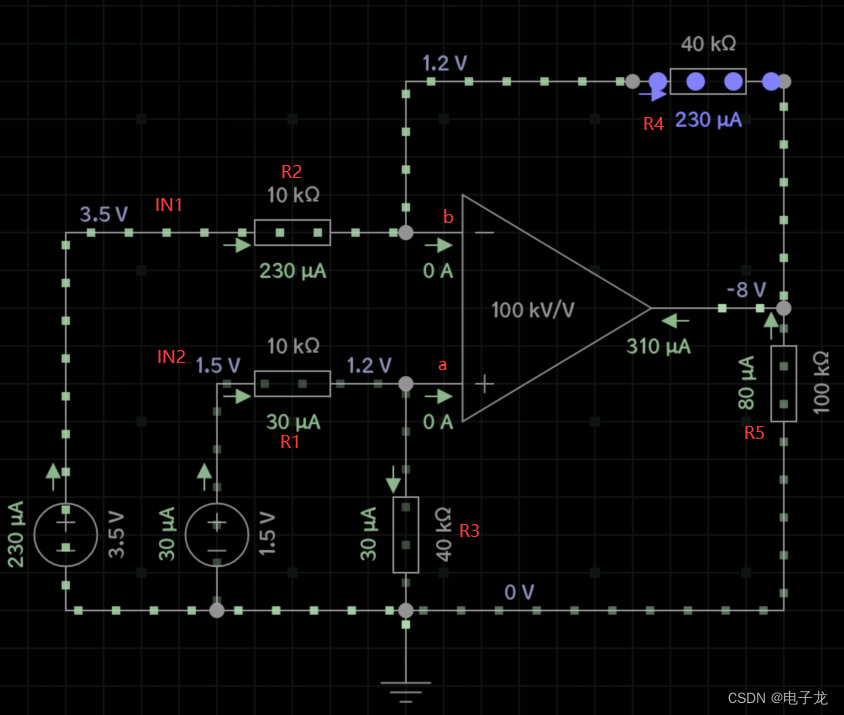

继续来看图3,是 IN1 > IN2 的状态。

此时因 IN1电压高于IN2,输出端电压往负方向变化,其R3、R4偏置电路中的电流方向如图所示。同样,依R3、R4的阻值比例可推知,在此输入条件下,输出端电压为-8V,电路依然将输入差分信号放大了4倍。

电路的工作(故障)状态判断:直接测量运放的同相输入端和反相输入端,如果电压相等,则该电路大概率是正常工作的;

电路的电压放大倍数的测量计算方法:测量输入电压差(R1、R3左端电压差),再测量输出端电压进行比较,计算,即可得出