这篇文章出自《Squeeze-and-Excitation Networks》,在ILSVRC-2017分类挑战赛上获得了冠军。

1. 研究问题

大多数CNN都研究如何捕获特征的空间相关性来提高网络的表示能力,这篇文章研究的是捕获特征通道之间的相关性来提高网络性能。

2. 研究方法

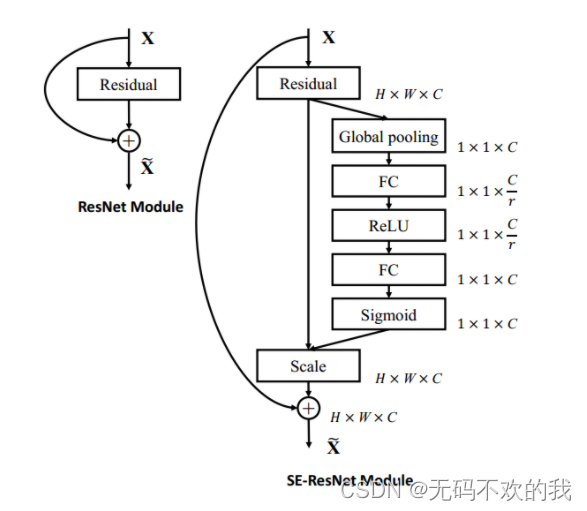

提出了一个Squeeze-and-Excitation block(挤压-激励模块),如图所示。

首先,对输入进行卷积操作:

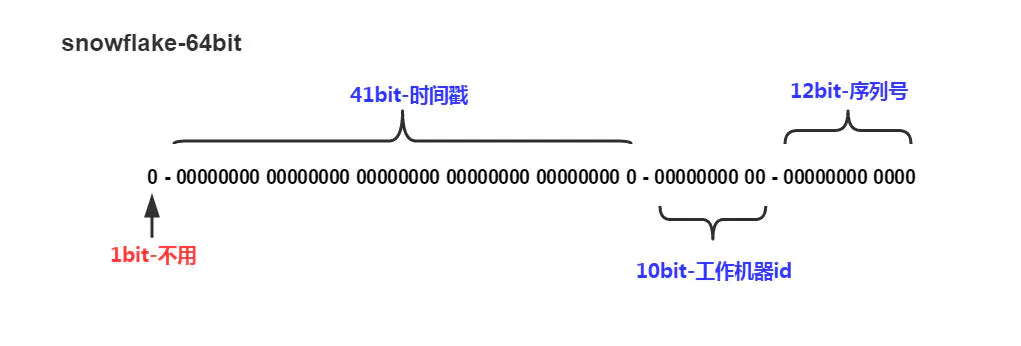

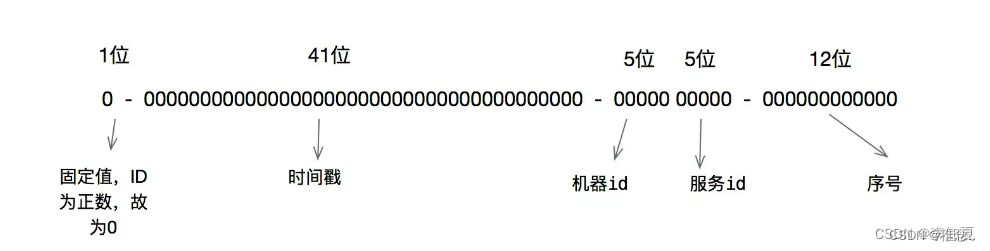

从公式可以看到,通道相关性隐含在卷积核v_c中,它是隐式和局部的(除了顶层特征)。这篇文章是在网络中显式的捕获通道相关性。分为以下两步。

Squeeze: Global Information Embedding

每个通道进行全局平均池化,得到通道的全局信息统计量,这些信息可以表达整个图像。

Excitation: Adaptive Recalibration

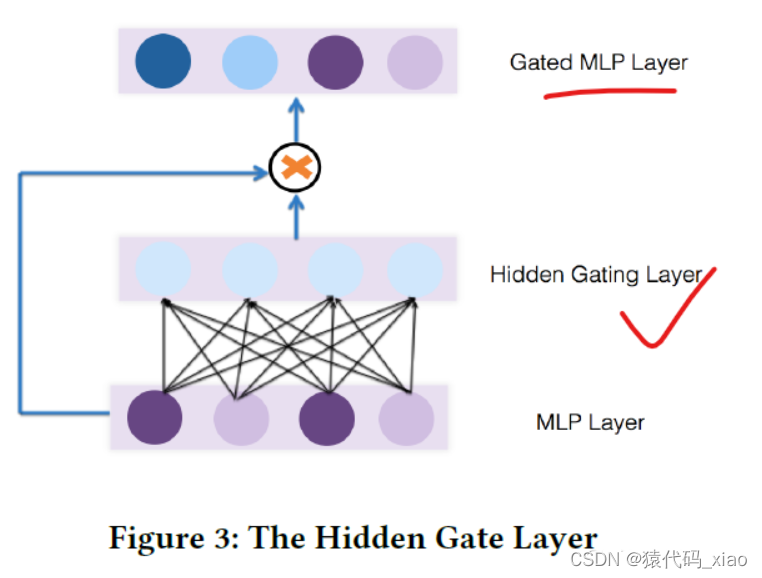

利用Squeeze模块提取的全局统计量,来捕获通道间的相关性。这里采用了简单的带sigmoid激活的门控机制。

这里含有两个全连接层,先降维,在升维,以降低模型复杂度和提高泛化能力。这里的s输出的就是每个通道的权重。用权重乘以U的每个通道得到输出SE模块的输出结果。

该输出结果可以作为后面层的输入。

SE模块可以看成是对通道的一种自注意力函数,将重要的特征加以突出,而弱化无用的特征,以提升网络的性能。

SENet

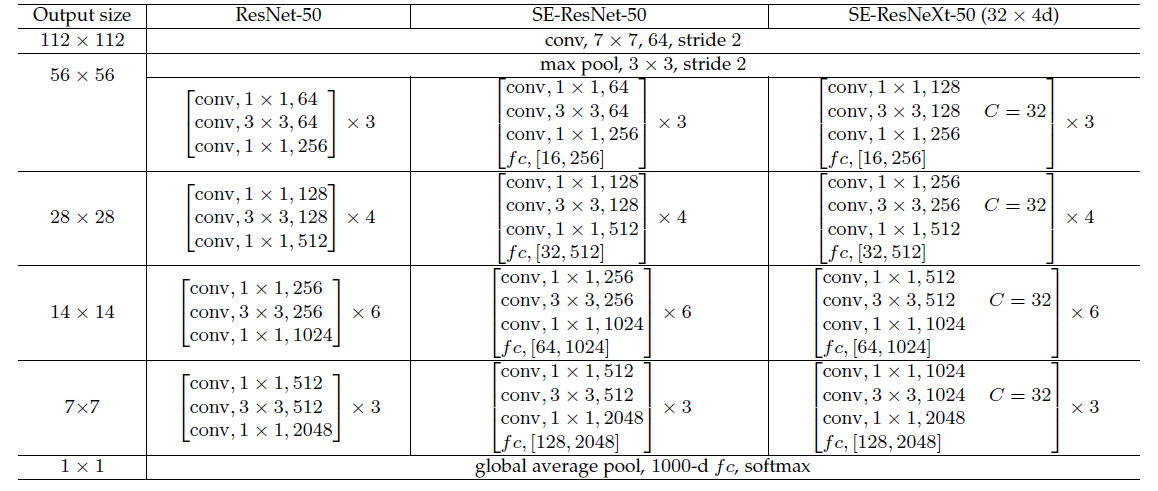

SE模块可以集成到现有的标准架构中。文章将SE模块集成到了Inception和ResNet等网络中。

增加的SE模块是轻量级的,每个SE模块只有两个全连接层的参数,增加了少量的计算复杂度,但带来了性能的较大提升。

3. 实验结果

SENet在多个视觉任务中都取得了比对应标准网络更好的性能,并且在训练过程中带来了稳定的提升,而代价仅仅是增加了几乎可忽略不计的计算复杂度。

4. 结论

SE模块可以显式捕获通道相关性,将注意力集中于重要特征上,从而提高了网络的表示能力。

![[ 注意力机制 ] 经典网络模型1——SENet 详解与复现](https://img-blog.csdnimg.cn/76f92bb7921e4293800b75d7dcdde90f.png?x-oss-process=image/watermark,type_d3F5LXplbmhlaQ,shadow_50,text_Q1NETiBASG9yaXpvbiBNYXg=,size_14,color_FFFFFF,t_70,g_se,x_16#pic_center)