原版代码在这:神经网络学习小记录52——Pytorch搭建孪生神经网络(Siamese network)比较图片相似性

VGG注释:

import torch

import torch.nn as nn

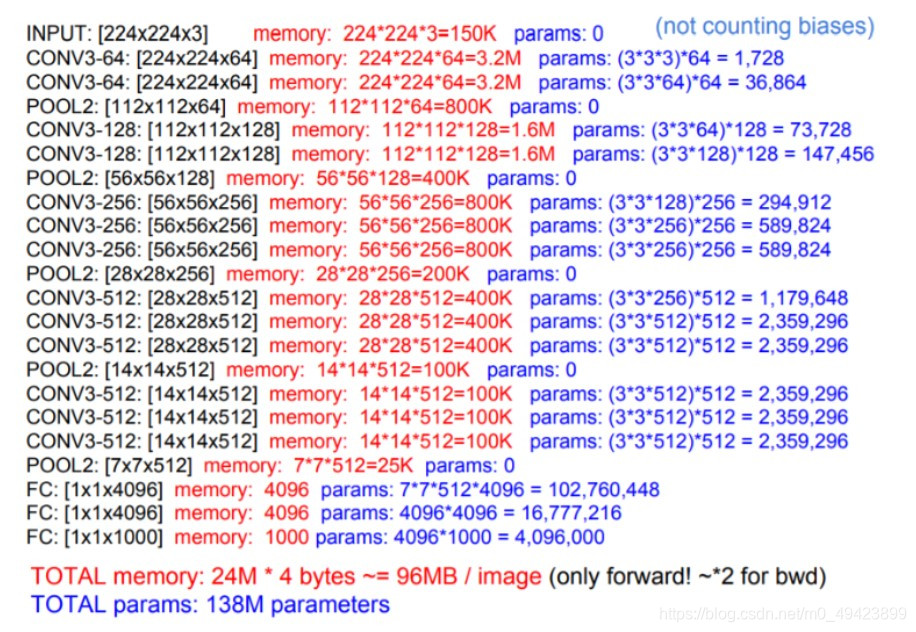

from torchvision.models.utils import load_state_dict_from_urlclass VGG(nn.Module):def __init__(self, features, num_classes=1000): # features:14*14*512super(VGG, self).__init__()self.features = features #self.avgpool = nn.AdaptiveAvgPool2d((7, 7)) # 自适应平均池化函数:只需要给定输出特征图的大小就好,其中通道数前后不发生变化。# torch.nn.Sequential是一个Sequential容器,模块将按照构造函数中传递的顺序添加到模块中。另外,也可以传入一个有序模块。self.classifier = nn.Sequential(nn.Linear(512 * 7 * 7, 4096), # 线性层25088-4096nn.ReLU(True),nn.Dropout(), # 防止过拟合nn.Linear(4096, 4096),nn.ReLU(True),nn.Dropout(),nn.Linear(4096, num_classes), # 这里就是线性层最后输出1000个元素的特征)self._initialize_weights()def forward(self, x):x = self.features(x)x = self.avgpool(x) # 7*7*512x = torch.flatten(x, 1) # 1*25088 flatten(x,1)是按照x的第1个维度拼接(按照列来拼接,横向拼接)x = self.classifier(x) # 1*1000return x# 初始化网络权值方差# 在网络模型搭建完成之后,对网络中的权重进行合适的初始化是非常重要的一个步骤, 初始化好了,比如正好初始化到模型的最优解附近,# 那么模型训练起来速度也会非常的快, 但如果初始化不好,离最优解很远,那么模型就需要更多次迭代,有时候还会引发梯度消失和爆炸现象,# 所以正确的权值初始化还是非常重要的def _initialize_weights(self):for m in self.modules(): # nn.Module类中的一个方法:self.modules(), 他会返回该网络中的所有modules.if isinstance(m, nn.Conv2d): # isinstance:判断一个量是否是相应的类型,接受的参数一个是对象加一种类型nn.init.kaiming_normal_(m.weight, mode='fan_out', nonlinearity='relu')if m.bias is not None:nn.init.constant_(m.bias, 0)elif isinstance(m, nn.BatchNorm2d):nn.init.constant_(m.weight, 1)nn.init.constant_(m.bias, 0)elif isinstance(m, nn.Linear):nn.init.normal_(m.weight, 0, 0.01)nn.init.constant_(m.bias, 0)# 在卷积神经网络的卷积层之后总会添加BatchNorm2d进行数据的归一化处理,这使得数据在进行Relu之前不会因为数据过大而导致网络性能的不稳定def make_layers(cfg, batch_norm=False, in_channels = 3): # 用于循环创建网络层layers = []for v in cfg:if v == 'M':layers += [nn.MaxPool2d(kernel_size=2, stride=2)]else:conv2d = nn.Conv2d(in_channels, v, kernel_size=3, padding=1)if batch_norm:layers += [conv2d, nn.BatchNorm2d(v), nn.ReLU(inplace=True)]else:layers += [conv2d, nn.ReLU(inplace=True)]in_channels = v # 这里改变in_channels以便下一层构建Conv2d时输入通道个数为前一层的输出通道个数return nn.Sequential(*layers) # 在循环中将VGG的卷积,池化层一层层加入到layers列表中# torch.nn.Sequential是一个Sequential容器,模块将按照构造函数中传递的顺序添加到模块中。另外,也可以传入一个有序模块。cfgs = {'D': [64, 64, 'M', 128, 128, 'M', 256, 256, 256, 'M', 512, 512, 512, 'M', 512, 512, 512, 'M'] # 构建VGG卷积层

}

# M为池化层

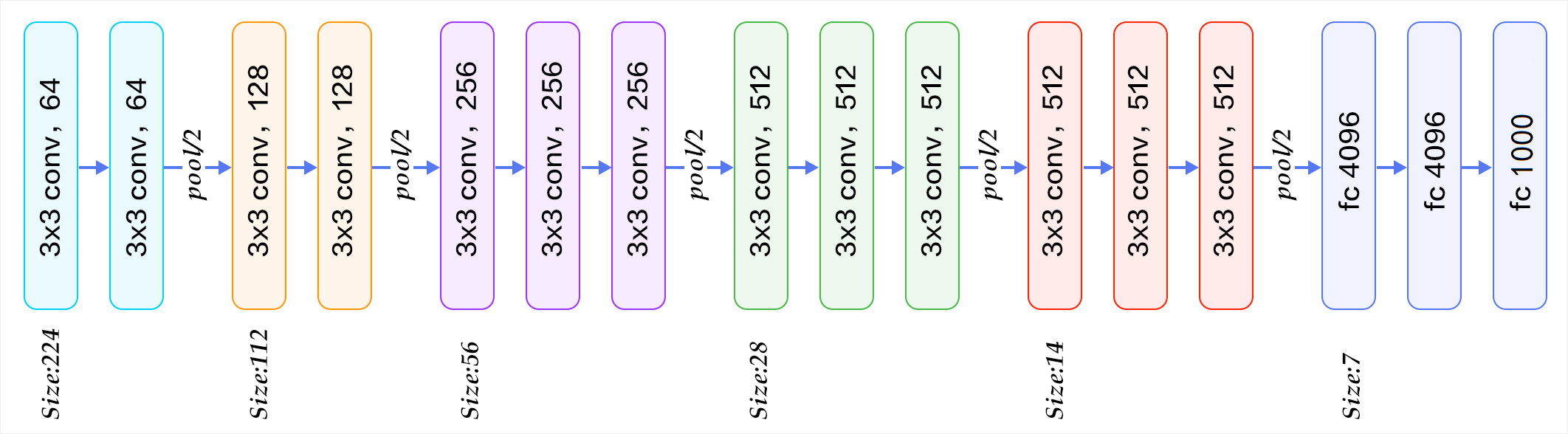

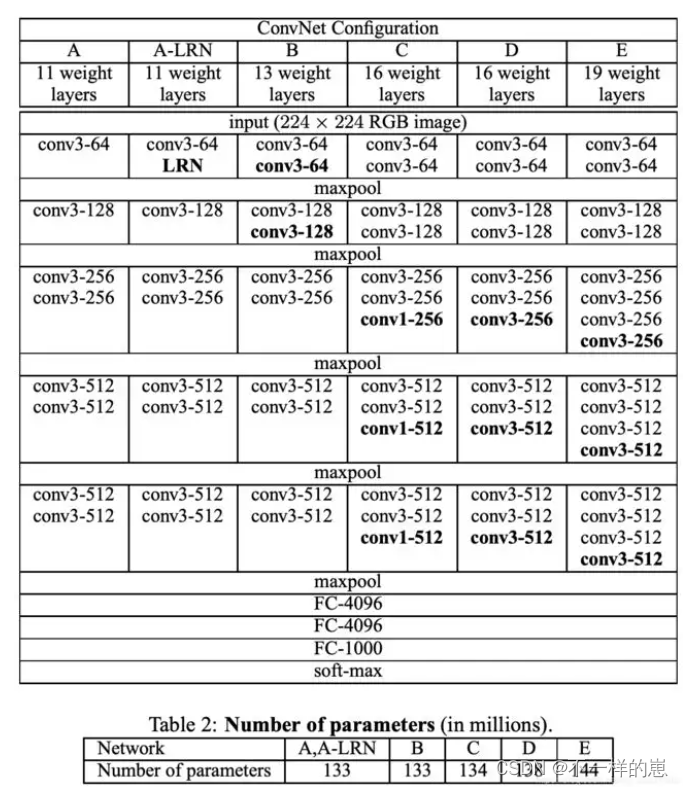

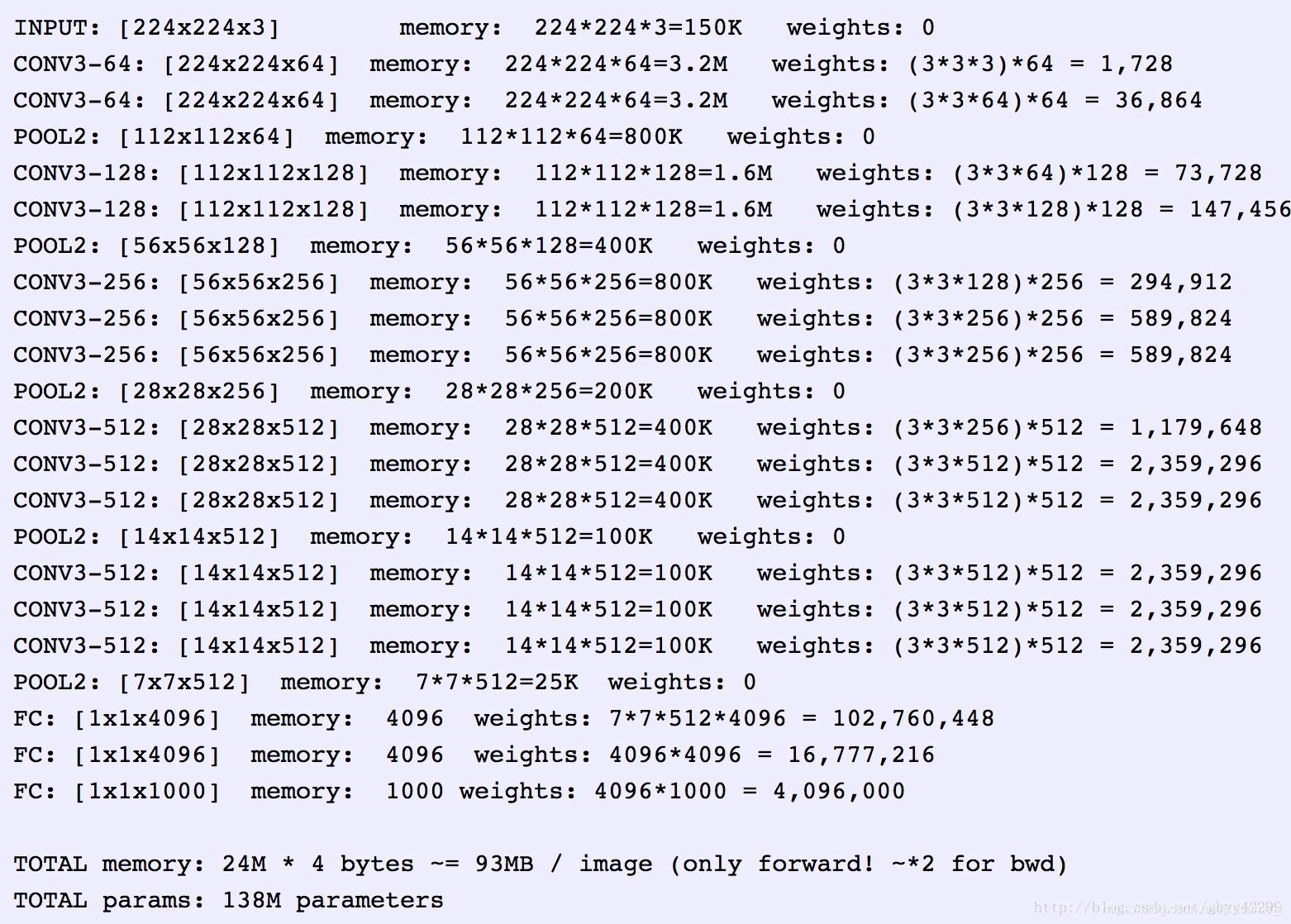

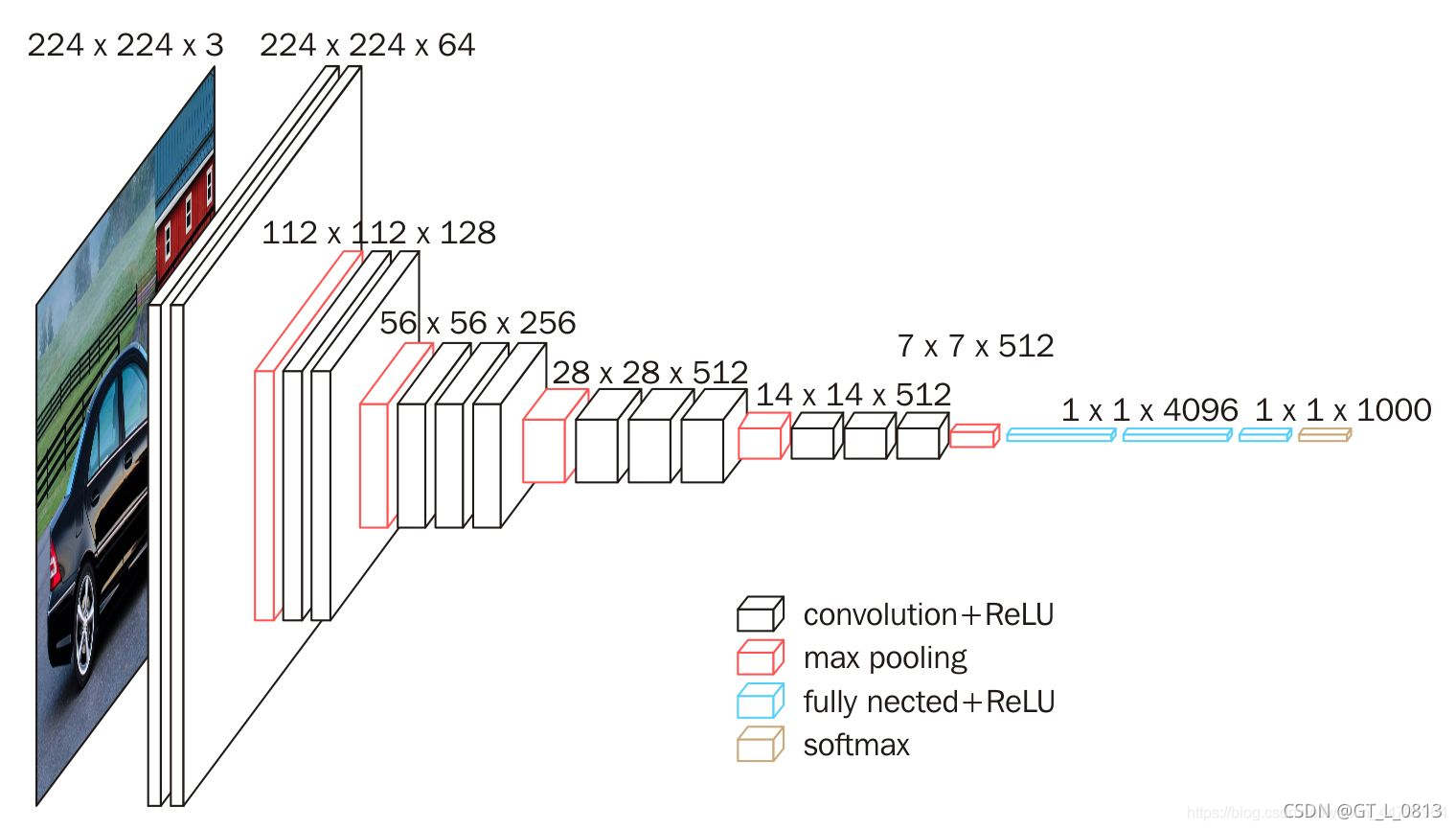

# 2、conv1包括两次[3,3]卷积网络,一次2X2最大池化,输出的特征层为64通道。

# 3、conv2包括两次[3,3]卷积网络,一次2X2最大池化,输出的特征层为128通道。

# 4、conv3包括三次[3,3]卷积网络,一次2X2最大池化,输出的特征层为256通道。

# 5、conv4包括三次[3,3]卷积网络,一次2X2最大池化,输出的特征层为512通道。

# 6、conv5包括三次[3,3]卷积网络,一次2X2最大池化,输出的特征层为512通道。

def VGG16(pretrained, in_channels, **kwargs): # 预训练模型参数,输入图片通道数,kwargs是num_classes即卷积池化输出线性过后的特征数量model = VGG(make_layers(cfgs["D"], batch_norm = False, in_channels = in_channels), **kwargs) # 构建网络结构if pretrained: # 加载网络参数state_dict = load_state_dict_from_url("https://download.pytorch.org/models/vgg16-397923af.pth", model_dir="./model_data")model.load_state_dict(state_dict)return model