经典网络VGG16

结构

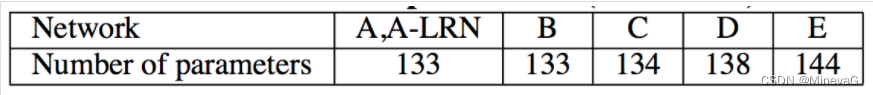

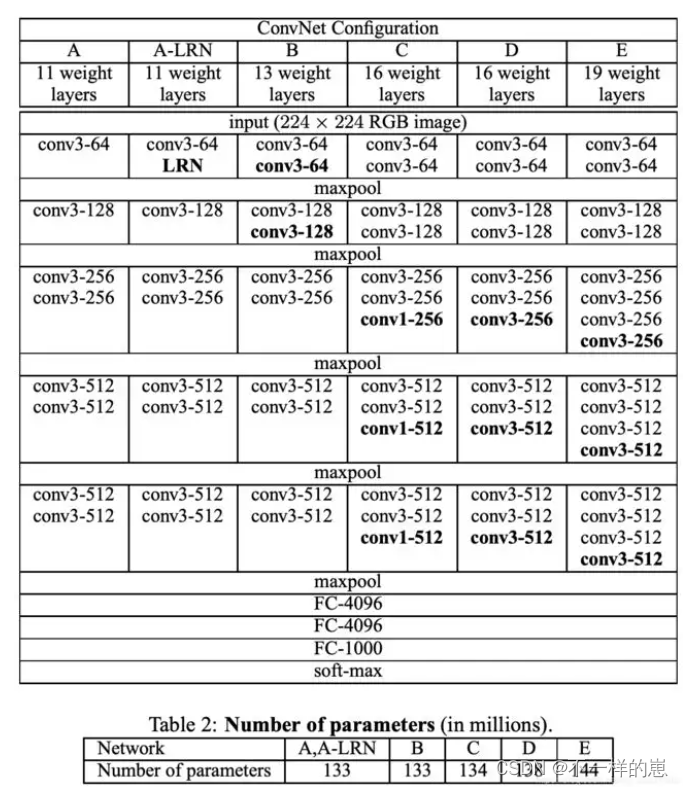

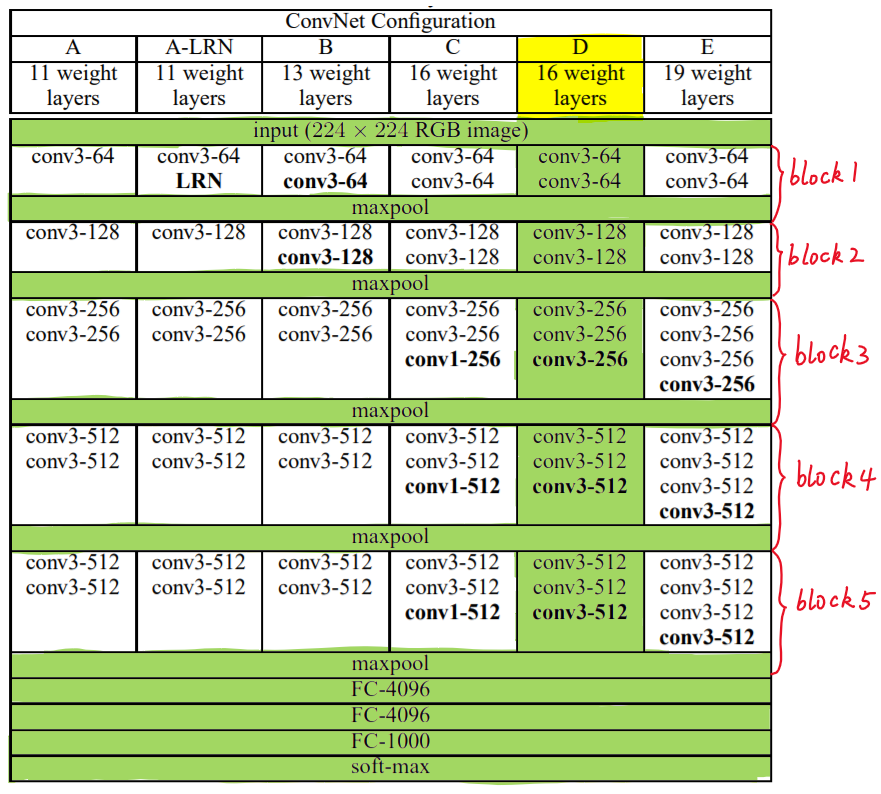

VGG中根据卷积核大小和卷积层数目的不同,可分为A,A-LRN,B,C,D,E共6个配置(ConvNet Configuration),其中以D,E两种配置较为常用,分别称为VGG16和VGG19。

下图给出了VGG的六种结构配置:

上图中,每一列对应一种结构配置。例如,图中绿色部分即指明了VGG16所采用的结构。

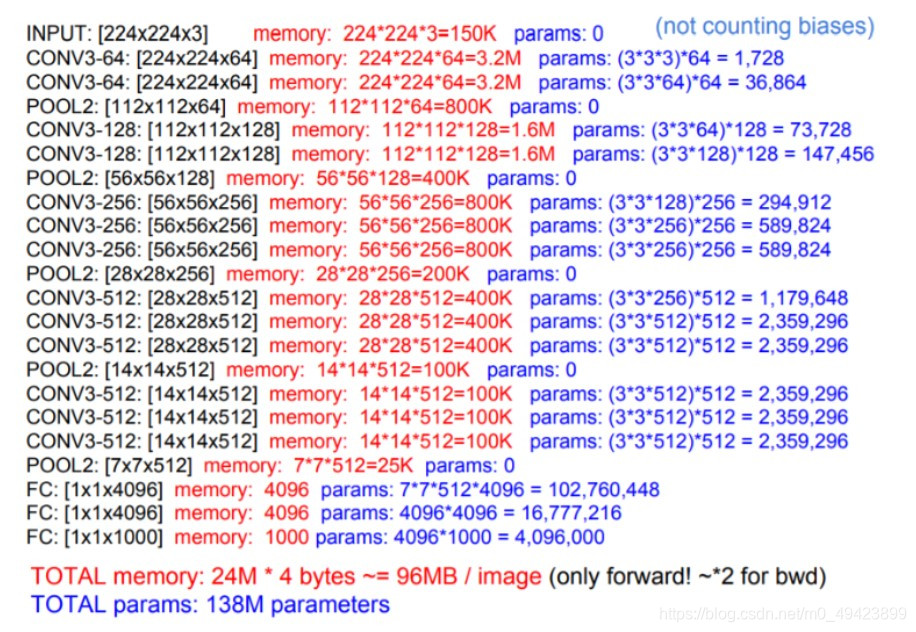

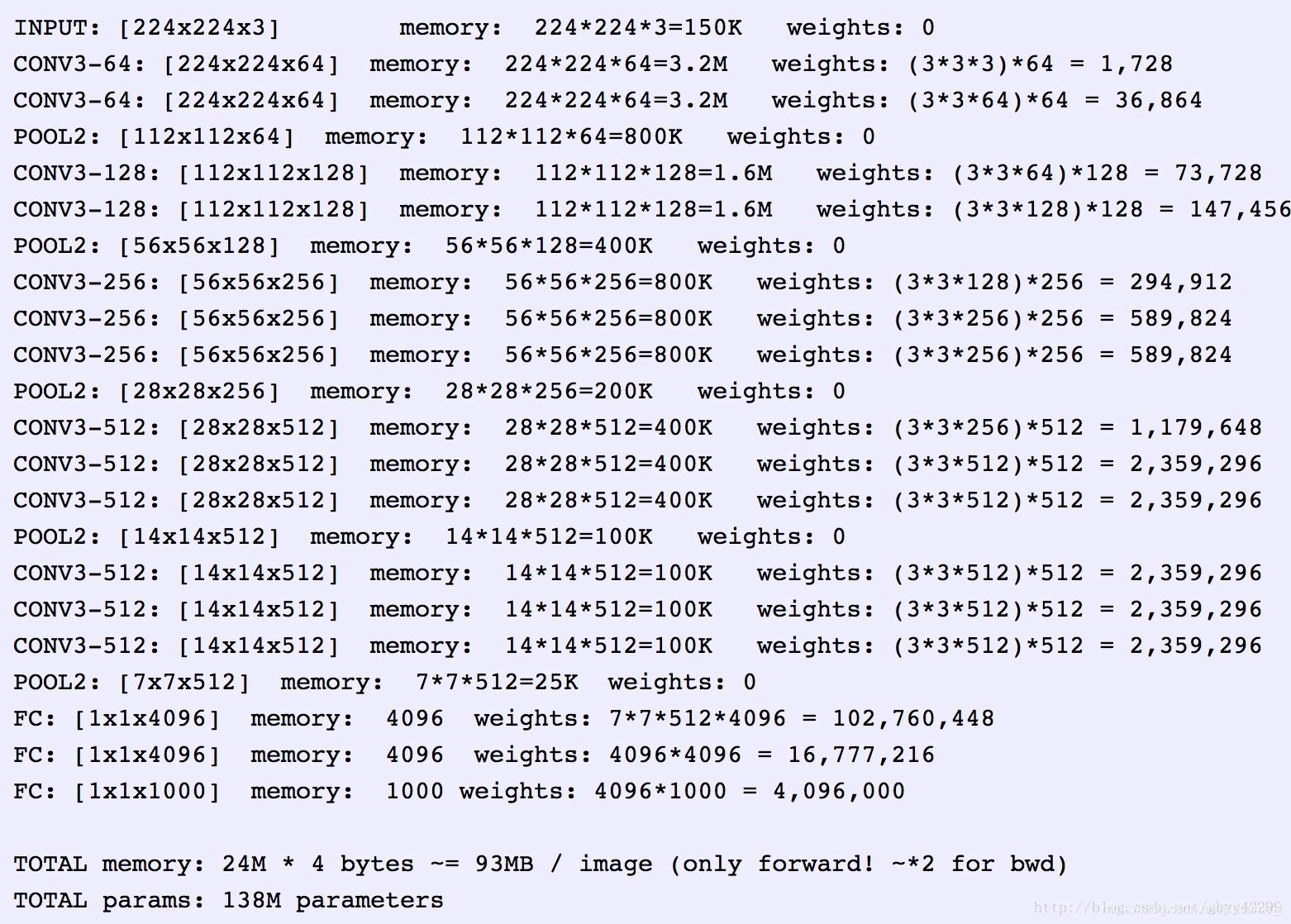

我们针对VGG16进行具体分析发现,VGG16共包含:

- 13个卷积层(Convolutional Layer),分别用conv3-XXX表示

- 3个全连接层(Fully connected Layer),分别用FC-XXXX表示

- 5个池化层(Pool layer),分别用maxpool表示

其中,卷积层和全连接层具有权重系数,因此也被称为权重层,总数目为13+3=16,这即是

VGG16中16的来源。(池化层不涉及权重,因此不属于权重层,不被计数)。

特点

VGG16的突出特点是简单,体现在:

-

卷积层均采用相同的卷积核参数

卷积层均表示为

conv3-XXX,其中conv3说明该卷积层采用的卷积核的尺寸(kernel size)是3,即宽(width)和高(height)均为3,3*3是很小的卷积核尺寸,结合其它参数(步幅stride=1,填充方式padding=same),这样就能够使得每一个卷积层(张量)与前一层(张量)保持相同的宽和高。XXX代表卷积层的通道数。 -

池化层均采用相同的池化核参数

池化层的参数均为2××2,步幅stride=2,max的池化方式,这样就能够使得每一个池化层(张量)的宽和高是前一层(张量)的1212。

-

模型是由若干卷积层和池化层堆叠(stack)的方式构成,比较容易形成较深的网络结构(在2014年,16层已经被认为很深了)。

综合上述分析,可以概括VGG的优点为: Small filters, Deeper networks.

块结构

我们注意图1右侧,VGG16的卷积层和池化层可以划分为不同的块(Block),从前到后依次编号为Block1~block5。每一个块内包含若干卷积层和一个池化层。例如:Block4包含:

- 3个卷积层,conv3-512

- 1个池化层,maxpool

并且同一块内,卷积层的通道(channel)数是相同的,例如:

block2中包含2个卷积层,每个卷积层用conv3-128表示,即卷积核为:3x3x3,通道数都是128block3中包含3个卷积层,每个卷积层用conv3-256表示,即卷积核为:3x3x3,通道数都是256

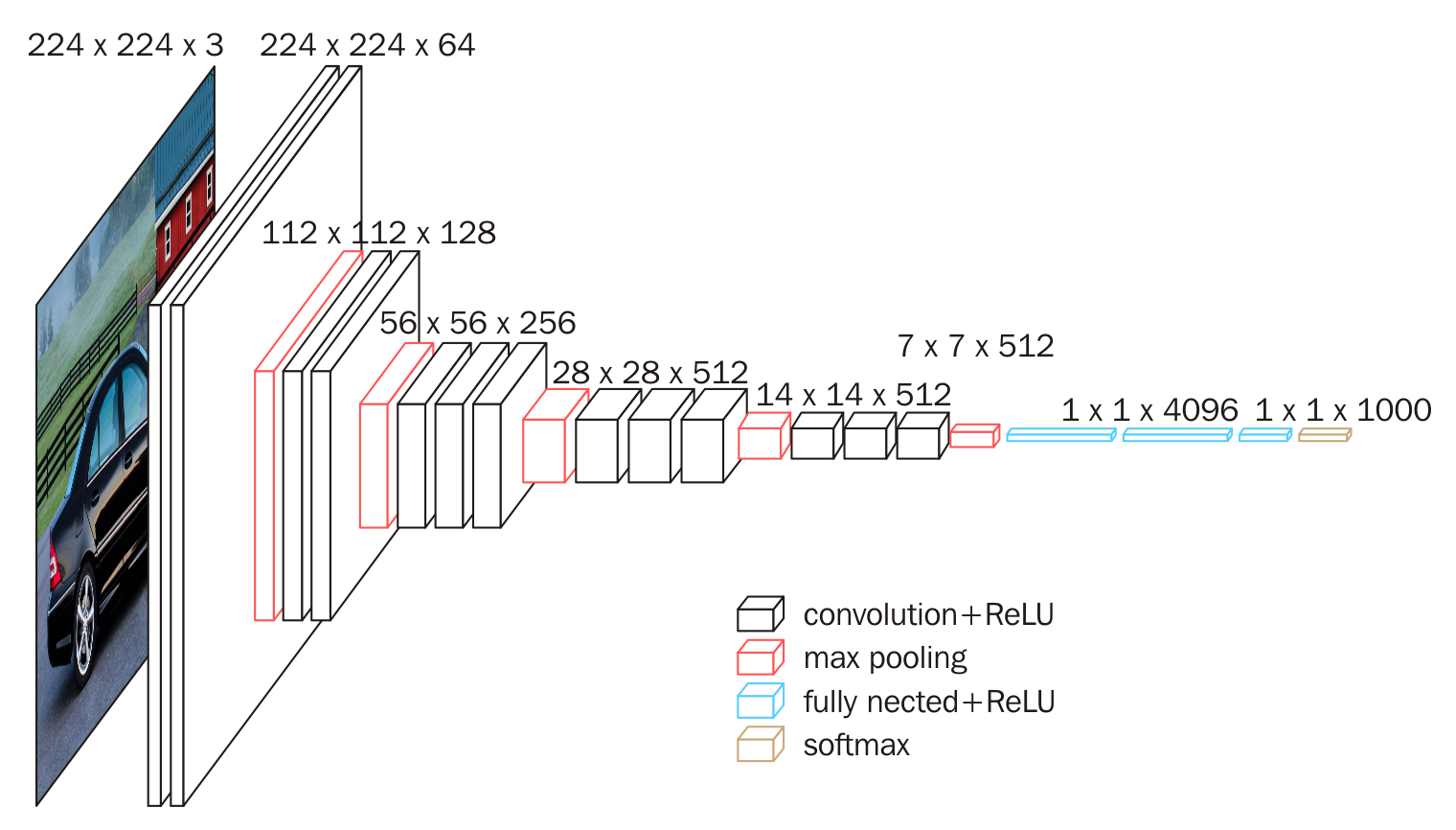

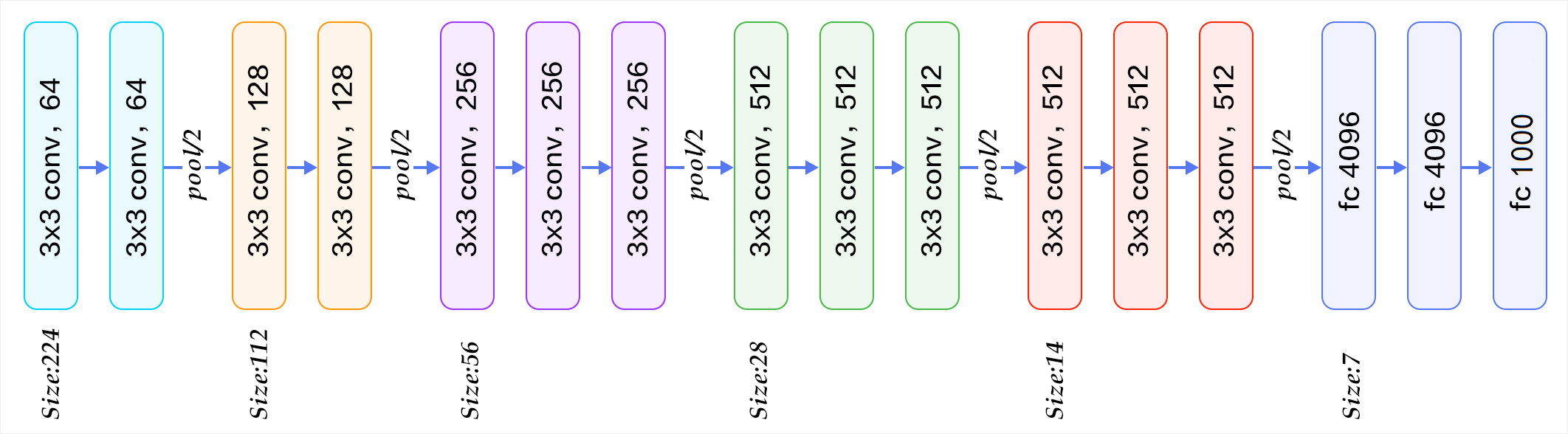

下面给出按照块划分的VGG16的结构图,可以结合图2进行理解:

VGG的输入图像是 224x224x3 的图像张量(tensor),随着层数的增加,后一个块内的张量相比于前一个块内的张量:

- 通道数翻倍,由64依次增加到128,再到256,直至512保持不变,不再翻倍

- 高和宽变减半,由 224→112→56→28→14→7

权重参数

尽管VGG的结构简单,但是所包含的权重数目却很大,达到了惊人的139,357,544个参数。这些参数包括卷积核权重和全连接层权重。

- 例如,对于第一层卷积,由于输入图的通道数是3,网络必须学习大小为3x3,通道数为3的的卷积核,这样的卷积核有64个,因此总共有(3x3x3)x64 = 1728个参数

- 计算全连接层的权重参数数目的方法为:前一层节点数×本层的节点数前一层节点数×本层的节点数。因此,全连接层的参数分别为:

-

- 7x7x512x4096 = 1027,645,444

- 4096x4096 = 16,781,321

- 4096x1000 = 4096000

代码

def vgg16(input_shape=(224, 224, 3), classes=20):inputs = Input(shape=input_shape) # (224, 224, 3)x = layers.Conv2D(64, kernel_size=3, strides=1, padding='same', activation='relu')(inputs) # (224, 224, 64)x = layers.Conv2D(64, kernel_size=3, strides=1, padding='same', activation='relu')(x) # (224, 224, 64)x = layers.MaxPool2D(pool_size=(2, 2), strides=2)(x) # (112, 112, 64)x = layers.Conv2D(128, kernel_size=3, strides=1, padding='same', activation='relu')(x) # (112, 112, 128)x = layers.Conv2D(128, kernel_size=3, strides=1, padding='same', activation='relu')(x) # (112, 112, 128)x = layers.MaxPool2D(pool_size=(2, 2), strides=2)(x) # (56, 56, 128)x = layers.Conv2D(256, kernel_size=3, strides=1, padding='same', activation='relu')(x) # (56, 56, 256)x = layers.Conv2D(256, kernel_size=3, strides=1, padding='same', activation='relu')(x) # (56, 56, 256)x = layers.Conv2D(256, kernel_size=1, strides=1, padding='same', activation='relu')(x) # (56, 56, 256)x = layers.MaxPool2D(pool_size=(2, 2), strides=2)(x) # (28, 28, 256)x = layers.Conv2D(512, kernel_size=3, strides=1, padding='same', activation='relu')(x) # (28, 28, 512)x = layers.Conv2D(512, kernel_size=3, strides=1, padding='same', activation='relu')(x) # (28, 28, 512)x = layers.Conv2D(512, kernel_size=1, strides=1, padding='same', activation='relu')(x) # (28, 28, 512)x = layers.MaxPool2D(pool_size=(2, 2), strides=2)(x) # (14, 14, 512)x = layers.Conv2D(512, kernel_size=3, strides=1, padding='same', activation='relu')(x) # (14, 14, 512)x = layers.Conv2D(512, kernel_size=3, strides=1, padding='same', activation='relu')(x) # (14, 14, 512)x = layers.Conv2D(512, kernel_size=1, strides=1, padding='same', activation='relu')(x) # (14, 14, 512)x = layers.MaxPool2D(pool_size=(2, 2), strides=2)(x) # (7, 7, 512)x = layers.Flatten()(x) # (7*7*512)x = layers.Dropout(rate=0.5)(x)x = layers.Dense(4096)(x) # (4096)x = layers.Dropout(rate=0.5)(x)x = layers.Dense(4096)(x) # (4096)x = layers.Dense(classes)(x) # (classes)outputs = layers.Softmax()(x)model = Model(inputs, outputs)return model