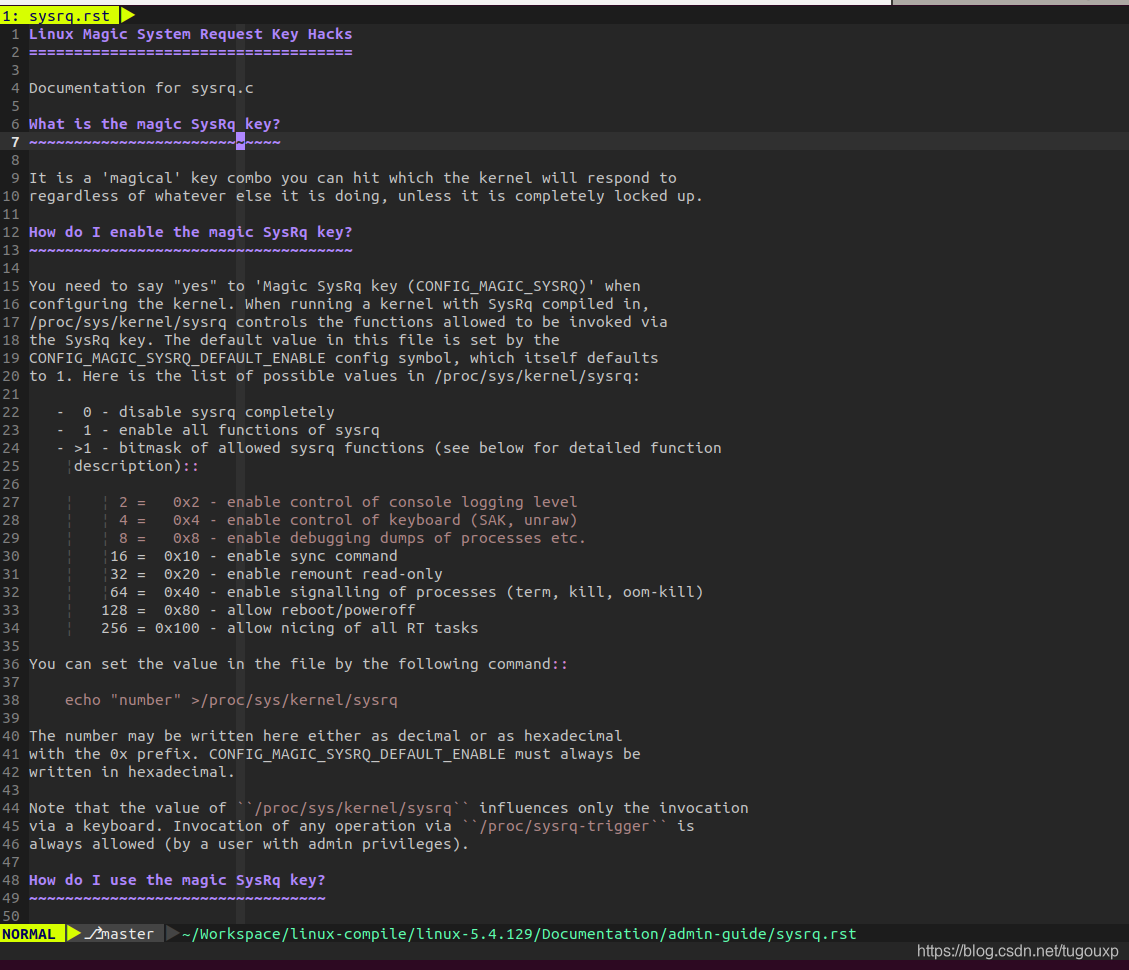

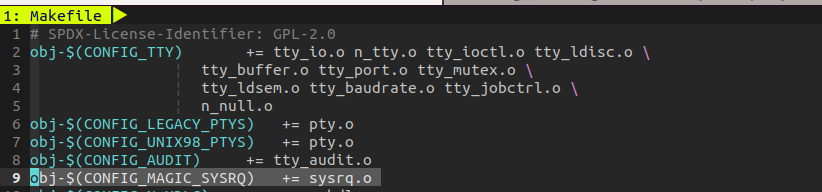

1.sysrq机制的文件系统节点

2.内核注册:

在drivers/tty/sysrq.c中注册的此文件节点,

系统依赖配置CONFIG_MAGIC_SYSRQ.

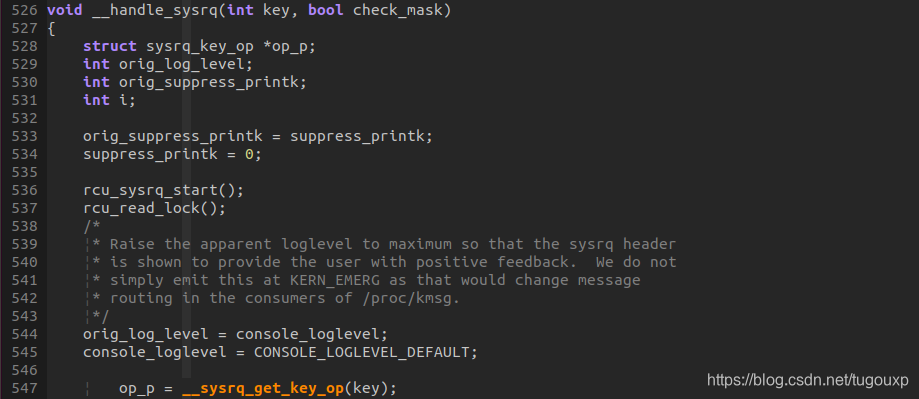

3. 实现接口

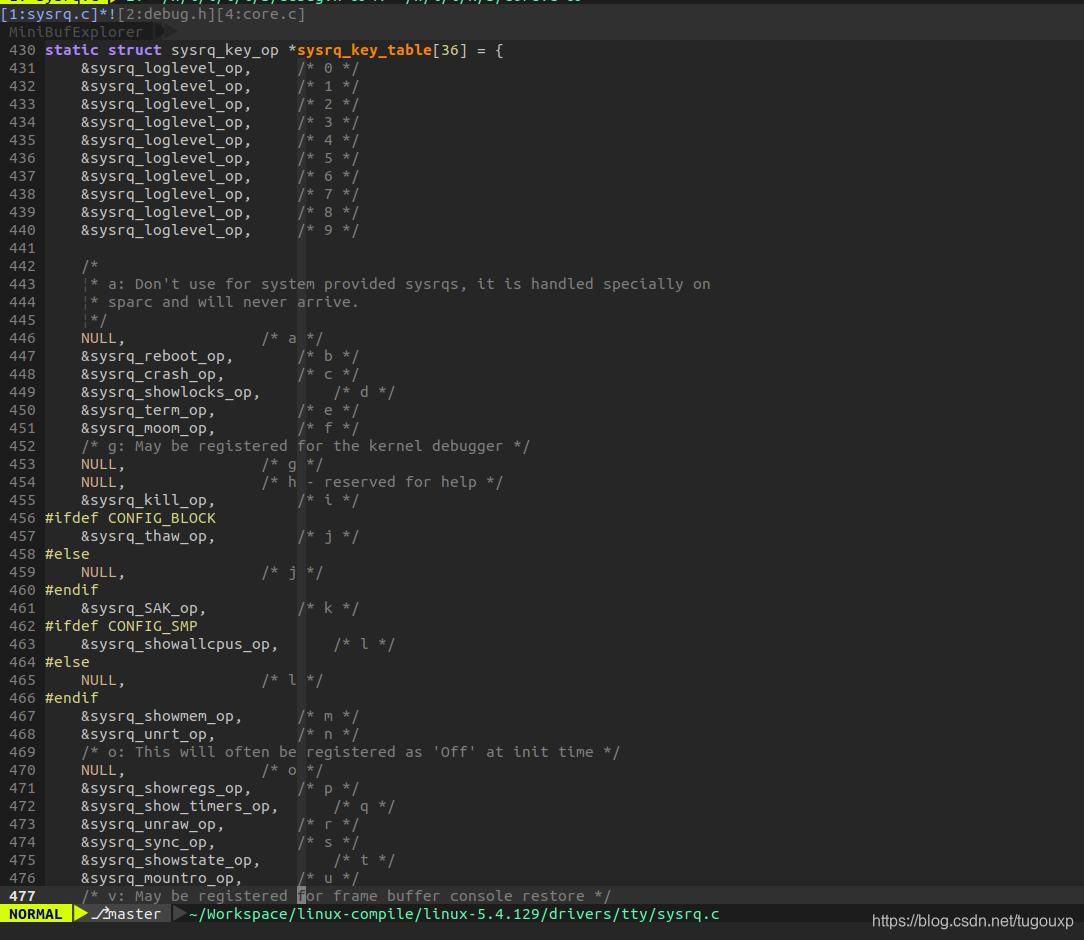

ops table的定义

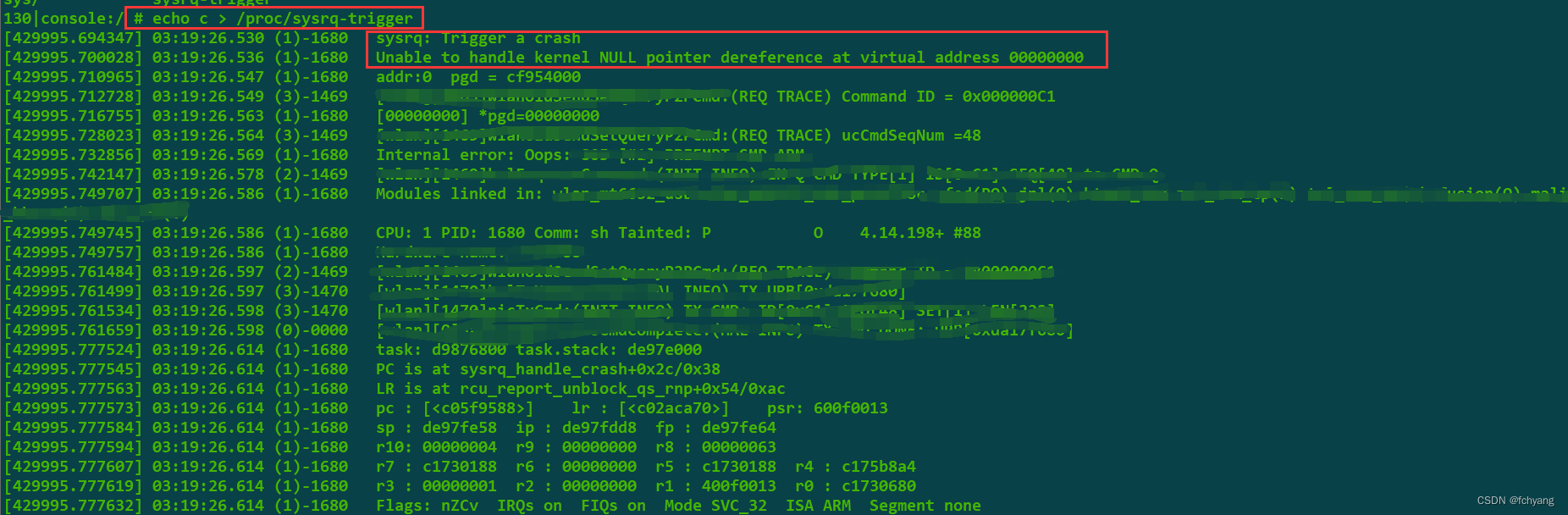

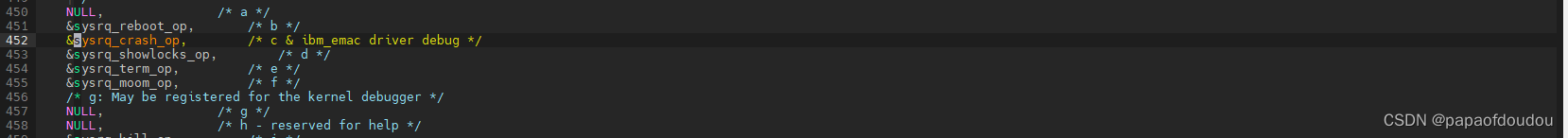

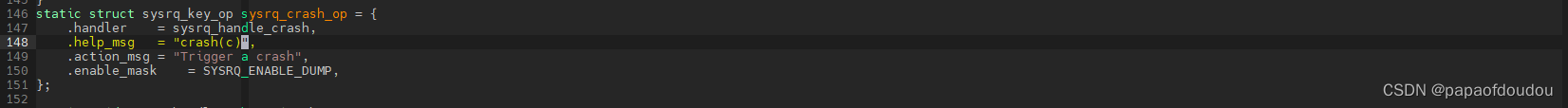

以触发crash的c命令为例(echo c > /proc/sysrq-trigger)

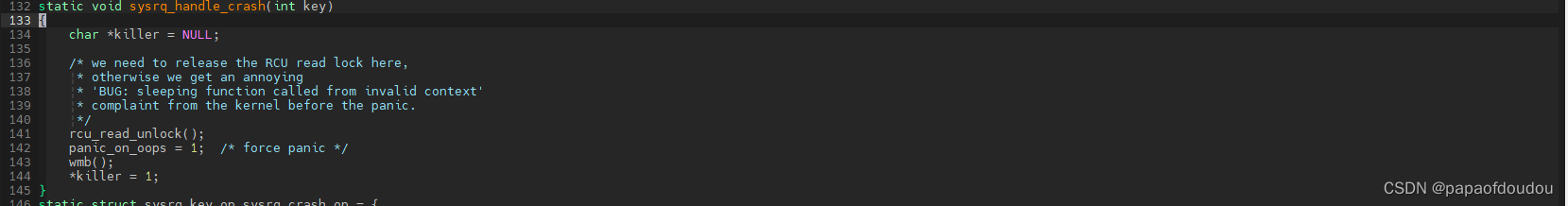

触发方式很简单,直接在空指针上写数据就可以了。需要注意的是这里的panic_on_oops,在内核中,是一个标志性的变量。

默认情况下

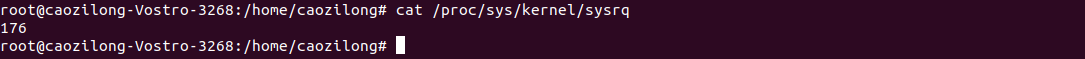

/proc/sys/kernel/sysrq控制OPS中的哪些功能打开

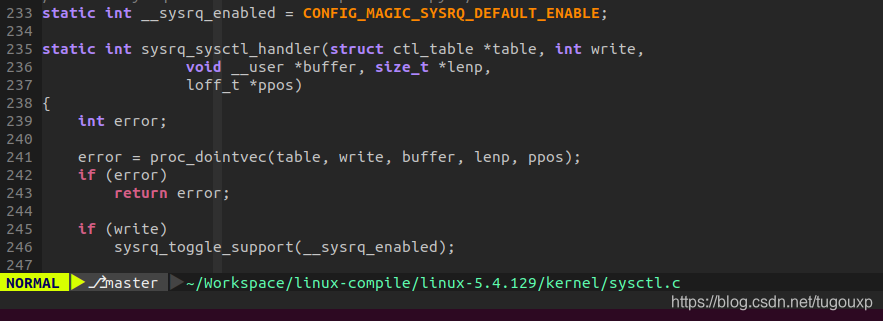

默认情况通过CONFIG_MAGIC_SYSRQ_DEFAULT_ENABLE传递MASK位给内核控制默认的开启OPS:

默认情况通过CONFIG_MAGIC_SYSRQ_DEFAULT_ENABLE传递MASK位给内核控制默认的开启OPS:

4.举例

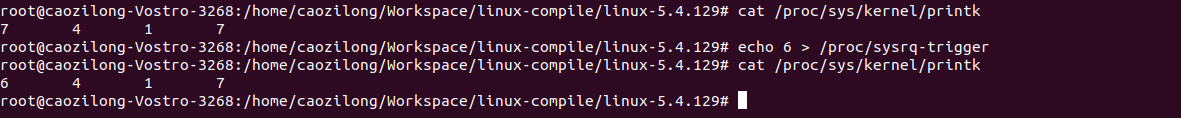

通过sysrq-trigger调整printk级别(当然也可以直接操作printk).

echo 6 > /proc/sysrq-trigger

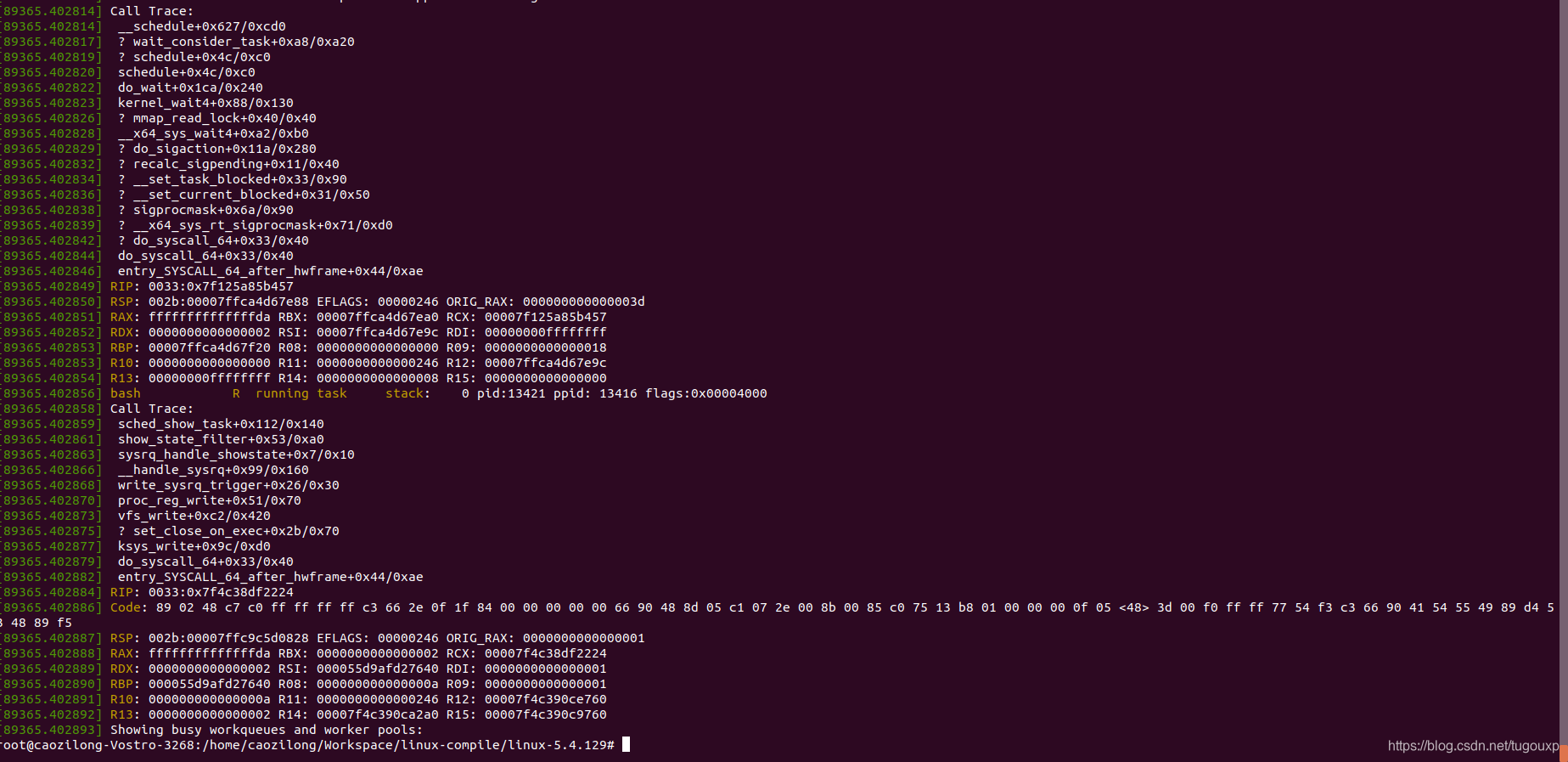

查看内核堆栈:

echo t > /proc/sysrq-trigger

查看内核内存使用:

echo m > /proc/sysrq-trigger

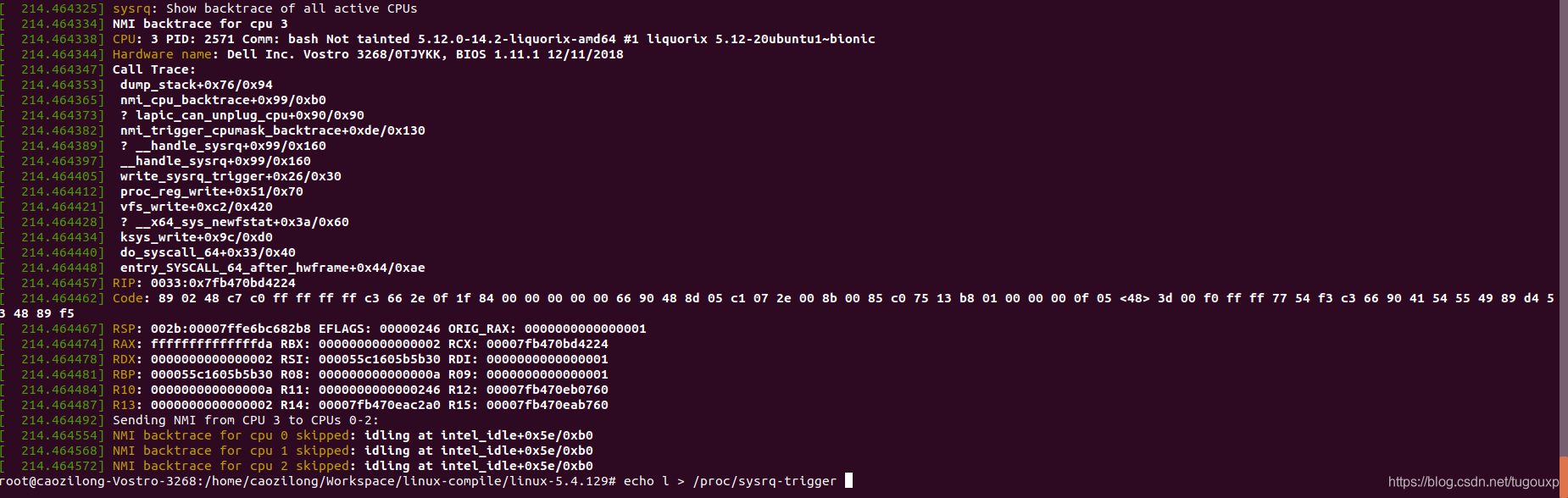

查看内核所有处理器的堆栈情况:

echo l > /proc/sysrq-trigger

其它关于sysrq-trigger的操作技巧可以参考内核文档: