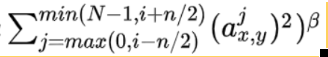

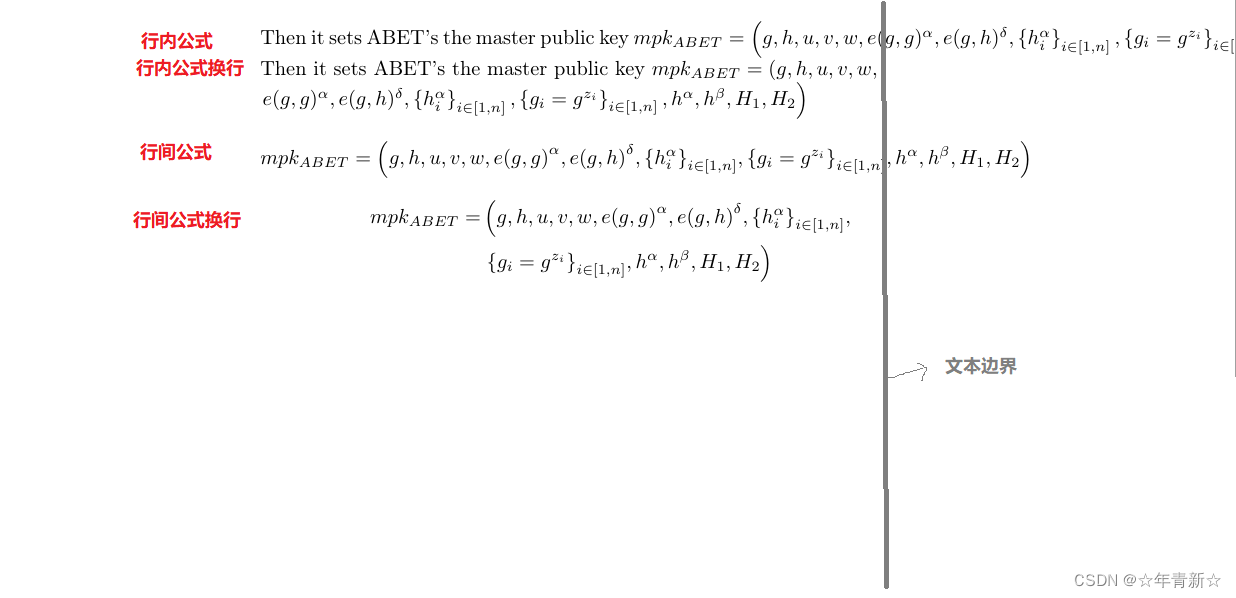

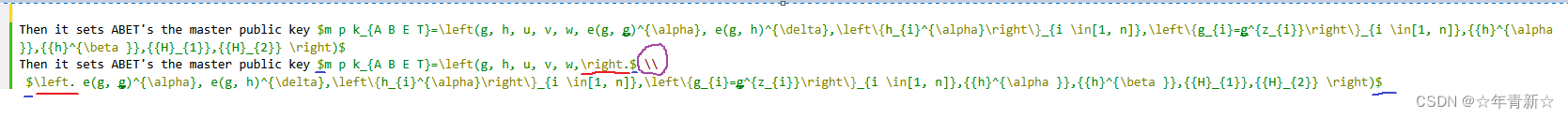

行内公式

代码:

%错误示范

Then it sets ABET's the master public key $m p k_{A B E T}=\left(g, h, u, v, w, e(g, g)^{\alpha}, e(g, h)^{\delta},\left\{h_{i}^{\alpha}\right\}_{i \in[1, n]},\left\{g_{i}=g^{z_{i}}\right\}_{i \in[1, n]},{{h}^{\alpha }},{{h}^{\beta }},{{H}_{1}},{{H}_{2}} \right)$

%正确代码

Then it sets ABET's the master public key $m p k_{A B E T}=\left(g, h, u, v, w,\right.$ \\$\left. e(g, g)^{\alpha}, e(g, h)^{\delta},\left\{h_{i}^{\alpha}\right\}_{i \in[1, n]},\left\{g_{i}=g^{z_{i}}\right\}_{i \in[1, n]},{{h}^{\alpha }},{{h}^{\beta }},{{H}_{1}},{{H}_{2}} \right)$

说明:

对于编译后的PDF观察,手动对公式隔断。比如这里对w之后进行隔断,在公式代码中w之后加\.right.和换行符号\\。即$前半段公式内容 \right.$ \\。后半段公式开头加\left.,即$\left. 后半段公式内容$。

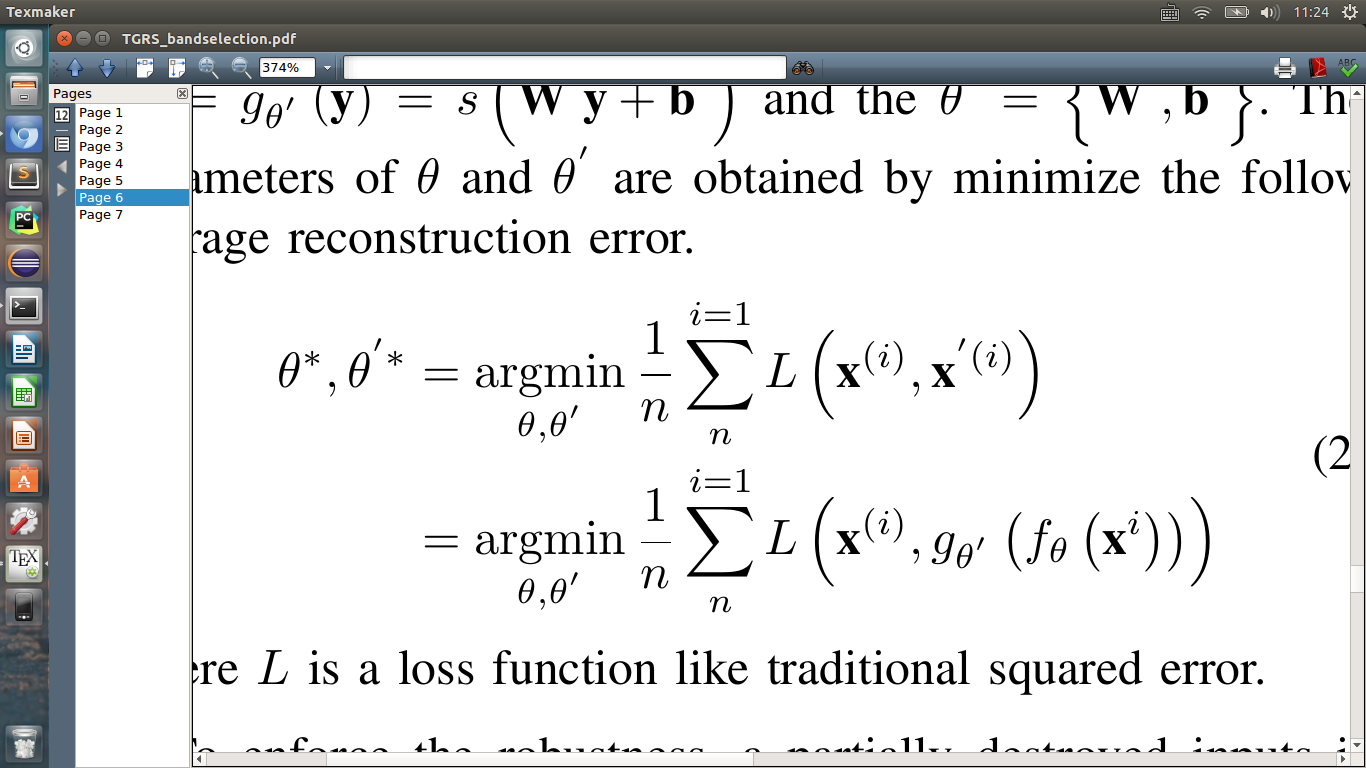

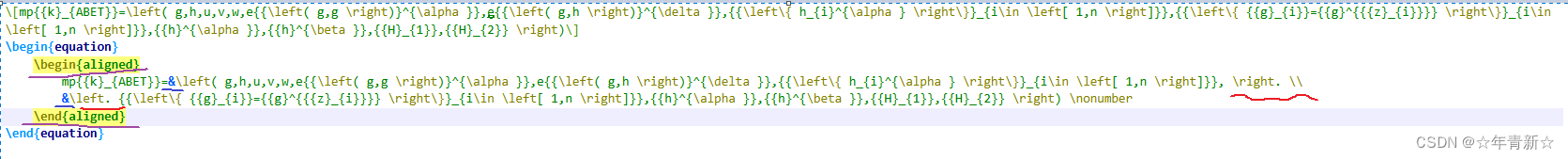

行间公式

代码:

#错误示范

\[mp{{k}_{ABET}}=\left( g,h,u,v,w,e{{\left( g,g \right)}^{\alpha }},e{{\left( g,h \right)}^{\delta }},{{\left\{ h_{i}^{\alpha } \right\}}_{i\in \left[ 1,n \right]}},{{\left\{ {{g}_{i}}={{g}^{{{z}_{i}}}} \right\}}_{i\in \left[ 1,n \right]}},{{h}^{\alpha }},{{h}^{\beta }},{{H}_{1}},{{H}_{2}} \right)\]

#正确

\begin{equation}\begin{aligned}mp{{k}_{ABET}}=&\left( g,h,u,v,w,e{{\left( g,g \right)}^{\alpha }},e{{\left( g,h \right)}^{\delta }},{{\left\{ h_{i}^{\alpha } \right\}}_{i\in \left[ 1,n \right]}}, \right. \\&\left. {{\left\{ {{g}_{i}}={{g}^{{{z}_{i}}}} \right\}}_{i\in \left[ 1,n \right]}},{{h}^{\alpha }},{{h}^{\beta }},{{H}_{1}},{{H}_{2}} \right) \nonumber\end{aligned}

\end{equation}

说明:

说明:

\begin{equation}\begin{aligned}等式=&前半段内容 \right. \\&\left. 后半段内容\end{aligned}

\end{equation}

其中&为公式对齐