论文:https://arxiv.org/pdf/1809.11096.pdf

源码:https://github.com/ajbrock/BigGAN-PyTorch

用于高保真自然图像合成的大规模GAN训练

摘要

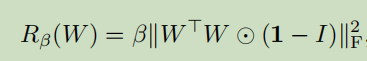

尽管最近在生成图像建模方面取得了进展,但是从像ImageNet这样的复杂数据集中成功生成高分辨率、多样化的样本仍然是一个难以实现的问题。因此我们以最大规模训练了生成对抗网络,并研究了这种大规模所特有的不确定性。我们发现将正交正则化应用于生成器使得它适用于简单的“截断技巧”,允许通过截断潜在空间来精确控制样本保真度和变化之间的权衡。

我们的修改导致模型在类别条件下的图像合成中达到了新的技术水平。当我们使用128*128分辨率在ImageNet上进行训练时,我们的模型BigGAN的Inception Score(IS)为166.3,Frechet Inception Distance(FID)为9.6,相比之前的最佳IS为52.52,FID为18.65。

1 介绍

GANs训练是动态的,并且几乎对其设置的每个方面都很敏感(从优化参数到模型架构),不过大量的研究已经在经验和理论上都给到了证实,表明GANs可以在各种环境下进行稳定的训练。在这项工作上,我们着手缩小GAN生成的图像与ImageNet数据集中的真实图像之间的保真度和变化差距。我们为此目标的三个贡献如下:

- 我们证明了GAN从缩放中受益匪浅,并且与现有技术相比,训练模型的参数为2-4倍,batch大小达到8倍。我们介绍了两种简单的通用体系结构更改,可以提高可伸缩性,并修改正则化方案不断调节,从而显著提升性能。

- 作为我们修改的副作用,我们的模型变的适合“截断技巧”,这是一种简单的采样技术,可以对样本类和保真度之间的权衡进行明确以及细粒度的控制。

- 我们发现特定于大规模GAN的不稳定性,并根据经验表征它们。利用此分析的见解,我们证明新颖技术和现有技术的结合可以减少这些不稳定性,但完全的训练稳定性只能以极高的性能成本实现。

2 背景

生成对抗网络:初识GAN(Generative Adversarial Nets)网络_HHzdh的博客-CSDN博客

CGAN:(CGAN)Conditional Generative Adversarial Nets原理_HHzdh的博客-CSDN博客

3 提升GANs规模

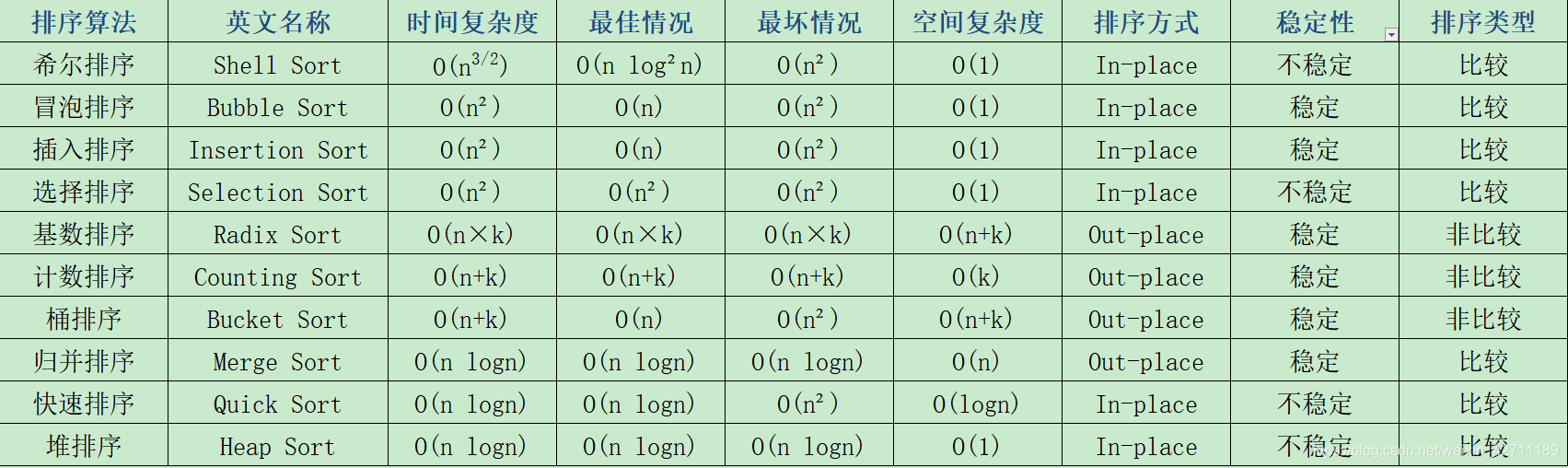

我们首先增加基线模型的批量大小,并立即发现这样做的巨大好处。表1的1-4行表明,简单地将批量大小增加8倍,使得现有技术IS提高了46%。我们推测这是每批次覆盖更多模式的结果,为两个网络提供了更好的梯度。这种缩放的一个值得注意的问题是我们的模型在更少的的迭代中达到更好的最终性能,单边的不稳定并且可能训练崩溃。

然后,我们将每层中的宽度(通道数)增加50%,大约两倍于两个模型中的参数数量。这导致IS进一步提高21%,我们认为这是由于模型的容量相对于数据集的复杂性而增加。加倍深度(通道数)似乎不会对ImageNet模型产生相同的影响,反而会降低性能。

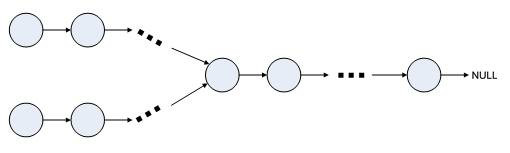

我们注意到用于G中的条件BatchNorm图层的类嵌入c包含大量权重。我们选择使用共享嵌入,而不是为每个嵌入分别设置一个层,这个嵌入会线性投影到每个层的增益和偏差。这降低了计算和内存成本,并将训练速度(达到给定性能所需要的迭代次数)提高了37%。接下来,我们采用分层潜在空间的变体,其中噪声向量z被奎送到G的多个层而不仅仅是初始层。这种设置背后的直觉是允许G使用潜在空间直接影响不同分辨率和层次结构级别的特征。对于我们的架构,通过将在z分成每个分辨率的一个块,并将每个块连接到条件向量c,可以很容易实现这一点,条件向量c被投射到BatchNorm的增益和偏差。

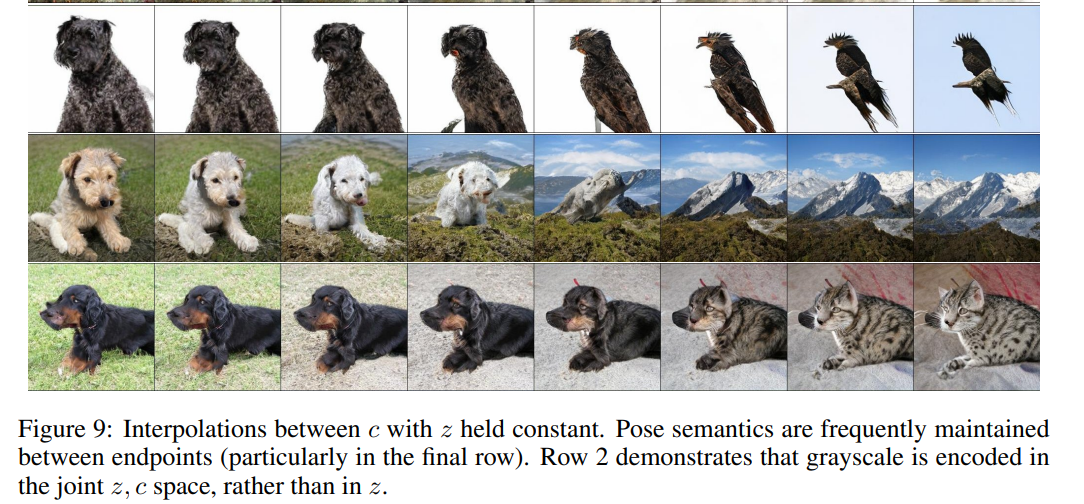

3.1 使用截断技巧处理各种各样的信息

(b)将阶段应用于条件差的模型的饱和度假象

所谓的“截断技巧”就是在对从先验分布 z 采样的过程中,通过设置阈值的方式来截断 z 的采样,超出范围的值被舍弃并且重新采样以落入该范围内。这个阈值可以根据生成质量指标 IS 和 FID 决定。随着截断的阈值下降,生成的质量在提高,但是生成也趋近于单一化。所以根据实验的生成要求,权衡生成质量和生成多样性是一个抉择,往往阈值的下降会带来 IS 的一路上涨,但是 FID 会先变好后一路变差。

还有在一些较大的模型不适合截断,在嵌入截断噪声时会产生饱和伪影,如上图 (b) 所示,为了抵消这种情况,文章通过将 G 调节为平滑来强制执行截断的适应性,以便 z 的整个空间将映射到良好的输出样本,并采用正交正则化解决该问题。

总之,BigGAN其实是提供了一种大规模训练GAN的方法,并且针对具体训练过程中可能存在的不稳定性提出了一些应对技巧。但是不得不说,从结果来看,这种方法对于GAN的效果提升是巨大的。

3.2 网络架构

1 论文给出的结构

(b)生成器网络中的残差模块(up)

(c)判别器网络中的残差模块(down)

2 另一种差不多的结构

(b)生成器网络中的残差模块(up)

(c)判别器网络中的残差模块(down)