1. 概述

在机器学习算法中,有一个重要的概念就是损失函数(Loss Function)。损失函数的作用就是度量模型的预测值 f ( x ) f\left ( \mathbf{x} \right ) f(x)与真实值 y \mathbf{y} y之间的差异程度的函数,且是一个非负实值函数。

对于分类问题损失函数通常可以表示成损失项和正则项的和,即有如下的形式:

J ( w ) = ∑ i L ( m i ( w ) ) + λ R ( w ) J\left ( \mathbf{w} \right )=\sum_{i}L\left ( m_i\left (\mathbf{ w} \right ) \right )+\lambda R\left ( \mathbf{w} \right ) J(w)=i∑L(mi(w))+λR(w)

其中, L ( m i ( w ) ) L\left ( m_i\left (\mathbf{ w} \right ) \right ) L(mi(w))为损失项, R ( w ) R\left ( \mathbf{w} \right ) R(w)为正则项。 m i m_i mi的具体形式如下:

m i = y ( i ) f w ( x ( i ) ) m_i=y^{\left ( i \right )}f_\mathbf{w}\left ( \mathbf{x}^{\left ( i \right )} \right ) mi=y(i)fw(x(i))

y ( i ) ∈ { − 1 , 1 } y^{\left ( i \right )}\in \left \{ -1,\;1 \right \} y(i)∈{−1,1}

f w ( x ( i ) ) = w T x ( i ) f_\mathbf{w}\left ( \mathbf{x}^{\left ( i \right )} \right )=\mathbf{w}^T\mathbf{x}^{(i)} fw(x(i))=wTx(i)

对于损失项,主要的形式有:

- 0-1损失

- Log损失

- Hinge损失

- 指数损失

- 感知损失

2. 0-1损失函数

在分类问题中,可以使用函数的正负号来进行模式判断,函数值本身的大小并不是很重要,0-1损失函数比较的是预测值 f w ( x ( i ) ) f_\mathbf{w}\left ( \mathbf{x}^{\left ( i \right )} \right ) fw(x(i))与真实值 y ( i ) y^{\left ( i \right )} y(i)的符号是否相同,0-1损失的具体形式如下:

L 01 ( m ) = { 0 if m ⩾ 0 1 if m < 0 L_{01}\left ( m \right )=\begin{cases} 0 & \text{ if } m\geqslant 0 \\ 1 & \text{ if } m< 0 \end{cases} L01(m)={01 if m⩾0 if m<0

以上的函数等价于下述的函数:

1 2 ( 1 − s i g n ( m ) ) \frac{1}{2}\left ( 1-sign\left ( m \right ) \right ) 21(1−sign(m))

0-1损失并不依赖 m m m值的大小,只取决于 m m m的正负号。0-1损失是一个非凸的函数,在求解的过程中,存在很多的不足,通常在实际的使用中将0-1损失函数作为一个标准,选择0-1损失函数的代理函数作为损失函数。

3. Log损失函数

3.1. Log损失

Log损失是0-1损失函数的一种代理函数,Log损失的具体形式如下:

l o g ( 1 + e x p ( − m ) ) log\left ( 1+exp\left ( -m \right ) \right ) log(1+exp(−m))

运用Log损失的典型分类器是Logistic回归算法。

3.2. Logistic回归算法的损失函数

对于Logistic回归算法,分类器可以表示为:

p ( y ∣ x ; w ) = σ ( w T x ) y ( 1 − σ ( w T x ) ) ( 1 − y ) p\left ( y\mid \mathbf{x}; \mathbf{w} \right )=\sigma \left ( \mathbf{w}^T\mathbf{x} \right )^y\left ( 1-\sigma \left ( \mathbf{w}^T\mathbf{x} \right ) \right )^{\left ( 1-y \right )} p(y∣x;w)=σ(wTx)y(1−σ(wTx))(1−y)

其中, y ∈ { 0 , 1 } y\in \left \{ 0,1 \right \} y∈{0,1}。为了求解其中的参数$ \mathbf{w}$,通常使用极大似然估计的方法,具体的过程如下:

1、似然函数

L ( w ) = ∏ i = 1 n σ ( w T x ( i ) ) y ( i ) ( 1 − σ ( w T x ( i ) ) ) ( 1 − y ( i ) ) L\left ( \mathbf{w} \right )=\prod_{i=1}^{n}\sigma \left ( \mathbf{w}^T\mathbf{x}^{\left ( i \right )} \right )^{y^{\left ( i \right )}}\left ( 1-\sigma \left ( \mathbf{w}^T\mathbf{x}^{\left ( i \right )} \right ) \right )^{\left ( 1-y^{\left ( i \right )} \right )} L(w)=i=1∏nσ(wTx(i))y(i)(1−σ(wTx(i)))(1−y(i))

其中,

σ ( x ) = 1 1 + e x p ( − x ) \sigma \left ( x \right )=\frac{1}{1+exp\left ( -x \right )} σ(x)=1+exp(−x)1

2、log似然

l o g L ( w ) = ∑ i = 1 n y ( i ) l o g ( σ ( w T x ( i ) ) ) + ( 1 − y ( i ) ) l o g ( 1 − σ ( w T x ( i ) ) ) logL\left ( \mathbf{w} \right )=\sum_{i=1}^{n}y^{\left ( i \right )}log\left ( \sigma \left ( \mathbf{w}^T\mathbf{x}^{\left ( i \right )} \right ) \right )+\left ( 1-y^{\left ( i \right )} \right )log\left ( 1-\sigma \left ( \mathbf{w}^T\mathbf{x}^{\left ( i \right )} \right )\right ) logL(w)=i=1∑ny(i)log(σ(wTx(i)))+(1−y(i))log(1−σ(wTx(i)))

3、需要求解的是使得log似然取得最大值的$ \mathbf{w}$,可以转换为求最小值:

− l o g L ( w ) = − ∑ i = 1 n y ( i ) l o g ( σ ( w T x ( i ) ) ) + ( 1 − y ( i ) ) l o g ( 1 − σ ( w T x ( i ) ) ) -logL\left ( \mathbf{w} \right )=-\sum_{i=1}^{n}y^{\left ( i \right )}log\left ( \sigma \left ( \mathbf{w}^T\mathbf{x}^{\left ( i \right )} \right ) \right )+\left ( 1-y^{\left ( i \right )} \right )log\left ( 1-\sigma \left ( \mathbf{w}^T\mathbf{x}^{\left ( i \right )} \right )\right ) −logL(w)=−i=1∑ny(i)log(σ(wTx(i)))+(1−y(i))log(1−σ(wTx(i)))

这便是交叉熵的具体形式。

3.3. 两者的等价

由于Log损失的具体形式为:

l o g ( 1 + e x p ( − m ) ) log\left ( 1+exp\left ( -m \right ) \right ) log(1+exp(−m))

其中, m = y ( i ) w T x ( i ) m=y^{\left ( i \right )}\mathbf{w}^T\mathbf{x}^{\left ( i \right )} m=y(i)wTx(i), y ( i ) ∈ { − 1 , 1 } y^{\left ( i \right )}\in \left \{ -1,1 \right \} y(i)∈{−1,1},Log损失函数的具体形式为:

m i n w ∑ i = 1 n l o g { 1 + e x p ( − y ( i ) w T x ( i ) ) } \underset{\mathbf{w}}{min}\sum_{i=1}^{n}log\left \{ 1+exp\left ( -y^{\left ( i \right )}\mathbf{w}^T\mathbf{x}^{\left ( i \right )} \right ) \right \} wmini=1∑nlog{1+exp(−y(i)wTx(i))}

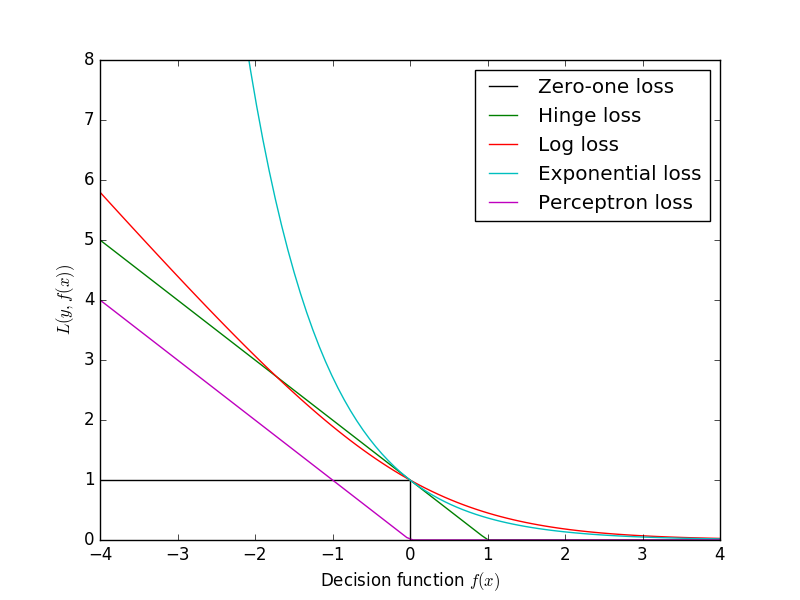

Logistic回归与Log损失具有相同的形式,故两者是等价的。Log损失与0-1损失的关系可见下图。

4. Hinge损失函数

4.1. Hinge损失

Hinge损失是0-1损失函数的一种代理函数,Hinge损失的具体形式如下:

m a x ( 0 , 1 − m ) max\left ( 0,1-m \right ) max(0,1−m)

运用Hinge损失的典型分类器是SVM算法。

4.2. SVM的损失函数

对于软间隔支持向量机,允许在间隔的计算中出现少许的误差 ξ ⃗ = ( ξ 1 , ⋯ , ξ n ) \vec{\xi }=\left ( \xi _1,\cdots ,\xi _n \right ) ξ=(ξ1,⋯,ξn),其优化的目标为:

m i n w , γ , ξ [ 1 2 ∥ w ∥ 2 + C ∑ i = 1 n ξ i ] \underset{\mathbf{w},\gamma ,\xi }{min}\left [ \frac{1}{2}\left \| \mathbf{w} \right \|^2+C\sum_{i=1}^{n}\xi _i \right ] w,γ,ξmin[21∥w∥2+Ci=1∑nξi]

约束条件为:

( w T x ( i ) + γ ) y ( i ) ⩾ 1 − ξ i , ξ i ≥ 0 \left ( \mathbf{w}^T\mathbf{x}^{\left ( i \right )}+\gamma \right )y^{\left ( i \right )}\geqslant 1-\xi _i,\; \xi _i\geq 0 (wTx(i)+γ)y(i)⩾1−ξi,ξi≥0

4.3. 两者的等价

对于Hinge损失:

m a x ( 0 , 1 − m ) max\left ( 0,1-m \right ) max(0,1−m)

优化的目标是要求:

m i n w [ ∑ i = 1 n m a x ( 0 , 1 − f w ( x ( i ) ) y ( i ) ) ] \underset{\mathbf{w}}{min}\; \left [ \sum_{i=1}^{n}max\left ( 0,1-f_\mathbf{w}\left ( \mathbf{x}^{\left ( i \right )} \right )y^{\left ( i \right )} \right ) \right ] wmin[i=1∑nmax(0,1−fw(x(i))y(i))]

在上述的函数 f w ( x ( i ) ) f_\mathbf{w}\left ( \mathbf{x}^{\left ( i \right )} \right ) fw(x(i))中引入截距$\gamma $,即:

f w , γ ( x ( i ) ) = w T x ( i ) + γ f_{\mathbf{w},\gamma }\left ( \mathbf{x}^{\left ( i \right )} \right )=\mathbf{w}^T\mathbf{x}^{\left ( i \right )}+\gamma fw,γ(x(i))=wTx(i)+γ

并在上述的最优化问题中增加 L 2 L_2 L2正则,即变成:

m i n w , γ [ C ∑ i = 1 n m a x ( 0 , 1 − f w , γ ( x ( i ) ) y ( i ) ) + 1 2 ∥ w ∥ 2 ] \underset{\mathbf{w},\gamma }{min}\; \left [ C\sum_{i=1}^{n}max\left ( 0,1-f_{\mathbf{w},\gamma }\left ( \mathbf{x}^{\left ( i \right )} \right )y^{\left ( i \right )} \right )+\frac{1}{2}\left \| \mathbf{w} \right \|^2 \right ] w,γmin[Ci=1∑nmax(0,1−fw,γ(x(i))y(i))+21∥w∥2]

至此,令下面的不等式成立:

m a x ( 0 , 1 − f w , γ ( x ) y ) = m i n ξ ξ max\left ( 0,1-f_{\mathbf{w},\gamma }\left ( \mathbf{x} \right )y \right )=\underset{\xi }{min}\xi max(0,1−fw,γ(x)y)=ξminξ

约束条件为:

ξ ⩾ 1 − f w , γ ( x ) y ; ξ ⩾ 0 \xi \geqslant 1-f_{\mathbf{w},\gamma }\left ( \mathbf{x} \right )y;\xi \geqslant 0 ξ⩾1−fw,γ(x)y;ξ⩾0

则Hinge最小化问题变成:

m i n w , γ , ξ [ C ∑ i = 1 n ξ i + 1 2 ∥ w ∥ 2 ] \underset{\mathbf{w},\gamma ,\xi }{min}\; \left [ C\sum_{i=1}^{n}\xi _i+\frac{1}{2}\left \| \mathbf{w} \right \|^2 \right ] w,γ,ξmin[Ci=1∑nξi+21∥w∥2]

约束条件为:

ξ i ⩾ 1 − ( w T x ( i ) + γ ) y ( i ) ; ξ i ⩾ 0 \xi _i\geqslant 1-\left ( \mathbf{w}^T\mathbf{x}^{\left ( i \right )}+\gamma \right )y^{\left ( i \right )};\xi _i\geqslant 0 ξi⩾1−(wTx(i)+γ)y(i);ξi⩾0

这与软间隔的SVM是一致的,说明软间隔SVM是在Hinge损失的基础上增加了 L 2 L_2 L2正则。

5. 指数损失

5.1. 指数损失

指数损失是0-1损失函数的一种代理函数,指数损失的具体形式如下:

e x p ( − m ) exp\left ( -m \right ) exp(−m)

运用指数损失的典型分类器是AdaBoost算法。

5.2. AdaBoost基本原理

AdaBoost算法是对每一个弱分类器以及每一个样本都分配了权重,对于弱分类器 φ j \varphi _j φj的权重为:

θ j = 1 2 l o g 1 − R ( φ j ) R ( φ j ) \theta _j=\frac{1}{2}log\frac{1-R\left ( \varphi _j \right )}{R\left ( \varphi _j \right )} θj=21logR(φj)1−R(φj)

其中, R ( φ j ) R\left ( \varphi _j \right ) R(φj)表示的是误分类率。对于每一个样本的权重为:

w i = e x p ( − f ( x ( i ) y ( i ) ) ) ∑ n [ e x p ( − f ( x ( i ) y ( i ) ) ) ] w_i=\frac{exp\left ( -f\left ( x^{\left ( i \right )}y^{\left ( i \right )} \right ) \right )}{\sum_{n}\left [ exp\left ( -f\left ( x^{\left ( i \right )}y^{\left ( i \right )} \right ) \right ) \right ]} wi=∑n[exp(−f(x(i)y(i)))]exp(−f(x(i)y(i)))

最终通过对所有分类器加权得到最终的输出。

5.3. 两者的等价

对于指数损失函数:

e x p ( − m ) exp\left ( -m \right ) exp(−m)

可以得到需要优化的损失函数:

m i n θ [ ∑ i = 1 n e x p ( − f θ ( x ( i ) ) y ( i ) ) ] \underset{\mathbf{\theta }}{min}\; \left [ \sum_{i=1}^{n}exp\left ( -f_\mathbf{\theta }\left ( \mathbf{x}^{\left ( i \right )} \right )y^{\left ( i \right )} \right ) \right ] θmin[i=1∑nexp(−fθ(x(i))y(i))]

假设 f ~ \tilde{f} f~表示已经学习好的函数,则有:

m i n θ , φ [ ∑ i = 1 n e x p ( − { f ~ θ ( x ( i ) ) + θ φ ( x ( i ) ) } y ( i ) ) ] \underset{\mathbf{\theta },\varphi }{min}\; \left [ \sum_{i=1}^{n}exp\left ( -\left \{ \tilde{f}_\mathbf{\theta }\left ( \mathbf{x}^{\left ( i \right )} \right )+\theta \varphi \left ( \mathbf{x}^{\left ( i \right )} \right ) \right \}y^{\left ( i \right )} \right ) \right ] θ,φmin[i=1∑nexp(−{f~θ(x(i))+θφ(x(i))}y(i))]

= m i n θ , φ [ ∑ i = 1 n w i ~ e x p ( − θ φ ( x ( i ) ) y ( i ) ) ] =\underset{\mathbf{\theta },\varphi }{min}\; \left [ \sum_{i=1}^{n}\tilde{w_i}exp\left ( -\theta \varphi \left ( \mathbf{x}^{\left ( i \right )} \right ) y^{\left ( i \right )} \right ) \right ] =θ,φmin[i=1∑nwi~exp(−θφ(x(i))y(i))]

而:

∑ i = 1 n w i ~ e x p ( − θ φ ( x ( i ) ) y ( i ) ) = { e x p ( θ ) − e x p ( − θ ) } ∑ i = 1 n w i ~ 2 ( 1 − φ ( x ( i ) ) y ( i ) ) + e x p ( − θ ) ∑ i = 1 n w i ~ \sum_{i=1}^{n}\tilde{w_i}exp\left ( -\theta \varphi \left ( \mathbf{x}^{\left ( i \right )} \right ) y^{\left ( i \right )} \right )\\ =\left \{ exp\left ( \theta \right ) - exp\left ( -\theta \right ) \right \}\sum_{i=1}^{n}\frac{\tilde{w_i}}{2}\left ( 1-\varphi \left ( \mathbf{x}^{\left ( i \right )} \right ) y^{\left ( i \right )} \right )+exp\left ( -\theta \right )\sum_{i=1}^{n}\tilde{w_i} i=1∑nwi~exp(−θφ(x(i))y(i))={exp(θ)−exp(−θ)}i=1∑n2wi~(1−φ(x(i))y(i))+exp(−θ)i=1∑nwi~

通过最小化$\varphi $,可以得到:

φ ^ = a r g m i n φ ∑ i = 1 n w ~ i 2 ( 1 − φ ( x ( i ) ) y ( i ) ) \hat{\varphi }=\underset{\varphi }{argmin}\sum_{i=1}^{n}\frac{\tilde{w}_i}{2}\left ( 1-\varphi \left ( \mathbf{x}^{\left ( i \right )} \right ) y^{\left ( i \right )} \right ) φ^=φargmini=1∑n2w~i(1−φ(x(i))y(i))

将其代入上式,进而对$\theta $求最优解,得:

θ ^ = 1 2 l o g 1 − R ^ R ^ \hat{\theta }=\frac{1}{2}log\frac{1-\hat{R}}{\hat{R}} θ^=21logR^1−R^

其中,

R ^ = { ∑ i = 1 n w ~ i 2 ( 1 − φ ( x ( i ) ) y ( i ) ) } / { ∑ i = 1 n w ~ i } \hat{R}=\left \{ \sum_{i=1}^{n}\frac{\tilde{w}_i}{2}\left ( 1-\varphi \left ( \mathbf{x}^{\left ( i \right )} \right ) y^{\left ( i \right )} \right ) \right \}/\left \{ \sum_{i=1}^{n}\tilde{w}_i \right \} R^={i=1∑n2w~i(1−φ(x(i))y(i))}/{i=1∑nw~i}

可以发现,其与AdaBoost是等价的。

6. 感知损失

6.1. 感知损失

感知损失是Hinge损失的一个变种,感知损失的具体形式如下:

m a x ( 0 , − m ) max\left ( 0,\; -m \right ) max(0,−m)

运用感知损失的典型分类器是感知机算法。

6.2. 感知机算法的损失函数

感知机算法只需要对每个样本判断其是否分类正确,只记录分类错误的样本,其损失函数为:

m i n w , b [ − ∑ i = 1 n y ( i ) ( w T x ( i ) + b ) ] \underset{\mathbf{w},\mathbf{b}}{min}\left [ -\sum_{i=1}^{n}y^{\left ( i \right )}\left ( \mathbf{w}^T\mathbf{x}^{\left ( i \right )} + \mathbf{b}\right ) \right ] w,bmin[−i=1∑ny(i)(wTx(i)+b)]

5.3. 两者的等价

对于感知损失:

m a x ( 0 , − m ) max\left ( 0,\; -m \right ) max(0,−m)

优化的目标为:

m i n w [ ∑ i = 1 n m a x ( 0 , − f w ( x ( i ) ) y ( i ) ) ] \underset{\mathbf{w}}{min}\; \left [ \sum_{i=1}^{n}max\left ( 0,-f_\mathbf{w}\left ( \mathbf{x}^{\left ( i \right )} \right )y^{\left ( i \right )} \right ) \right ] wmin[i=1∑nmax(0,−fw(x(i))y(i))]

在上述的函数 f w ( x ( i ) ) f_\mathbf{w}\left ( \mathbf{x}^{\left ( i \right )} \right ) fw(x(i))中引入截距 b \mathbf{b} b,即:

f w , γ ( x ( i ) ) = w T x ( i ) + b f_{\mathbf{w},\gamma }\left ( \mathbf{x}^{\left ( i \right )} \right )=\mathbf{w}^T\mathbf{x}^{\left ( i \right )}+\mathbf{b} fw,γ(x(i))=wTx(i)+b

上述的形式转变为:

m i n w , b [ ∑ i = 1 n m a x ( 0 , − ( w T x ( i ) + b ) y ( i ) ) ] \underset{\mathbf{w},\mathbf{b}}{min}\; \left [ \sum_{i=1}^{n}max\left ( 0,-\left ( \mathbf{w}^T\mathbf{x}^{\left ( i \right )}+\mathbf{b} \right )y^{\left ( i \right )} \right ) \right ] w,bmin[i=1∑nmax(0,−(wTx(i)+b)y(i))]

对于max函数中的内容,可知:

m a x ( 0 , − ( w T x ( i ) + b ) y ( i ) ) ⩾ 0 max\left ( 0,-\left ( \mathbf{w}^T\mathbf{x}^{\left ( i \right )}+\mathbf{b} \right )y^{\left ( i \right )} \right )\geqslant 0 max(0,−(wTx(i)+b)y(i))⩾0

对于错误的样本,有:

m a x ( 0 , − ( w T x ( i ) + b ) y ( i ) ) = − ( w T x ( i ) + b ) y ( i ) max\left ( 0,-\left ( \mathbf{w}^T\mathbf{x}^{\left ( i \right )}+\mathbf{b} \right )y^{\left ( i \right )} \right )= -\left ( \mathbf{w}^T\mathbf{x}^{\left ( i \right )}+\mathbf{b} \right )y^{\left ( i \right )} max(0,−(wTx(i)+b)y(i))=−(wTx(i)+b)y(i)

类似于Hinge损失,令下式成立:

m a x ( 0 , − f w , b ( x ) y ) = m i n ξ ξ max\left ( 0,-f_{\mathbf{w},\mathbf{b} }\left ( \mathbf{x} \right )y \right )=\underset{\xi }{min}\xi max(0,−fw,b(x)y)=ξminξ

约束条件为:

ξ ⩾ − f w , b ( x ) y \xi \geqslant -f_{\mathbf{w},\mathbf{b} }\left ( \mathbf{x} \right )y ξ⩾−fw,b(x)y

则感知损失变成:

m i n ξ [ ∑ i = 1 n ξ i ] \underset{\xi }{min}\; \left [ \sum_{i=1}^{n}\xi _i\right ] ξmin[i=1∑nξi]

即为:

m i n w , b [ − ∑ i = 1 n y ( i ) ( w T x ( i ) + b ) ] \underset{\mathbf{w},\mathbf{b}}{min}\left [ -\sum_{i=1}^{n}y^{\left ( i \right )}\left ( \mathbf{w}^T\mathbf{x}^{\left ( i \right )} + \mathbf{b}\right ) \right ] w,bmin[−i=1∑ny(i)(wTx(i)+b)]

Hinge损失对于判定边界附近的点的惩罚力度较高,而感知损失只要样本的类别判定正确即可,而不需要其离判定边界的距离,这样的变化使得其比Hinge损失简单,但是泛化能力没有Hinge损失强。

import matplotlib.pyplot as plt

import numpy as npxmin, xmax = -4, 4

xx = np.linspace(xmin, xmax, 100)

plt.plot([xmin, 0, 0, xmax], [1, 1, 0, 0], 'k-', label="Zero-one loss")

plt.plot(xx, np.where(xx < 1, 1 - xx, 0), 'g-', label="Hinge loss")

plt.plot(xx, np.log2(1 + np.exp(-xx)), 'r-', label="Log loss")

plt.plot(xx, np.exp(-xx), 'c-', label="Exponential loss")

plt.plot(xx, -np.minimum(xx, 0), 'm-', label="Perceptron loss")plt.ylim((0, 8))

plt.legend(loc="upper right")

plt.xlabel(r"Decision function $f(x)$")

plt.ylabel("$L(y, f(x))$")

plt.show()

参考文章

[1] Advice for applying Machine Learning

[2] 损失函数(Loss Function)

[3] Schroff F , Kalenichenko D , Philbin J . FaceNet: A Unified Embedding for Face Recognition and Clustering[J]. IEEE, 2015.