目录

1 差分放大电路的基本组成

1.1 抑制零漂的原理

1.2 差模信号和共模信号的区分

2 长尾式差分放大电路

2.1 静态分析

2.2 动态分析

3 差分放大电路的四种输出方式

差分放大电路是一种常见的电子放大电路,它利用差分信号输入来实现信号的放大。差分放大电路由两个输入信号和一个输出信号组成,输入信号相互之间呈差分(即两个信号之间的差值),输出信号是输入信号经过放大处理后的结果

差分放大电路通常用于抑制共模信号干扰和提高信号的共模抑制比。它可以在各种电路应用中使用,例如音频放大器、运算放大器、数据通信接口等。

1 差分放大电路的基本组成

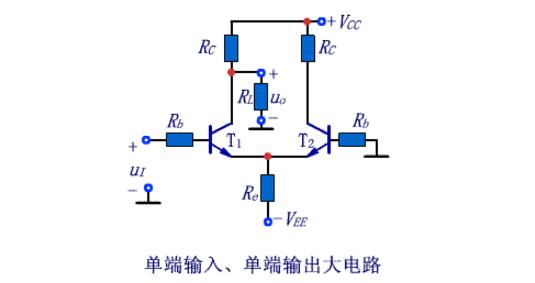

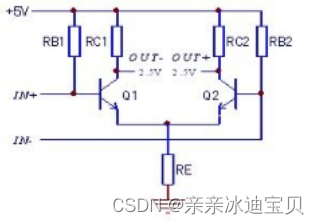

将两个电路结构,参数均相同的单管放大电路组合在一起,就成为了差分放大电路的基本组成,在理想状态下两部分三极管和电阻特性一致,当两端输入相等均为0时,此时输出也为0,温度升高时,Icq1升高,Ucq1减小,Icq2升高,Ucq2减小,两端变化相等相互抵消,有着抑制输出端零点漂移的作用。

1.1 抑制零漂的原理

假设两个上图的三极管放大倍数是,差分输入为

,两端的集电极输出电压的变化量分别为:

则放大电路的输出电压的变化为

=

+

=

由此可以看出差模放大倍数和单管电压放大倍数相同,多用一个放大管后,放大倍数没有提高,但是换来了对零漂的抑制。

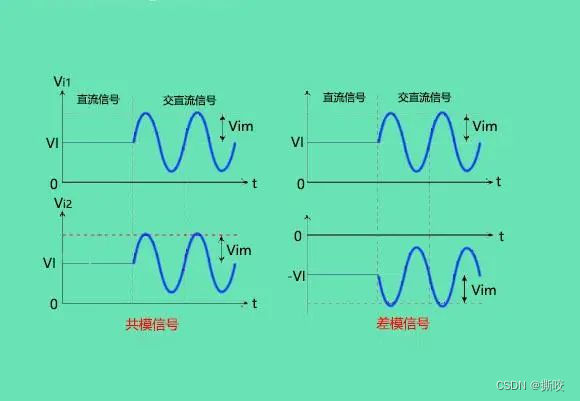

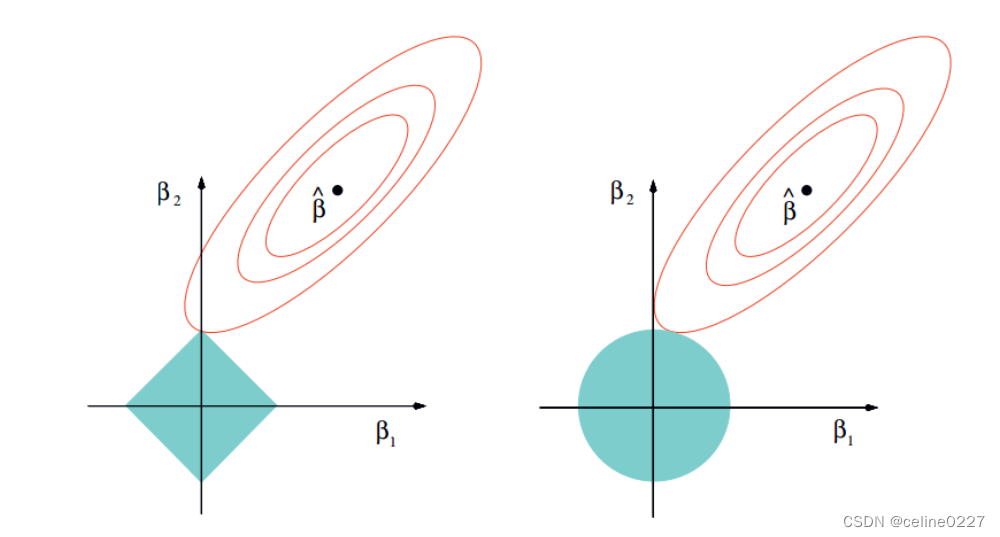

1.2 差模信号和共模信号的区分

如果差分两端输入电压大小相等、极性相反的信号叫做差模信号;如果两端输入电压大小相等、极性相同的信号,这样的信号叫做共模信号。理论上差分放大电路两个输入端加上任意大小相同,任意极性的输入信号和

都可以看做某个差模信号和某个共模信号的组合。其中差模信号

和共模信号

的值为

=

-

=

(

+

)

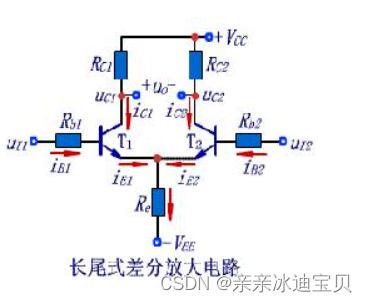

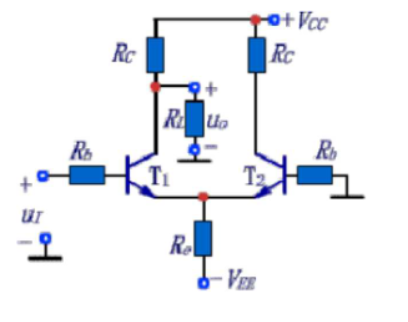

2 长尾式差分放大电路

长尾Re的作用是引入了一个共模负反馈,对差模信号无反馈作用,

假设存在一个正值的共模信号,两个晶体管的集电极电流ic都会增加,流到Re时的电流ie增加,此时就有Re的电位增加,反馈到两管的基极回路中,和

都会降低,限制了ic的增加。

Re越大,共模负反馈就越强,则抑制零漂的效果就越强随着Re的逐渐增大,直流压降越来越大,为了避免电压变化范围过大,在电路中引入一个负电源-VEE来补偿Re上的直流压降。

2.1 静态分析

基极电流为

+

+2

=

静态集电极电流

=

=

-

静态基极电位为

= -

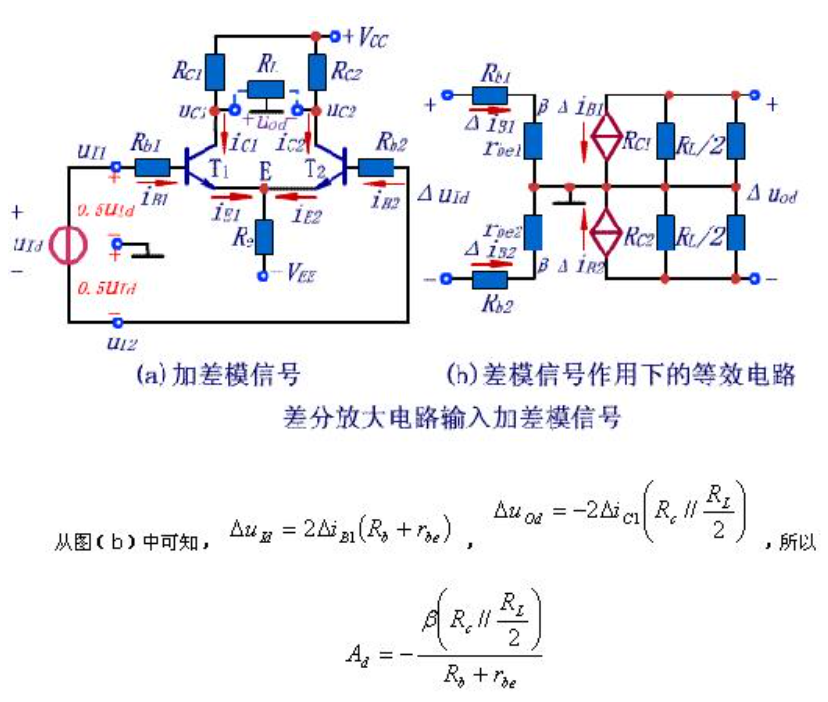

2.2 动态分析

由于接入Re后,差模信号流过Re的电流不变,Ue相当于一个固定电位,在交流通路中可以将Re短路。

差分放大电压和单管放大电压一致,是以牺牲一个管子为代价获得了抑制零漂的能力。

输入电阻和输出电阻分别为:

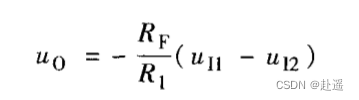

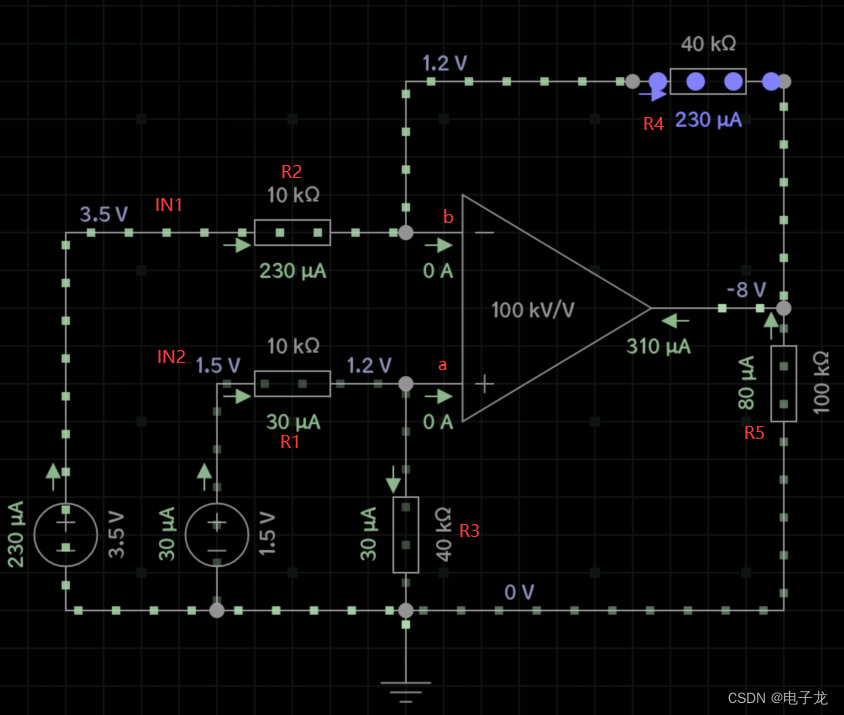

3 差分放大电路的四种输出方式

如图所示,差分信号输入放大过程可以分为以下几步。

1.在左侧输入信号,会在T1管的集电极输出反相放大的电压信号;

2.会在发射机输出同向放大的电流信号,假如底部是Re处是电流源的话,向下的电流会保持不变,此时电流信号输出给右侧晶体管的发射极端;

3、此时会有一个向上的电流,这个电流会分流出去,叠加在基极和集电极,使得两边的电流减小,由于集电极是基极的β倍,基极占比可以忽略不计,大部分叠加在集电极;

4、此时集电极电流减小,此时会在集电极输出放大的电压信号,和底部传入的电流信号相比,此信号是同向放大的电压信号,

左侧IB增大控制IC增大,IE=IB+IC,由于底部是恒流源,电流保持不变,此时电流流向右边。电流在右边叠加1在基极和集电极,会减小原有的电流,由于两个管子的参数基本一致,可以得出左边的增大量等于右边管子的减小量。所以可以在右边得到大小相同方向相反的波形。

这也就是差模关系,左侧输出反相放大信号,右边输出同向放大信号也是大小相同方向相反的差模关系。

此时单端输出单端输入时,假设放大倍数为10,那么左侧输出-10倍,右端输出是10倍。

如果是单端输入双端输出的话,左侧减右侧就是输出-20倍。

如果是双端输入的话,左端输入在左端输出-10倍,在右端输出10倍,右端的输入在左端输出10倍,右端输出-10倍,但是右端输入的信号为差模信号,所以叠加起来左端输出-20倍,右端输出20倍。

双端输入双端输出的话,左端减右端输出-40倍。