文章目录

- 感受野

- 增加感受野

- 有效感受野

- 与反卷积的区别

- 总结

感受野

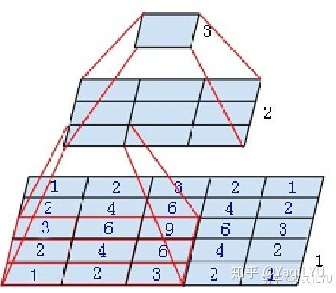

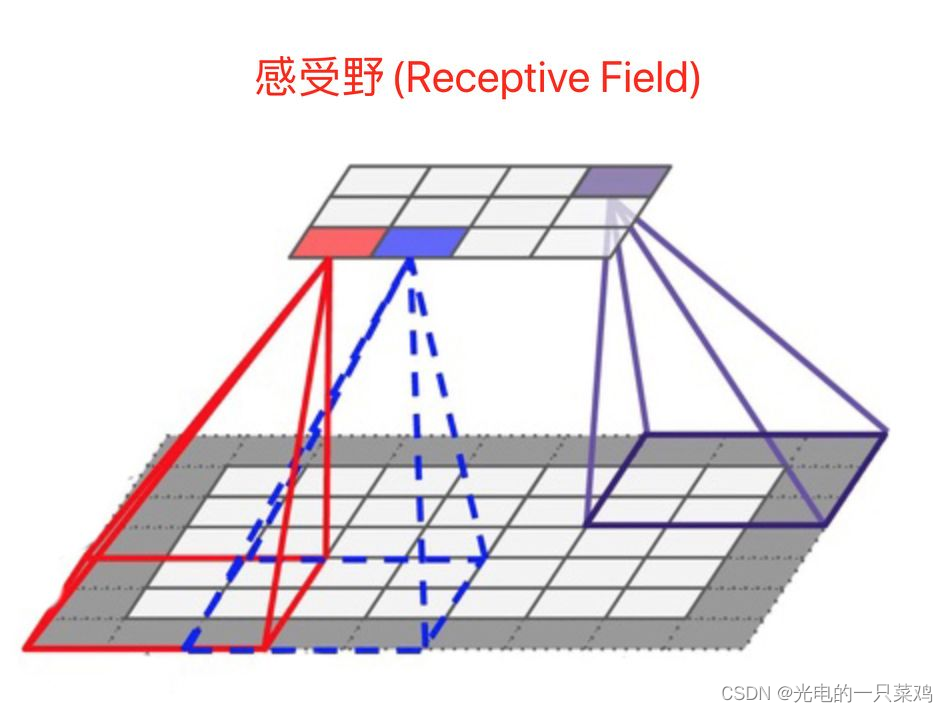

卷积核的大小(高度和宽度)定义了一个区域的空间范围,改区域可以被卷积核在每个卷积步骤中修改,因而卷积核的大小称为卷积核的“感受野”。

感受野(receptive field, RF),卷积神经网络每一层输出的特征图(feature map)上的特征点在原始图像上映射的区域大小,即特征点能“看”到的范围。越高(深)层的特征点描述的原图信息越全面,越能表述语义信息。

神经元之所以无法对原始图像的所有信息进行感知,是因为在卷积神经网络中普遍使用卷积层和pooling层,在层与层之间均为局部连接。

神经元感受野的值越大表示其能接触到的原始图像范围就越大,也意味着它可能蕴含更为全局,语义层次更高的特征;相反,值越小则表示其所包含的特征越趋向局部和细节。因此感受野的值可以用来大致判断每一层的抽象层次。

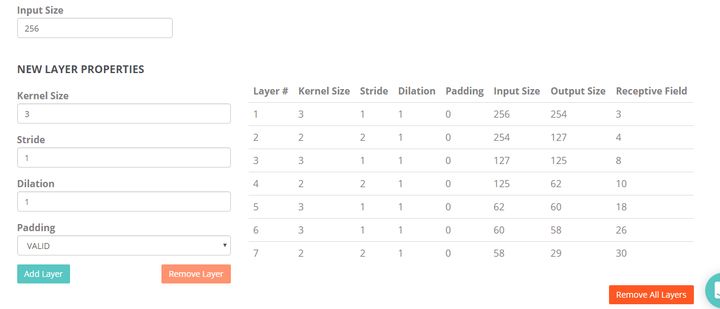

感受野计算公式:

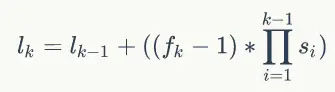

其中,L 表示感受野大小,f 表示卷积核(kernel size),s 表示卷积步长(stride)。起始卷积层(F0),感受野大小等于。

l k = f + n ( f − 1 ) l_k=f+n(f-1) lk=f+n(f−1)

其中, f k f_k fk表示第n层的卷积核大小, s i s_i si表示每一个前一层的步幅长度, l k − 1 l_{k-1} lk−1表示前一层的有效感受野。

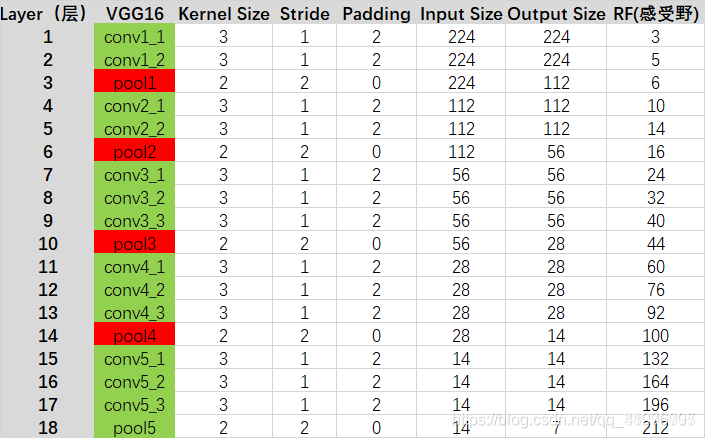

对于上图,计算上图感受野:

F0层: L0 = f = 3;

F1层: L1 = 3 + (3-1) * 1 = 5;

特别的,当前特征层(feature map)感受野与之前层相关,与当前层卷积核大小相关,与步长(stride),填充(padding)无关。理论感受野尺寸可以大于网络输入尺寸。

增加感受野

为了实现具有相对减少的参数数量的非常深的模型,成功的策略是将许多具有较小的感受野的卷积层堆叠。但是限制了所学习的卷积核的空间大小,其仅与层数线性地成比例。

扩张卷积(空洞卷积)

是一种扩展感受野大小而不增加参数数量的方法。中心思想是引入新的空洞参数(d),其在执行卷积时决定卷积核权重之间的间隔。一个因子为d的空洞意味着原始卷积核在每个元素之间扩展d-1个空格,并且中间的空位置用零填充。

将尺寸为fxf的卷积核放大到大小为f+(d-1)(f-1).对应于具有预定义卷积核大小f、零填充幅度p、步幅s、空洞因子d且高度h和宽度w的输入的卷积运算的输出维度如下

h ‘ = ( h − f − ( d − 1 ) ( f − 1 ) + s + 2 p ) / s h^`={(h-f-(d-1)(f-1)+s+2p)/s} h‘=(h−f−(d−1)(f−1)+s+2p)/s

w ‘ = ( w − f − ( d − 1 ) ( f − 1 ) + s + 2 p ) / s w^`={(w-f-(d-1)(f-1)+s+2p)/s} w‘=(w−f−(d−1)(f−1)+s+2p)/s

第n层的有效感受野可以表示为:

R F n = R F n − 1 + d ( f − 1 ) RF^n=RF^{n-1}+d(f-1) RFn=RFn−1+d(f−1),满足 R F 1 = f RF^1=f RF1=f

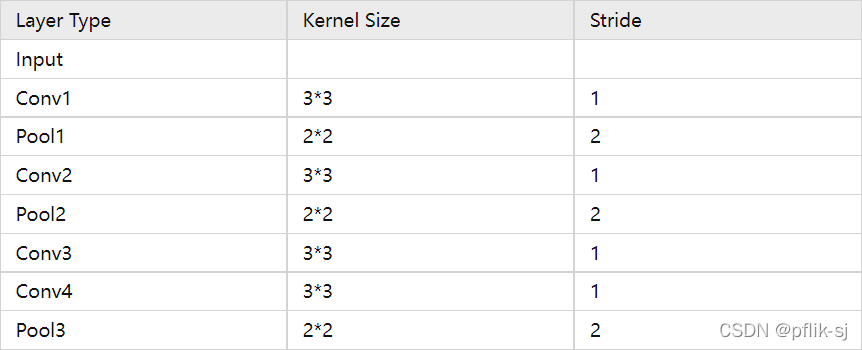

1)增加网络层数。特别的,增加网络层数时,对于 f!=1 的网络层数即使feature map大小没有改变,感受野也会增加。

1)增加网络层数。特别的,增加网络层数时,对于 f!=1 的网络层数即使feature map大小没有改变,感受野也会增加。

2)增加池化层。成倍的增加感受野。

3)更大的卷积核。通常为了保持feature map的尺寸,更大的卷积核需要相应的padding作为补充。例如,卷积核(k=3,s=2,p=0)与(k=7,s=2,p=3)能够获得相同尺寸的feature map,但后者的感受野要大于前者。

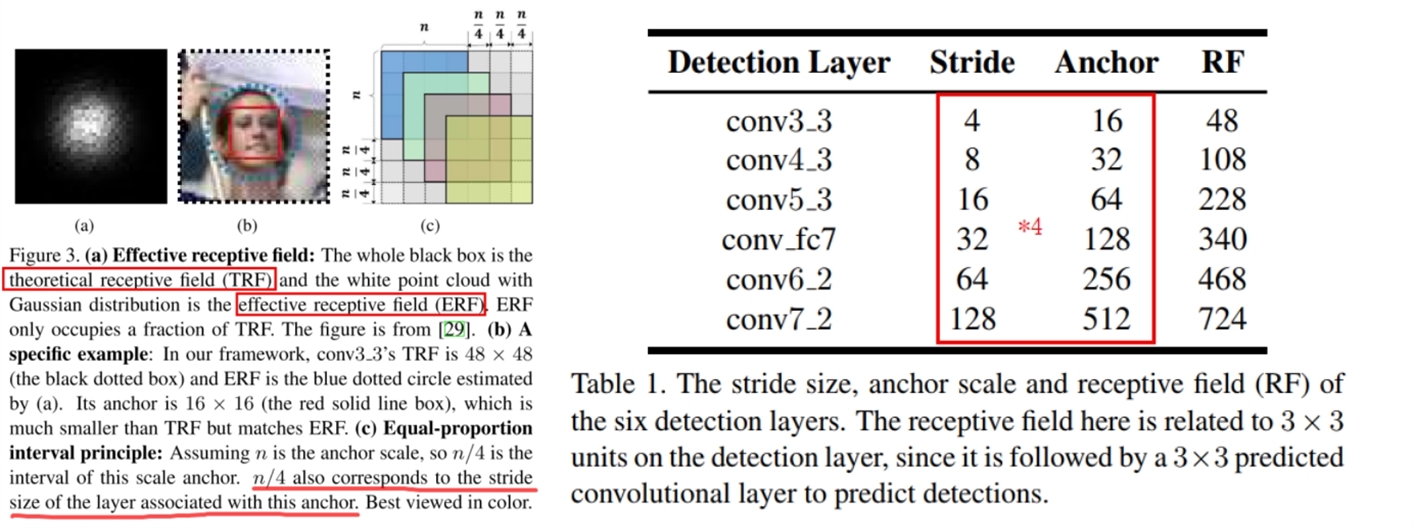

有效感受野

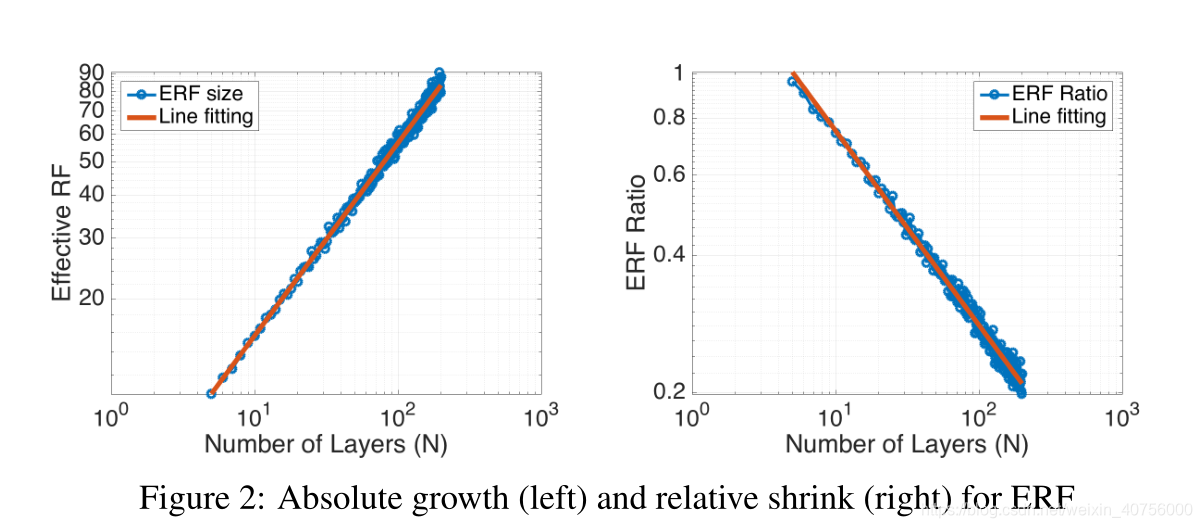

有效感受野(effective receptive field, ERF),在卷积计算时,实际有效的感受野区域。在F0特征层中,特征点6可以描述其他所有特征点的部分信息,即图中交叠部分,特征点6代表的信息更“有效”。即越靠近感受野中心的区域越有效。在网络训练时,有效感受野对参数的影响更大。

与反卷积的区别

反卷积(deconv):

主要用于增大图像尺寸,是upsampling的一种,而空洞卷积并没有做upsampling,空洞卷积是为了增大感受野,可以不改变图像的大小。

对于反卷积简单理解就是在输入特征矩阵中插入空白点,再进行卷积,这样卷积后输出的特征矩阵就变大了。

对于标准k*k卷积核,stride为s,分三种情况:

1) s>1,在卷积同时伴随着downsampling操作,卷积后图像变小了(这种操作也可以增大感受野,但是输出的图像大小变小了)

2) s=1,在padding设置为stride大小时,卷积后图片大小不变;

3)s<1,相当于对原图作upsampling操作进行扩大原图,然后再卷积,这样得到的结果图就变大了。例如s=0.5s=0.5s=0.5意味着在原特征图的每相邻数据间插入一个空白数据,这样再进行卷积,它的输出特征图就变大了。

上面3)所描述的就是反卷积,它的核心是在原来图像上插入空白数据。而空洞卷积就是在卷积核插入空白数据,或是说在卷积是跳过特征图的部分数据。

总结

神经网络中,感受野可以描述特征点的最大信息量,有效感受野则可以描述信息的有效性。充分理解感受野与有效感受野的概念,在设计网络时,可以依据此计算网络层数,卷积核大小,卷积步长。甚至根据任务不同,自动生成backbone。