目录

前言

CNN特征图可视化

感受野计算公式

计算Receptive Field Size的小程序

前言

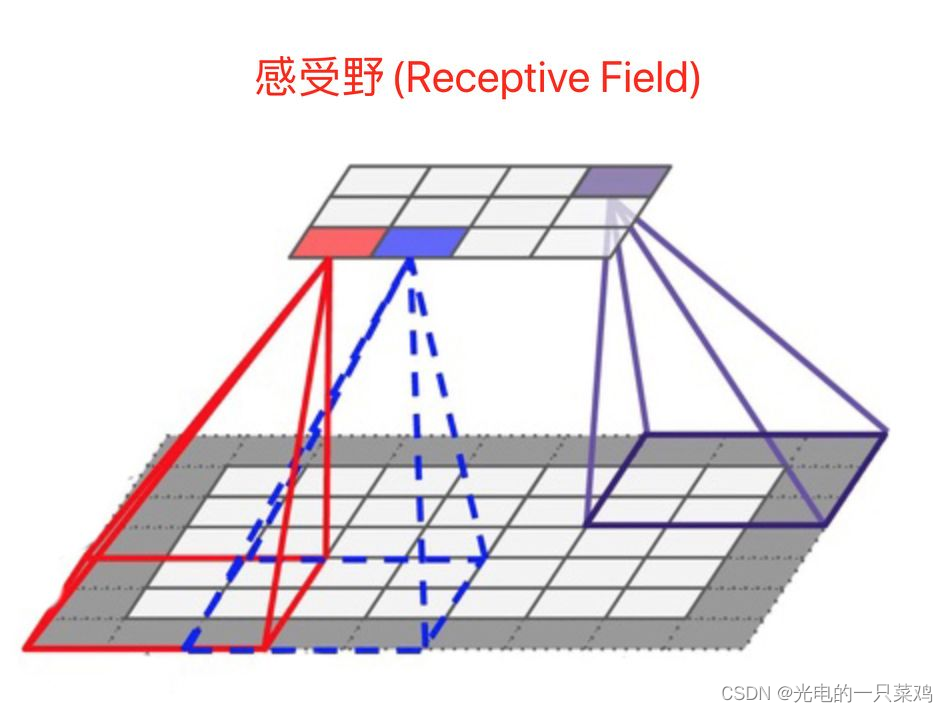

感受野(receptive field,RF)也许是CNN中最重要的概念之一,从文献上来看,它应当引起足够的重视。目前所有最好的图像识别方法都是在基于感受野理念来设计模型架构。然而,据我所知,目前并没有一个完整的教程来介绍如何计算并可视化一个CNN的感受野。这篇文章将填补这一空白,这里介绍CNN特征图可视化的一种新方法,可视化可以显示感受野信息,并且给出一个完整的感受野计算公式,它适用于任何CNN架构。我也实现了一个简单的程序来验证这个计算公式,任何人都可以利用该公式计算它们所设计的CNN的感受野,从而对所设计的架构有更多的认识。

要阅读这篇文章,你必须要熟悉CNN的核心概念,特别是卷积和池化操作。你可以通过阅读这篇论文(A guide to convolution arithmetic for deep learning)来复习CNN的基础知识。如果你对CNN有一定的了解,你将用不了半个小时来看完。这篇文章实际上是在这篇论文基础上完成的,使用相同的符号标记。

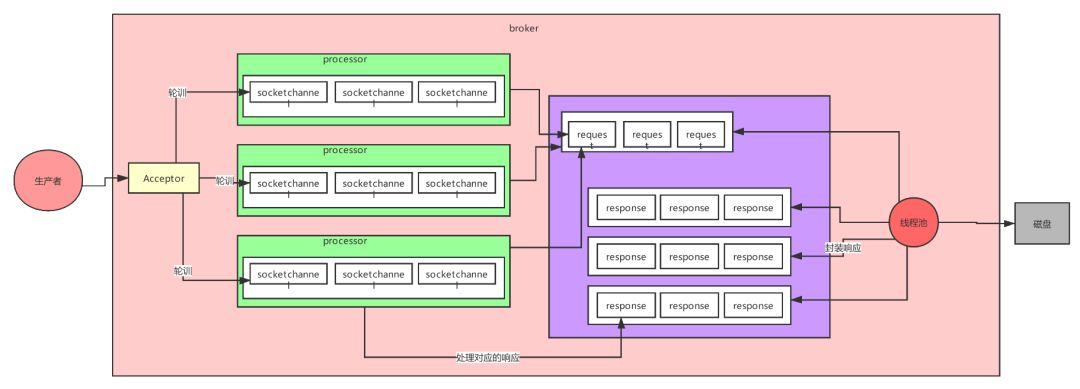

CNN特征图可视化

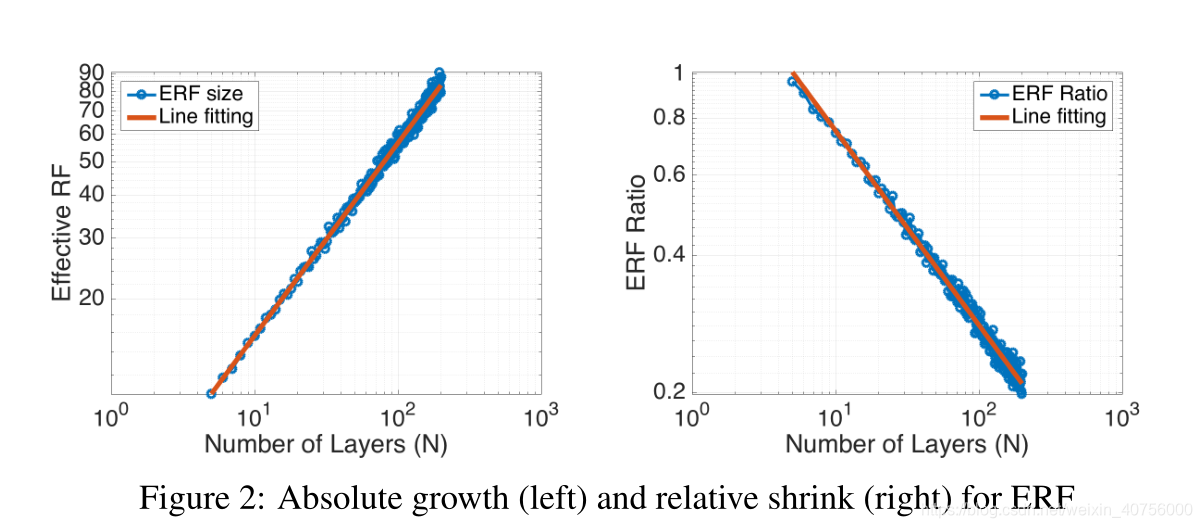

感受野指的是一个特定的CNN特征(特征图上的某个点)在输入空间所受影响的区域。一个感受野可以用中心位置(center location)和大小(size)来表征。然而,对于一个CNN特征来说,感受野中的每个像素值(pixel)并不是同等重要。一个像素点越接近感受野中心,它对输出特征的计算所起作用越大。这意味着某一个特征不仅仅是受限在输入图片中某个特定的区域(感受野),并且呈指数级聚焦在区域的中心。这个重要的发现会在下一篇文章中讲。现在,我们关注如何计算一个特定感受野的中心位置和大小。

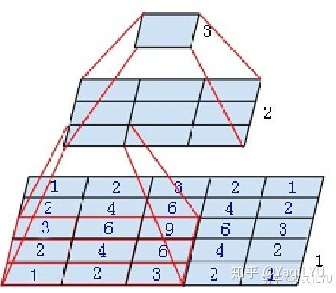

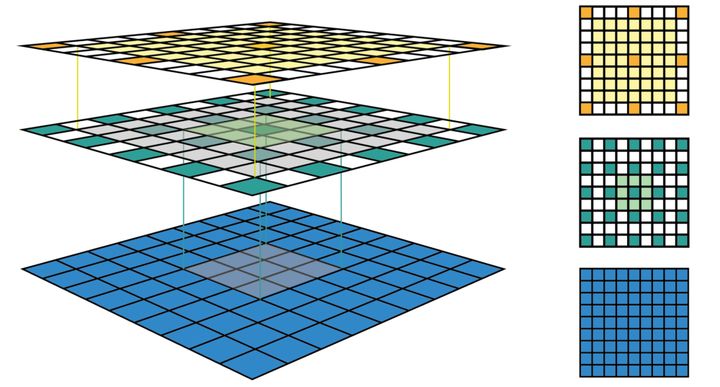

图1为给出了某些感受野实例。其中输入特征图大小为 ,采用的卷积参数如下:卷积核大小

,padding大小

,步长

。经过一次卷积之后,得到大小为

的输出特征图(绿色)。在这个特征图上继续采用相同的卷积,得到一个

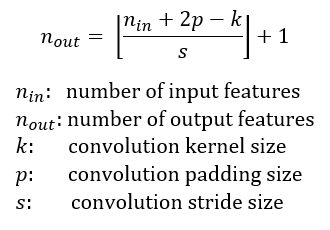

的特征图(橙色)。输出特征图的大小可以通过如下公式计算(参考A guide to convolution arithmetic for deep learning):

为了简化讲解,这里假定CNN架构是对称的,并且输入图片是方形的。因此所有的卷积层的所有参数在两个维度上都是相同的。如果CNN架构或者输入图片是非对称的,你可以为各个维度单独计算特征图的属性。

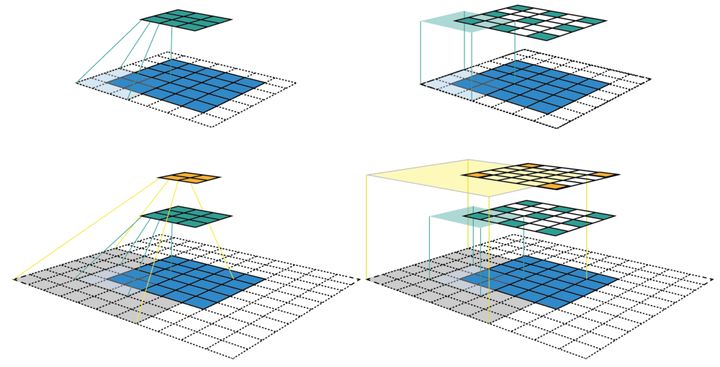

我们发现,图1左栏,feature map的size在不断减小;但是,图1右栏,每个feature神经元感知到的原图的size即感受野却没有减小,相反还增大了(从1*1到3*3再到7*7)。

图1的左栏给出了CNN特征图可视化最常用的方式。在这个可视化中,我们可以看到每个特征图所包含的特征数,但是很难知道每个特征的感受野的中心位置和大小,对于深度CNN,我们没有办法追踪到感受野信息。右栏给出的是固定大小的CNN可视化,所有的特征图固定大小并保持与输入特征图大小一致,这可以解决前面的问题。每个特征被标记在其感受野所在的中心(从而定位出感受野中心位置)。由于一个特征图中所有的特征都有相同大小的感受野,我们可以简单地在每个特征周围画出一个边界框,从而获得感受野的大小。我们也没有必要将这个边界框向下映射到输入层,因为特征图已经与输入层具有相同的大小。图2给出了另外一个实例,其中输入特征图更大,为 ,与前面例子采用相同的卷积。图的左栏和右栏分别给出了固定大小CNN特征图的3D和2D可视化。可以看出感受野大小增加迅速,以至于第二个特征层的中心特征的感受野已经覆盖了整个输入特征图。这在深度CNN中是一个很重要的设计理念以提升性能。

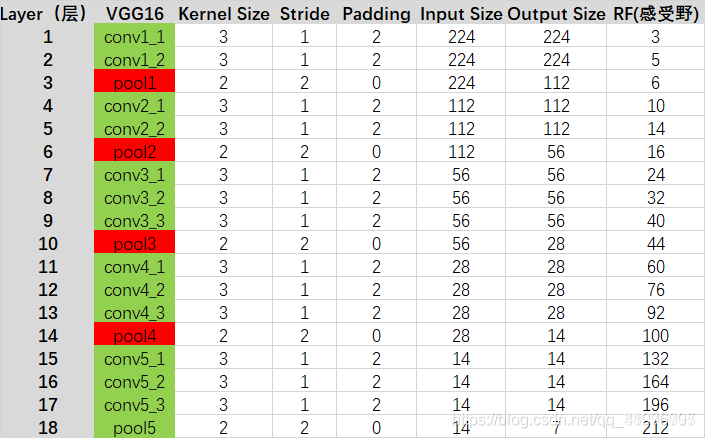

感受野计算公式

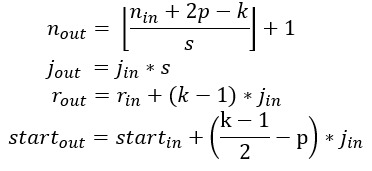

为了计算CNN每一层的感受野,除了要知道特征图每个维度的特征数 ,还需要记录每一层的其他信息,这包括当前层的感受野大小

,两个相邻特征的距离(跳跃的距离,如前面可视化所示)

,和左上角特征(第一个特征)的中心坐标

。注意感受野(其实是特征图第一个特征的感受野)的中心坐标就等于这个特征的中心坐标,就如前面可视化中所示。当采用的卷积其核大小为

,padding大小为

,步长为

,输出特征图的感受野可以按照如下公式计算:

- 第一个式子根据输入特征图大小以及卷积参数计算输出特征图大小,前面已经说过。

- 第二个式子计算输出特征图的特征间的间隔

,其等于上一层的间隔值乘以卷积的步长,所以间隔值将是按照步长呈指数级增长。

- 第三个式子计算输出特征图的感受野大小,其等于前一层感受野大小加上

,所以感受野是呈指数级增加,并且还有一个因子

。

- 第四个式子计算输出特征图的第一个特征感受野的中心坐标,其等于第一层的中心坐标加上

,再减去

,注意两项都要乘以前一层的间隔距离以得到实际距离。

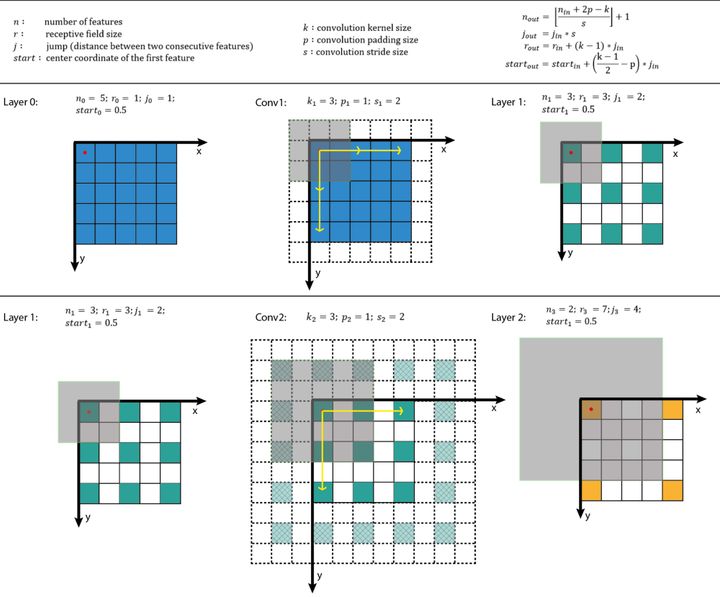

对于第一层,一般是输入图片,其各项值为: 。图3给出了一个如何计算感受野的实例,图中的坐标系统中,输入层的第一个特征中心位置记为

。通过利用上面公式迭代地进行计算,你可以计算出CNN中所有特征图的感受野信息。

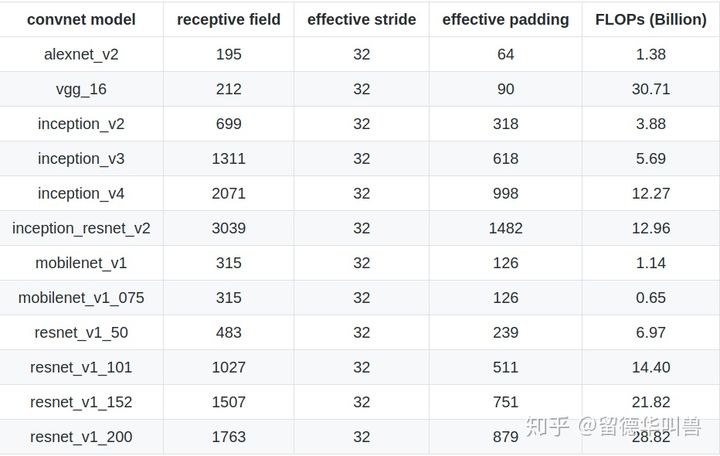

计算Receptive Field Size的小程序

1)Tensorflow自带的rf函数

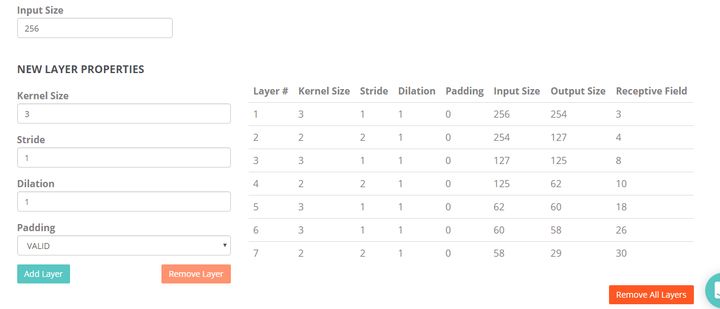

2) FOMORO AI

一个带有UI的程序