最近博主再看西瓜书第十三章半监督学习,文章中作者提到需要少量查询的主动学习、K-means簇的聚类,以及流行学习。对于流行学习,博主也是第一次接触,下面我们来简单学习和理解一下流行学习。

1. 半监督学习

SSL的成立依赖于模型假设,当模型假设正确时,无类标签的样例能够帮助改进学习性能。SSL依赖的假设有以下三个:

1)平滑假设(Smoothness Assumption):位于稠密数据区域的两个距离很近的样例的类标签相似,也就是说,当两个样例被稠密数据区域中的边连接时,它们在很大的概率下有相同的类标签;相反地,当两个样例被稀疏数据区域分开时,它们的类标签趋于不同。

2)聚类假设(Cluster Assumption):当两个样例位于同一聚类簇时,它们在很大的概率下有相同的类标签。这个假设的等价定义为低密度分离假设(Low Sensity Separation Assumption),即分类决策边界应该穿过稀疏数据区域,而避免将稠密数据区域的样例分到决策边界两侧。

聚类假设是指样本数据间的距离相互比较近时,则他们拥有相同的类别。根据该假设,分类边界就必须尽可能地通过数据较为稀疏的地方,以能够避免把密集的样本数据点分到分类边界的两侧。在这一假设的前提下,学习算法就可以利用大量未标记的样本数据来分析样本空间中样本数据分布情况,从而指导学习算法对分类边界进行调整,使其尽量通过样本数据布局比较稀疏的区域。例如,Joachims提出的转导支持向量机算法,在训练过程中,算法不断修改分类超平面并交换超平面两侧某些未标记的样本数据的标记,使得分类边界在所有训练数据上最大化间隔,从而能够获得一个通过数据相对稀疏的区域,又尽可能正确划分所有有标记的样本数据的分类超平面。

3)流形假设(Manifold Assumption):将高维数据嵌入到低维流形中,当两个样例位于低维流形中的一个小局部邻域内时,它们具有相似的类标签。

流形假设的主要思想是同一个局部邻域内的样本数据具有相似的性质,因此其标记也应该是相似。这一假设体现了决策函数的局部平滑性。和聚类假设的主要不同是,聚类假设主要关注的是整体特性,流形假设主要考虑的是模型的局部特性。在该假设下,未标记的样本数据就能够让数据空间变得更加密集,从而有利于更加标准地分析局部区域的特征,也使得决策函数能够比较完满地进行数据拟合。流形假设有时候也可以直接应用于半监督学习算法中。例如,Zhu 等人利用高斯随机场和谐波函数进行半监督学习,首先利用训练样本数据建立一个图,图中每个结点就是代表一个样本,然后根据流形假设定义的决策函数的求得最优值,获得未标记样本数据的最优标记;Zhou 等人利用样本数据间的相似性建立图,然后让样本数据的标记信息不断通过图中的边的邻近样本传播,直到图模型达到全局稳定状态为止。

从本质上说,这三类假设是一致的,只是相互关注的重点不同。其中流行假设更具有普遍性。

2. 流行学习

流形学习是个很广泛的概念。这里我主要谈的是自从2000年以后形成的流形学习概念和其主要代表方法。自从2000年以后,流形学习被认为属于非线性降维的一个分支。众所周知,引导这一领域迅速发展的是2000年Science杂志上的两篇文章: Isomap and LLE (Locally Linear Embedding)。

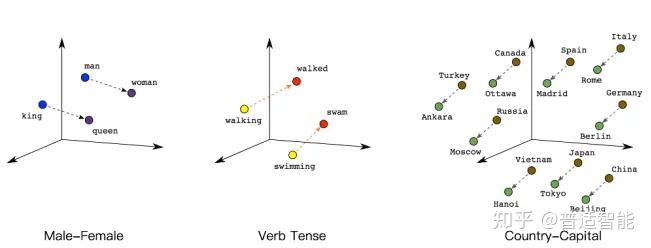

2.1. 流形学习的英文名为manifold learning。其主要思想是把一个高维的数据非线性映射到低维,该低维数据能够反映高维数据的本质,当然有一个前提假设就是高维观察数据存在流形结构,其优点是非参数,非线性,求解过程简单。

2.2. 流形学习的可行性是因为:1.从认知心理学的角度来讲心理学家认为人的认知过程是基于认知流形和拓扑连续性的;2.许多高维采用数据都是由少数几个隐变量所决定的,所以可以用少数的低维数据来刻画高维数据。

2.3. 流形学习所需的数学背景知识:微分流形,黎曼流形,微分几何,切向量场,拓扑空间,光滑映射等。

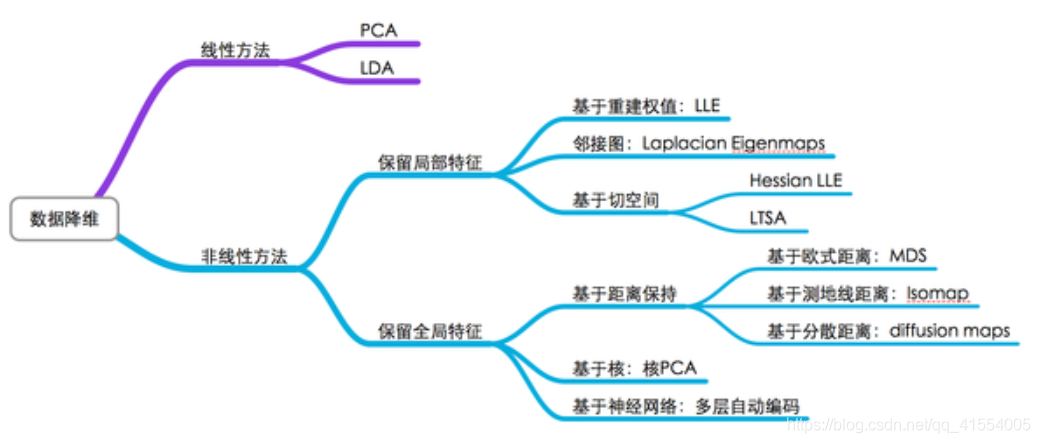

2.4. 经典流形学习算法:

Isomap:等距映射。前提假设为低维空间中的欧式距离等于高维空间中的侧地线距离,当然该算法具体实施时是高维空间中较近点之间的测地线距离用欧式距离代替,较远点距离用测地线距离用最短路径逼近。

LLE:局部线性嵌入。前提假设是数据所在的低维流形在局部是线性的,且每个采样点均可以利用其近邻样本进行线性重构表示。

LE:拉普拉斯特征映射。前提假设是在高维中很近的点投影到低维空间中的象也应该离得很近。

HLLE:局部等距映射。前提假设是如果一个流形局部等距与欧式空间中的一个开集,那么由这个流形到开集的映射函数为一个线性函数,线性函数的二次混合偏导数为0,所以由hessian系数构成的二次型也为0.

LPP:局部保留投影。在LE算法的基础上,假设一个从原空间到流形空间的映射矩阵P,然后通过某种方法求出P,最后得到了一个显示的投影映射。

LTSA:局部坐标表示。其基本思想是流形的局部几何先用切坐标表示,那么流形中的每一个点处的切空间可以和欧式空间中的一个开子集建立同构,也就是切映射。

MVU:局部等距。构造一个局部的稀疏欧式距离矩阵,同构保持距离来学习一个核矩阵。

Logmap:侧地距离和方向。思想是已知流形空间中一点的坐标和方向,通过切平面找到法坐标,形成一个指数映射。

……

2.5.流形学习存在的问题:

抗干扰噪声能力差,低维空间的维数不好确定,需要存在流形结构这一假设,采样需要稠密采样,测试数据的out-of-samples问题。

2.6.流形学习未来的发展方向:

提高鲁棒性,可视化手段提高,低维空间维数的确定,与统计学习结合等。

参考:

1.半监督学习的基本假设

2.流行学习初步理解

3.流形学习 (Manifold Learning)

4.浅谈流形学习