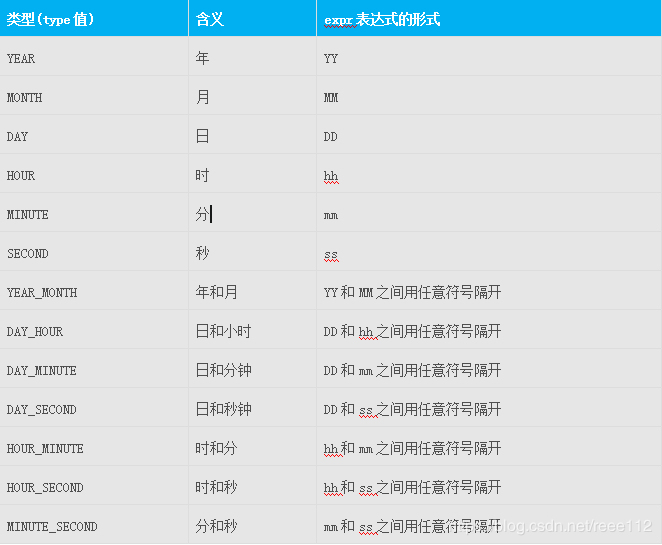

1. INTERVAL

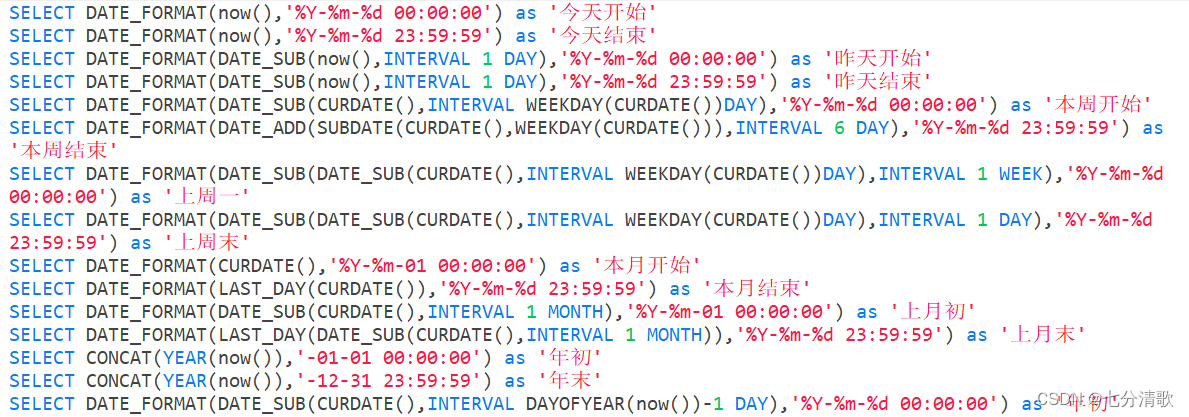

INTERVAL代表的是时间间隔

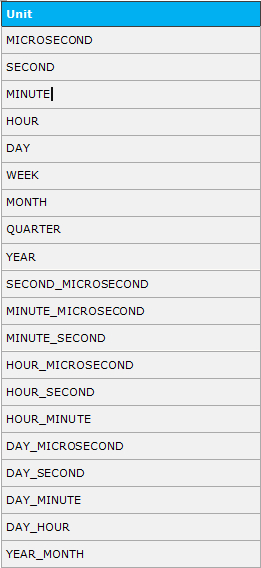

MySQL中的时间间隔类型有如下几种:

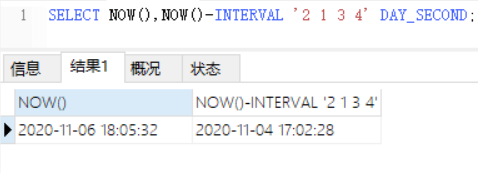

1.1 利用INTERVAL做时间的加减法

示例:

加法:SQL>SELECT DATE '2018-11-01' + INTERVAL '10 11' DAY_HOUR;

结果:2018-11-11 11:00:00

减法:SQL> select date '2018-11-11 11:00:00' -INTERVAL '10 11' DAY_HOUR ;

结果:2018-11-01 00:00:00

2. EXTRACT:用于返回日期/时间的单独部分,比如年、月、日、小时、分钟等等

格式:EXTRACT(unit FROM date)

unit取值表:

示例1:

SELECT

EXTRACT(YEAR FROM NOW()) AS years ,

EXTRACT(MONTH FROM NOW()) AS months,

EXTRACT(DAY FROM NOW()) AS