机器学习基础知识之概率论基础详解

文章目录

- 机器学习基础知识之概率论基础详解

- 引言

- 一、随机事件以及其运算

- 1、样本空间的概念

- 2、随机事件

- 3、随机变量

- 4、事件之间的关系

- 4.1包含关系

- 4.2相等关系

- 4.3互不相容

- 5、事件间的运算

- 5.1并

- 5.2交

- 5.3差

- 5.4对立事件

- 5.5运算性质

- 6、事件域

- 二、概率的定义以及其确定的方法

- 1、排列与组合公式

- 1.1乘法原理

- 1.2加法原理

- 1.3排列问题

- 1.4重复排列问题

- 1.5组合问题

- 1.6重复组合问题

- 2、确定概率的方法

- 3、确定概率的古典方法

- 4、确定概率的集几何方法

- 5、主观方法

- 三、概率的性质

- 1、概率的可加性

- 2、概率的单调性

- 3、概率的加法公式

- 4、概率的连续性

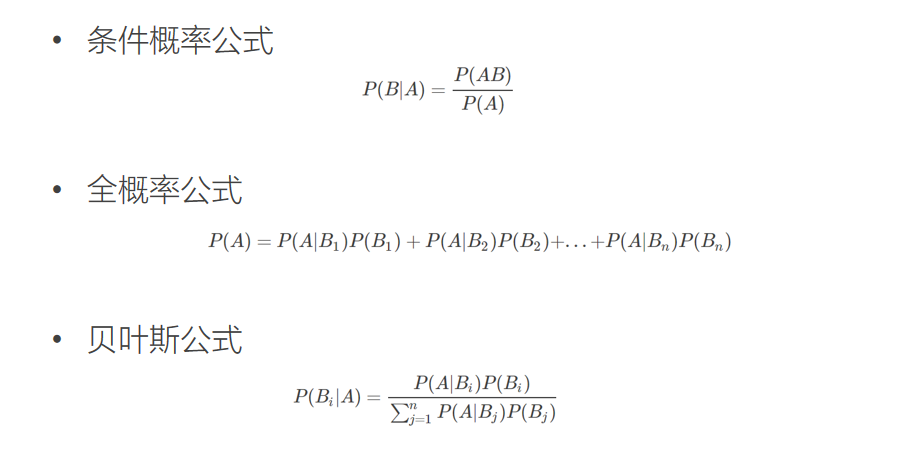

- 四、条件概率

- 1、定义

- 2、乘法公式

- 3、全概率公式

- 4、贝叶斯公式

- 五、独立性

- 1、两个事件的独立性

- 2、多个事件的独立性

- 3、实验的独立性

引言

本文旨在讲解、介绍概率论的基础知识,为后续的概率论的深入研究以及机器学习的研究打下一个基础,本文讲解比较基础,而且主要是一些基本的概念,主要介绍了概率论中的概率、频数、事件、概率的性质、独立性等问题进行了简单的阐述,希望对大家有一些帮助。

一、随机事件以及其运算

概率论以及数理统计研究的都是随机现象。概率论是研究概率的分布,数理统计是研究随机现象的数据的收集以及处理。

随机现象:在一定的条件之下,并不是总会出现相同的结果的现象成为随机现象,例如:抛硬币。

随机现象的特点:

1、结果不止一个;

2、人们并不知道会出现哪一个结果。

只有一个结果的现象成为确定性现象。

对在相同条件下可以重复的随机现象的观察、记录、实验称为随机实验。

1、样本空间的概念

随机现象的一切可能的基本结果组成的集合称为样本空间,即为:Ω={ω},其中,ω表示基本的结果,又称为样本点。样本点是抽样的最基本的单位。认识随机现象首先需要列出样本空间。

需要注意的是:

1、样本空间中的元素可以是数字,也可以不是数字;

2、样本空间中至少需要有两个样本点;

3、从样本空间含有的样本的数目可以将样本空间分为:有限、无限两类。(通常把有限个或者可列无限个样本的空间称为离散样本空间;把有不可列无限个样本的空间称为连续样本空间。)

2、随机事件

随机现象的某些样本点组成的集合称为随机事件,简称事件。用大写字母A,B,C…表示。

注意事项:

1、可以使用韦恩图来表示一个事件和样本空间的关系;

2、事件A发生了当且仅当A中某一个样本点出现了;

3、事件可以使用集合或者韦恩图表示,也可以使用明白无误的语言进行表达;

4、由样本空间中的单个元素组成的子集称为基本事件,而样本空间的最大的子集是必然事件,样本空间的最小的子集是称为不可能事件。

韦恩图实例:

这是一个非常简答的韦恩图的实例。

3、随机变量

用来表示随机现象结果的变量称为随机变量,用大写字母X,Y,Z…表示。很多事件都可以用随机变量来表示,表示时候应该写明白随机变量的含义,而随机变量的含义是按照人们的需要表示出来的。

随机变量是人们根据实际问题的需要设置出来的,如果使用等号或者不等号与某些实数连接起来就可以表示很多事件。随机变量的设置是需要事先进行设置的哦。

4、事件之间的关系

4.1包含关系

如果属于A的样本点也属于B,那么,我们就称为A属于B,或者B包含A,即就是,A发生必然会

导致B发生。

4.2相等关系

A属于B,B也属于A,那么,我们就称,A等于B,A=B。

4.3互不相容

如果A以及B没有相同的样本点,那么,我们就称A与B是互不相容的。即就是说,A以及B不可能同时发生。

5、事件间的运算

5.1并

A∪B,表示的是:由事件A以及事件B中所有的样本点组成的新的事件。

5.2交

A∩B,表示的是:由事件A以及事件B之中的公共的样本点组成的新事件。即就是说,A与B同时发生。

5.3差

A-B称为事件A对事件B的差,表示的就是,事件A发生但是事件B不发生。

5.4对立事件

1、对立事件一定是不互不相容的事件;

2、对立事件的并是样本空间;

3、互不相容事件不一定是对立事件。

5.5运算性质

1、交换律

A∪B=B∪A

A∩B=B∩A

2、结合律

(A∪B)∪C=A∪(B∪C)

(A∩B)∩C=A∩(B∩C)

3、分配率

(A∪B)∩C=(A∩C)∪(B∩C)

(A∩B)∪C=(A∪C)∩(B∪C)

4、对偶律

事件取反的交=事件的并取反

事件取反的并=事件交的取反

6、事件域

事件域从直观上来讲就是一个样本空间中某些子集以及其运算结果而组成的集合类。

一般而言事件域都是有可以测量的概率的。

二、概率的定义以及其确定的方法

概率简单来说就是随机事件发生的可能性的大小。

概率的公理化定义:

1、非负性

2、正则性

3、可列可加性

1、排列与组合公式

1.1乘法原理

乘法原理想必大家一定都很熟悉了,这里就不需要过多叙述了,只是说一嘴,使用乘法原理的问题是不考虑次序的哦。

1.2加法原理

加法原理大家肯定也是十分熟悉的,就不必过多赘述了。

1.3排列问题

排列问题需要考虑次序的问题。

(取出不放回)

1.4重复排列问题

这里与上一个问题的区别就在于是,这里是取出要放回。

1.5组合问题

组合问题不需要考虑顺序的问题。

(取出不放回)

1.6重复组合问题

这里与上一个问题的区别还是在于,这里是需要在取出来以后进行放回到的。

2、确定概率的方法

确定概率的方法是在大量的重复性实验之中,用频率的稳定值去(某一个事件的次数除以总次数是频率)来获得概率的。

基本思想:

1、该随机现象可以进行大量的重复性实验;

2、一个事件出现的总次数/实验的总次数=频率;

3、频率的稳定值可以作为概率。(频率的稳定性)

缺点:人们无法将一个实验进行无数次,因此想要得到精确的结果是比较苦难的。

3、确定概率的古典方法

概率=事件A所有的样本点的个数/样本空间中所有的样本点的个数

这个计算其实我们在中学阶段就已经计算过很多的案例了,

也是很好理解的额。

4、确定概率的集几何方法

这里跟上面的那个古典方法是类似的,只不过是将个数相除变换为了面积相除而已啦。

5、主观方法

贝叶斯学派的人认为:一个事件的概率是人们根据经验对该事件发生的可能性所给出的个人的信念。这样的概率叫做主观概率。

1、主观概率与主观臆测不同;

2、用主观方法得到的随机事件的可能性的大小,本质上是对于随机事件的概率的一种推断与估计;

3、在遇到随机现象无法大量重复的时候,用主观的方法去进行决策以及判断是适合的。(主观给定的概率也是需要符合公理化的定义的额。)

三、概率的性质

利用概率的公理化的定义,可以导出概率的一系列的性质。

1、概率的可加性

事件的并的概率等于每一个事件的概率的加和。

2、概率的单调性

如果A属于B,那么,A的概率小于等于B的概率(单调性)。

3、概率的加法公式

事件的并的概率=每一个事件的概率的和。

4、概率的连续性

这个定理用到的不多,了解一下即就可以了。

四、条件概率

条件概率是概率论中的一个既重要又实用的一个概念。

1、定义

所谓的条件概率就是:

在某一个事件B发生的条件之下求解另一个事件A发生的概率。

2、乘法公式

P(AB)=P(B)P(A|B)。

3、全概率公式

全概率公式是概率论中的一个重要的公式,它提供了计算复杂的事件的概率的一种有效的途径,使得一个复杂的事件的概率计算问题的过程化繁为简。

4、贝叶斯公式

在乘法公式以及全概率公式的基础之上的一个很著名的公式就是贝叶斯公式。

五、独立性

独立性也是一个在概率论中的重要的概念,利用独立性可以简化概率的计算。

1、两个事件的独立性

两个事件的独立性是指:一个事件的发生不会影响到另一个事件。称为两个事件是相互独立的。否则两个事件是不独立或者相依的。

2、多个事件的独立性

在两个事件独立性的基础之上我们可以说,在多个事件之中,如果这多个事件之中,两两独立,那么,我们就是说这些多个事件也是相互独立的额。称为多个事件的相互独立。

3、实验的独立性

利用事件的独立性可以定义实验的独立性。

定义:

如果实验E1以及实验E2,假如,实验E1的任何一个结果与实验E2的任何一个结果都是相互独立的,那么,我们就称这两个实验是相互独立的,叫做独立性的实验。

END.

以上就是概率论基础知识的一些介绍,方便后面对于概率论以及机器学习的深入学习了啦。

最后,感谢大家的阅读了,如果喜欢的话就点个赞吧。