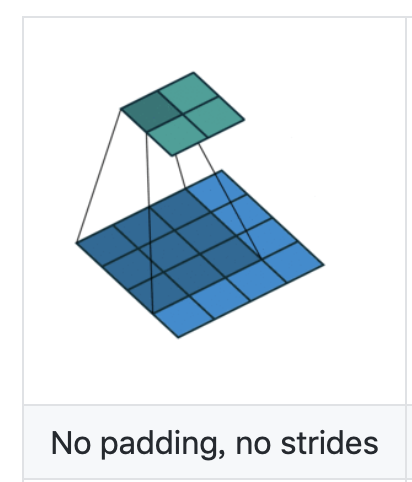

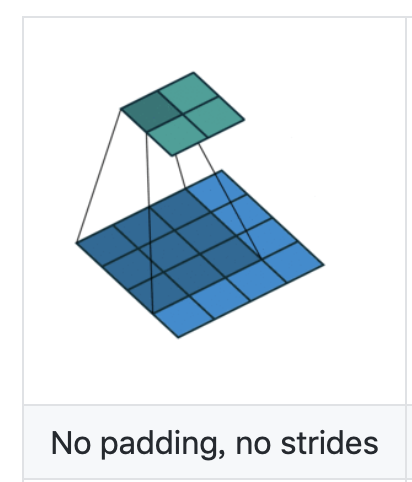

如果我们设置的dilation=0的话,效果如图:

蓝色为输入,绿色为输出,可见卷积核为3*3的卷积核

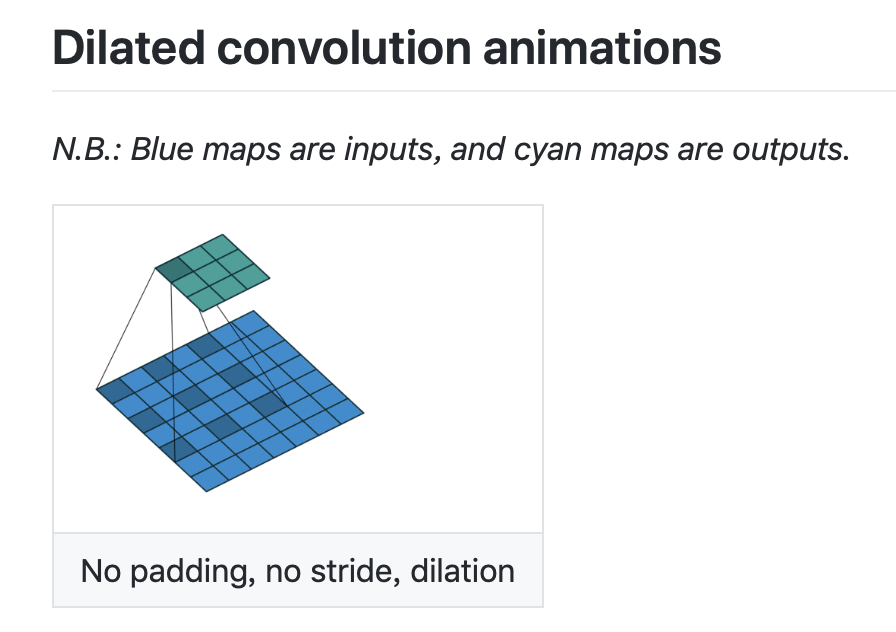

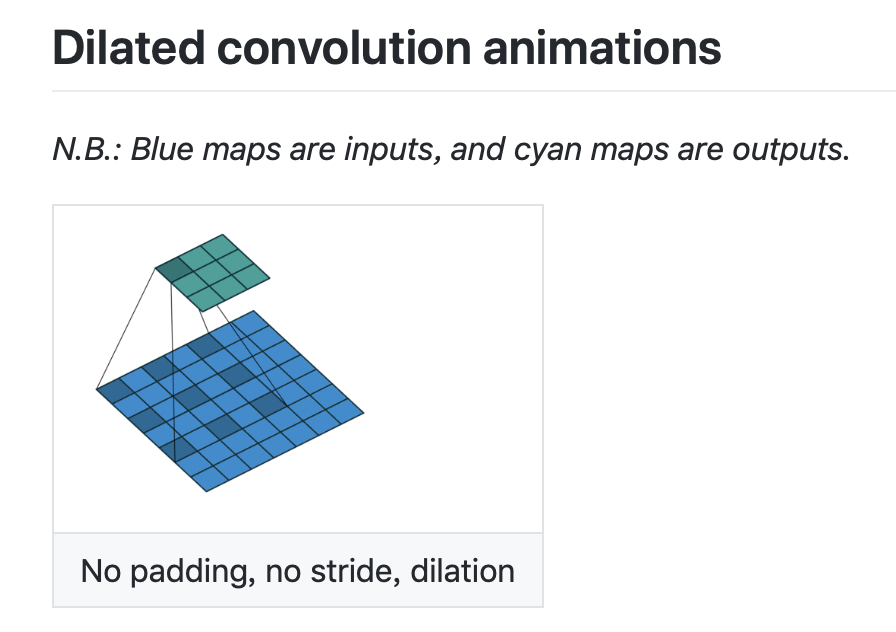

如果我们设置的是dilation=1,那么效果如图:

蓝色为输入,绿色为输出,卷积核仍为3*3,但是这里卷积核点与输入之间距离为1的值相乘来得到输出

好处:

这样单次计算时覆盖的面积(即感受域)由dilation=0时的3*3=9变为了dilation=1时的5*5=25

在增加了感受域的同时却没有增加计算量,保留了更多的细节信息,对图像还原的精度有明显的提升

如果我们设置的dilation=0的话,效果如图:

蓝色为输入,绿色为输出,可见卷积核为3*3的卷积核

如果我们设置的是dilation=1,那么效果如图:

蓝色为输入,绿色为输出,卷积核仍为3*3,但是这里卷积核点与输入之间距离为1的值相乘来得到输出

好处:

这样单次计算时覆盖的面积(即感受域)由dilation=0时的3*3=9变为了dilation=1时的5*5=25

在增加了感受域的同时却没有增加计算量,保留了更多的细节信息,对图像还原的精度有明显的提升