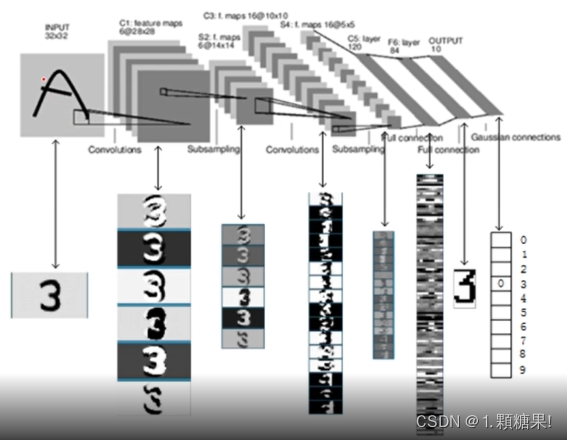

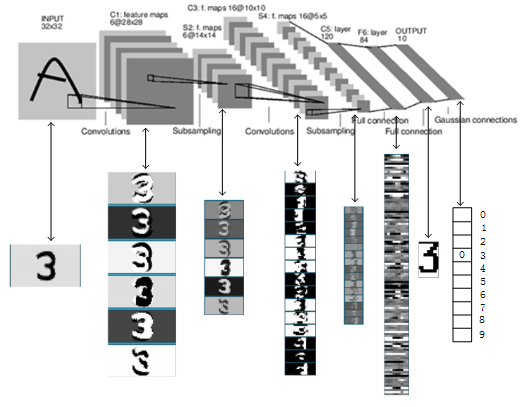

LeNet5可以说是最早的卷积神经网络了,它发表于1998年,论文原文Gradient-Based Learning Applied to Doucment Recognition作者是Yann Le Cun等。下面对LeNet5网络架构进行简单的说明,有兴趣的同学可以去参考原文,论文原文地址http://yann.lecun.com/exdb/publis/pdf/lecun-01a.pdf。

一、LeNet5网络架构图

LeNet5不包括输入层一共有七层,每一层都包含了可以训练的参数,输入是一张大小为32*32的图片。

1、C1卷积层

这一层的输入就是原始的图像,输入层接受图片的输入大小为32*32*1。卷积层的核(过滤器)尺寸为5*5,深度为6,不使用0进行填充,步长为1。通过计算公式可以求出输出的尺寸为28*28*6,卷积层的深度决定了输出尺寸的深度。卷积层总共的参数有5*5*1*6+6 =156个参数,加的6为卷积后的偏置项参数。本层所拥有的节点有28*28*6=

4704个节点, 而本层的每一个节点都是经过一个5*5的卷积和一个偏置项计算所得到的,5*5+1=26,所以本层卷积层一共有4704*26 = 122304个连接。

2、S2池化层

本层的输入是C1层的输出,它接受一个28*28*6的节点矩阵。在卷积神经网络中,常用的池化层有最大池化和平均池化,所使用的核大小为2*2,长和宽的步长都是2,意味着输入矩阵的每四个相邻的元素经过S2之后只会有一个输出元素,所以本层的输出矩阵大小为14*14*6,池化层不会改变输入矩阵的深度。而在LeNet5网络中,池化层是首先对C1层输出中的2*2相邻的区域内,先求和然后再加上一个偏置项,最后将结果做一次映射通过sigmoid函数,所以就将输出的行和列变成了输入的一半,一共有6*2 = 12个参数。与C1层一共有,(4+1)*6*14*14=5880个连接。

3、C3卷积层

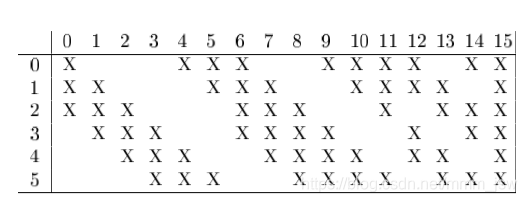

这一层的输入是一个14*14*6的矩阵,C3层一共有16卷积核,每一个卷积核的大小为5*5,输出是10*10*16,下面的表格展示了S2层与C3层的连接关系。

从上表中可以发现,行号表示C3层中的16个卷积核,列号表示的是S2层中的6个卷积核的输出。C3层中的前6(0-5)个卷积与S2层中的3个卷积核输出相连,C3层中的中间的3个(6-8)与S2层中连续的4个卷积核的输出相连,后面6个(9-14)与S2层中不连续的4个卷积核的输出相连,C3层中的最后一个卷积与S2层中所有输出相连。为什么S2不和C3的每一个卷积核相连呢?主要有两个原因,第一,不使用全连接能够保证有连接的数量保持在一个合理的界限范围内可以减少参数,最重要的是,通过这种方式可以打破网络的对称性,不同的卷积核通过输入可以得到不同的特征。从表中的C3层与S2层的连接关系可以求出C3的参数一共有:6*(5*5*3+1)+9*(5*5*4+1)+1*(5*5*6+1)=1516个参数,与S2层的连接一共有,10*10*1516=151600个连接。

4、S4池化层

S4层的池化方式与S2层相同,输入是10*10*16,输出是5*5*16。所以,S4层一共有16*2=32个参数,与S3层一共有(4+1)*5*5*16=2000个连接。

5、C5卷积层

C5层由120个卷积核组成,一个卷积与S4中每一个feature map(5*5*16)相连,所以每一个C5的卷积核都会输出一个1*1,所以在S4与C5之间是属于全连接。C5是一个卷积层而不是一个全连接层,如果这个LeNet5的输入变的更大了而其它的保持不变,那么这个输出将要大于1*1。C5层与S4一共有120*(5*5*16+1)=48120个连接。在论文的第七章有介绍到动态增加卷积网络大小的过程。

6、F6全连接层

F6层包含了84个节点,一共包含了84*(120+1)=10164个参数。F6层通过将输入向量与权重向量求点积,然后在加上偏置项。这个加权和表示为a(i),对于第i个单元,然后通过一个sigmoid压缩函数,来产生一个x(i),x(i)=f(a(i))。这个压缩函数是双曲正切函数(tanh),f(a)=Atanh(Sa)。A是函数的振幅决定了函数最大最小值,决定了曲线在原点的斜率,这个tanh函数是奇函数(关于原点对称),下图是tanh的函数图像,y的范围在[-1,1],所以f(a)的函数取值范围就在[-A,A]。

7、输出层

输出层是由欧式径向基函数(RBF)组成。每一个输出对应一个RBF函数,每一个RBF函数都有84维的输入向量,RBF的函数公式如下。每一个RBF函数都会有一个输出,最后输出层会输出一个10维的向量。

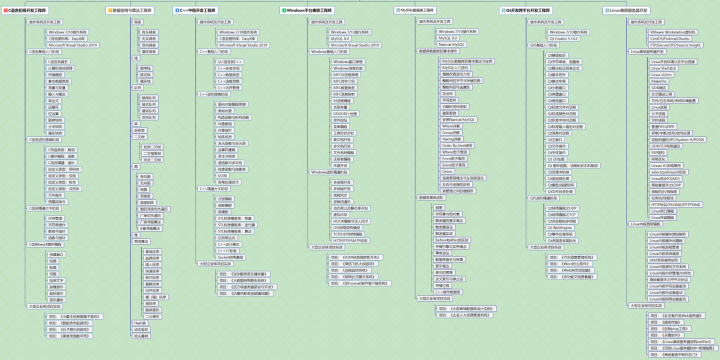

二、总结

通过LeNet5的模型,而在实际应用中,我们所设置的卷积网络模型,所处理的图片大小一定都会超过32*32,如果遇到这种情况我们应该怎么处理呢?通常的做法有两种,第一种将所处理的图片大小转换成32*32,这种做法效果可能不是很好,将图片转成32*32的图片之后,肯定会丢失很多的信息。第二种,就是设计一个新的卷积神经网络,来使其适用不同图片的输入,通过LeNet5的网络,我们可以发现一个问题,输入层--->卷积---->池化--->(重复卷积和池化步骤)--->全连接--->输出层。通过这个结构,我们可以用一个正则表达式来表示一个卷积神经网络的架构,输入层->(卷积层+--->池化层?)+--->全连接层+,正则表达式中的,“卷积层+”表示一层或者多层卷积层,大部分的卷积神经网络中一般最多连续使用三层卷积层。“池化层?”表示没有或者一层池化层。池化层可以减少参数和防止过拟合问题,其实我们也可以通过直接调整卷积层的步长来完成。所以,可能在有些卷积神经网络中没有池化层。在经过多轮的卷积层和池化层之后,卷积神经网络在输出之前一般会经过1~2个全连接层。