论文地址:《Language Models are Unsupervised Multitask Learners》

代码地址:https://github.com/openai/gpt-2

文章目录

- 论文介绍

- 模型框架

- 实验分析

- 结论

论文介绍

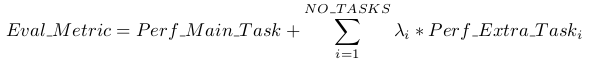

本文将常识推理和情感分析两项任务联系起来,采取更一般的方法。证明了语言模型可以在zero-shot下无需任何参数或架构的修改执行下游任务。

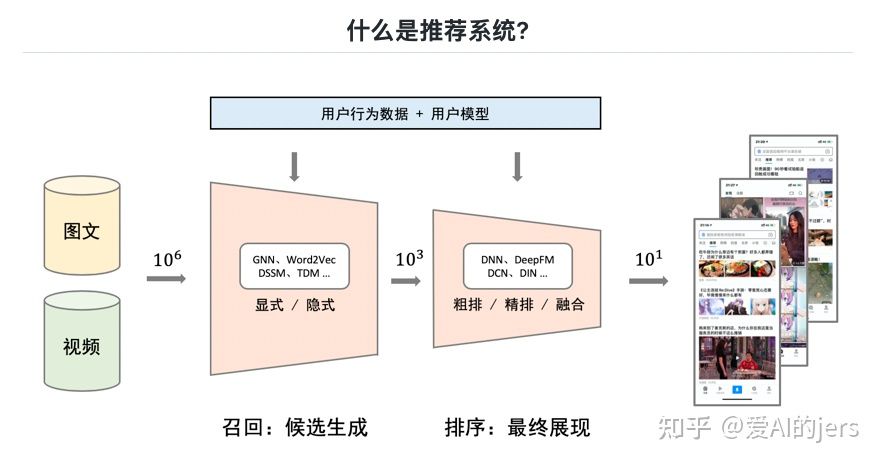

模型框架

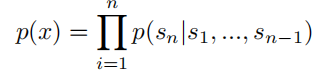

核心依旧是Language Modeling,形式化为

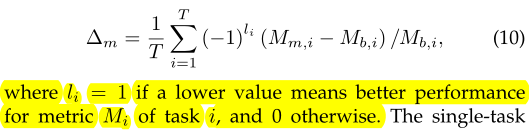

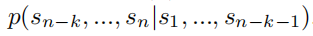

,从中可以学习到

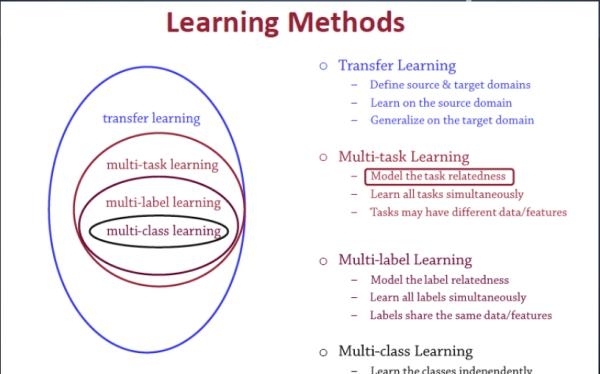

。单任务预测形式化为p(output|input),多任务则为p(output|input,task),通过将tasks,inputs和outputs都表示为符号序列,便可和上面的语言模型关联起来。

。单任务预测形式化为p(output|input),多任务则为p(output|input,task),通过将tasks,inputs和outputs都表示为符号序列,便可和上面的语言模型关联起来。

Training Dataset是从网页抓取得到的相对高质量内容,数据集命名为WebText,是4500万链接的一个子集,包含超过800万个文档,共40GB的文本数据,其中Wikipedia的文档被过滤以避免与测试评估任务的数据重叠。

Input Representation采用BPE(Byte Pair Encoding)方法,且在字节级别上进行合并但是限制合并不同类型的字符以避免类似dog. dog! dog?的出现。这种表示方式能够结合词级别语言模型的优点和字节级别的泛化性能,更加灵活。

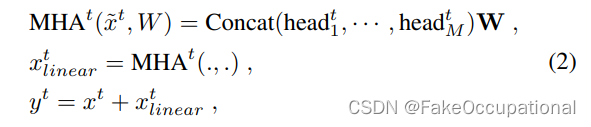

模型框架基本同GPT,有一点小改动,例如Layer normalization前移到每个子模块之前(顶层多加一层Layer normalization),初始化策略,扩大词表等。

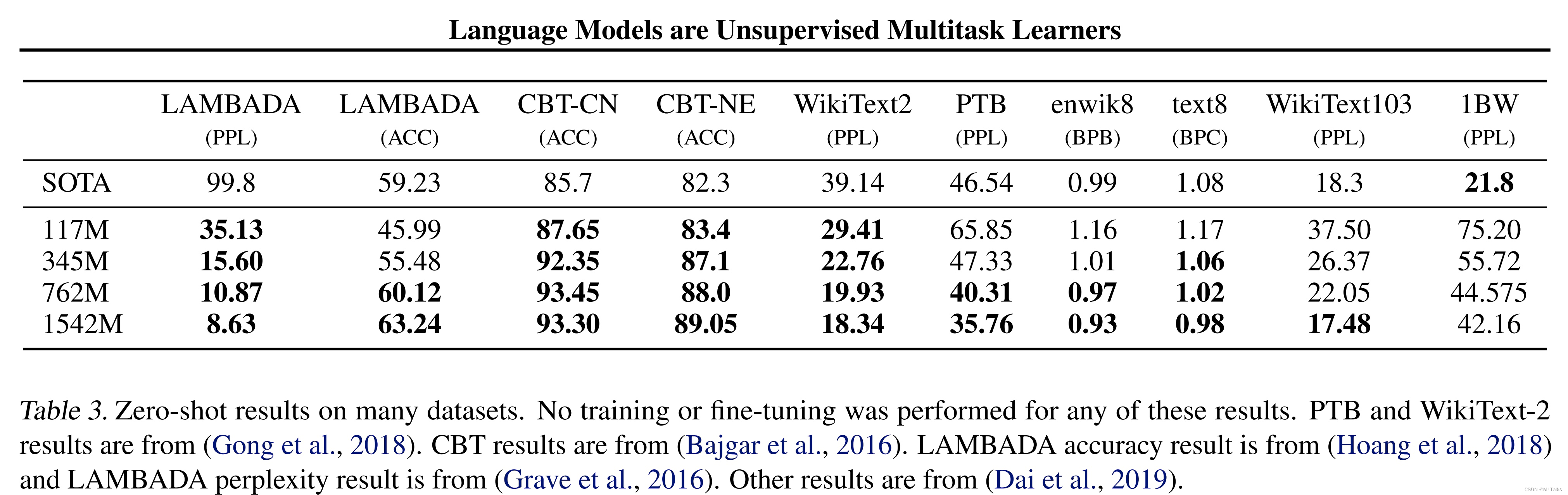

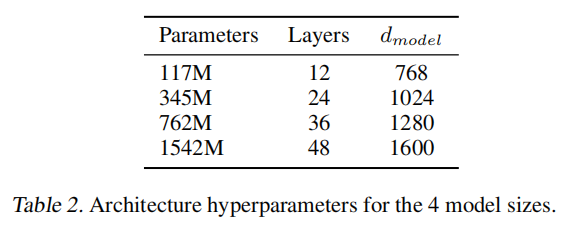

最小模型117M是原始GPT模型,345M是最大的BERT模型,最大的1542M模型为GPT-2模型。

实验分析

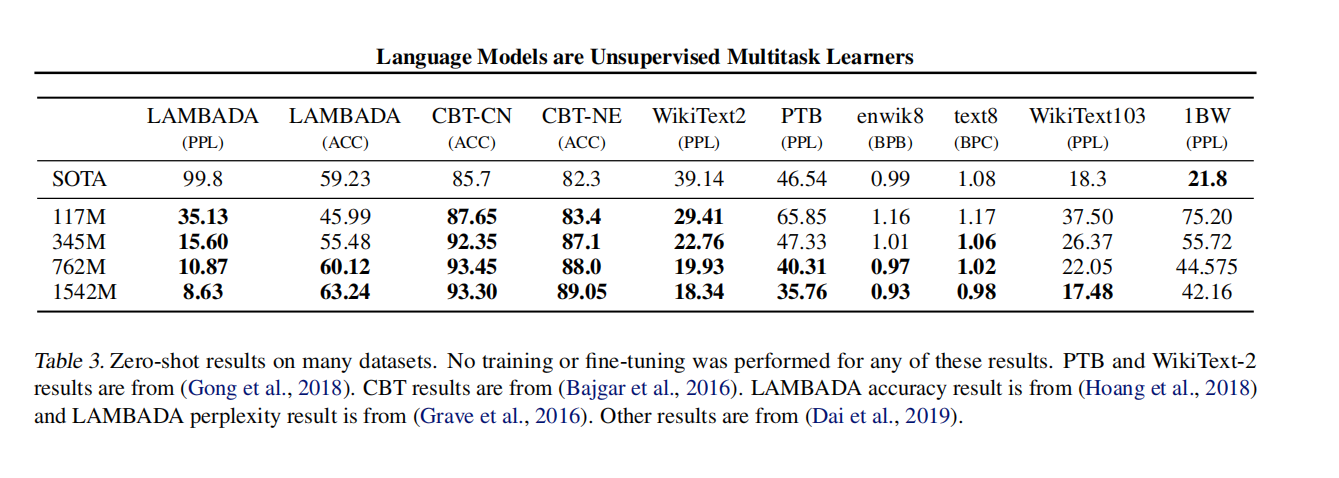

可以看到,在Zero-shot的情况下,WebText LMs几乎在所有测试数据集上达到了新的SOTA,除了1BW数据集,语言建模能力惊人。

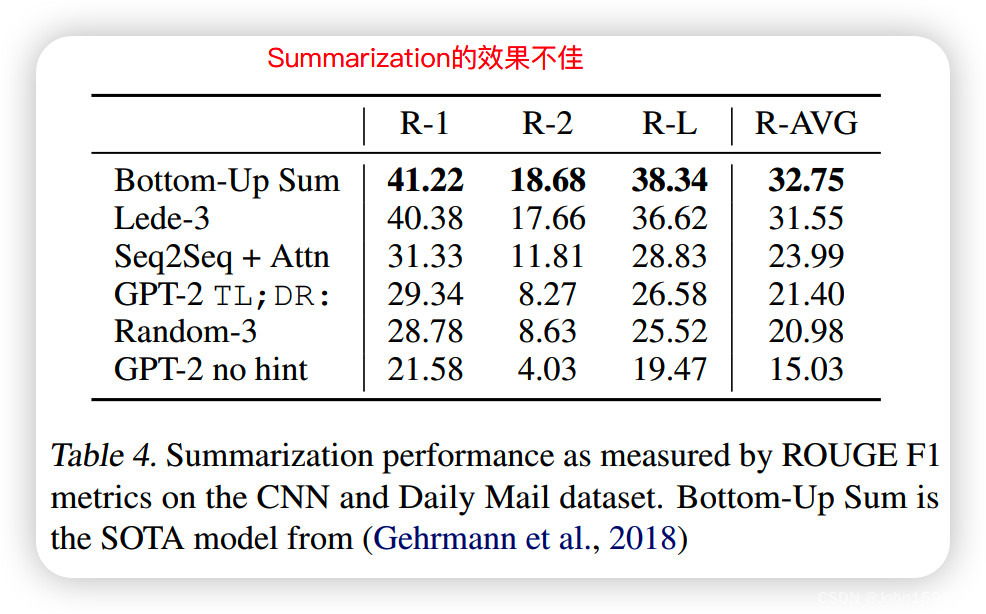

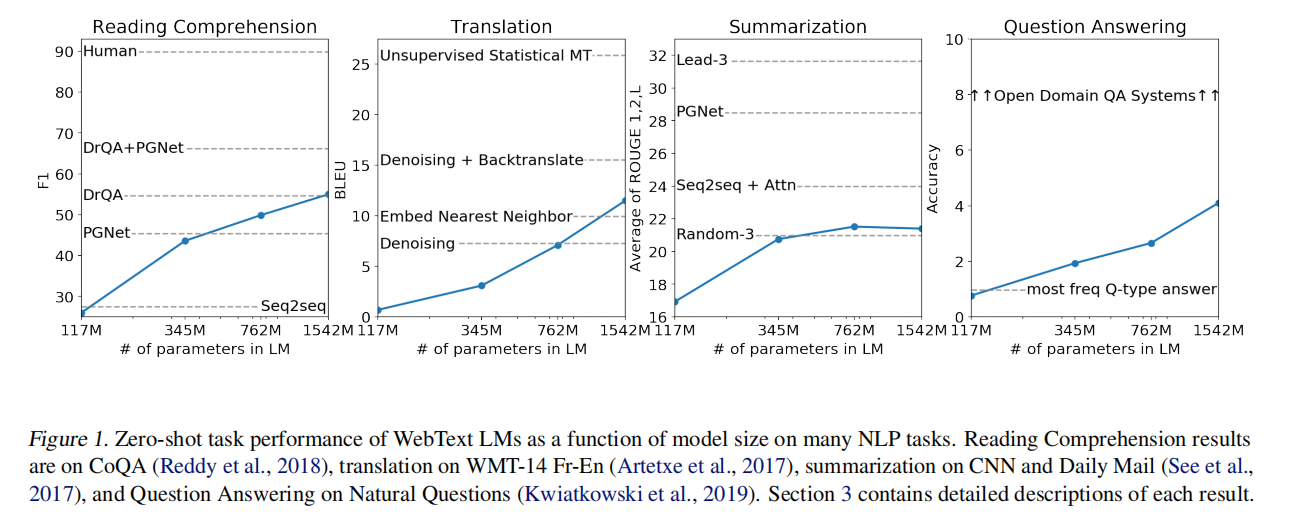

另外还在很多其他任务上进行了对比实验,大多数也取得了提升,如下图:

结论

论文的主要贡献在于表明了“在一个足够大的、多样化的数据集上,训练一个超大的语言模型(high-capacity),能够很好泛化到其他任务上”。