本关任务:安装与配置Spark开发环境。

相关知识

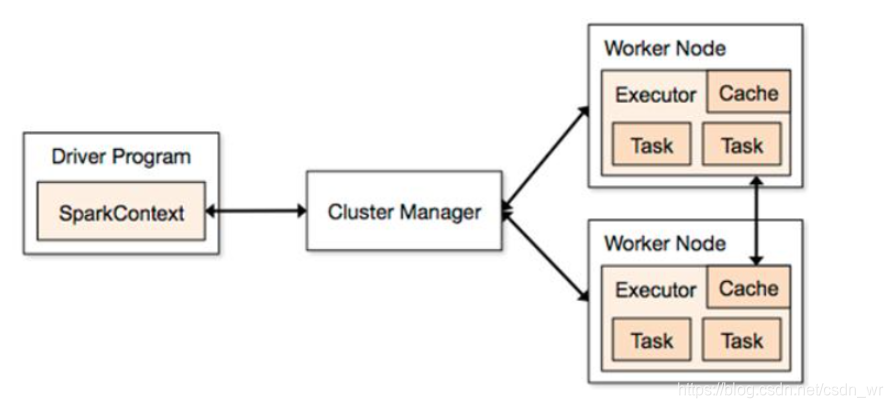

Apache Spark是专为大规模数据处理而设计的快速通用的计算引擎。Spark是UC Berkeley AMP lab(加州大学伯克利分校的AMP实验室)所开源的类Hadoop MapReduce的通用并行框架,Spark拥有Hadoop MapReduce所具有的优点;但不同于MapReduce的是——Job中间输出结果可以保存在内存中,从而不再需要读写HDFS,因此Spark能更好地适用于数据挖掘与机器学习等需要迭代的MapReduce的算法。

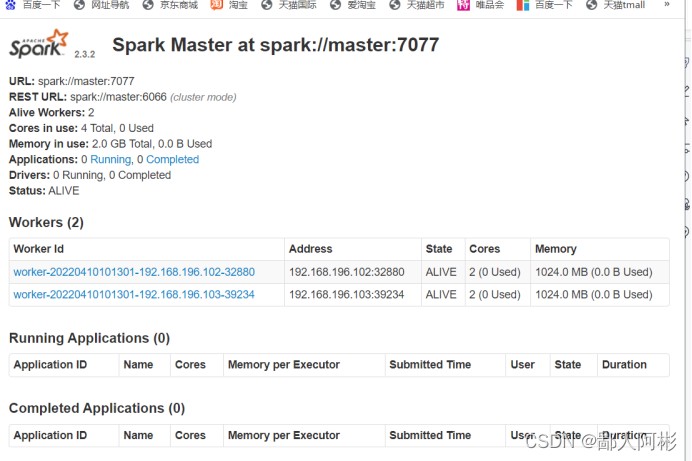

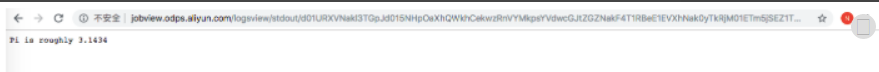

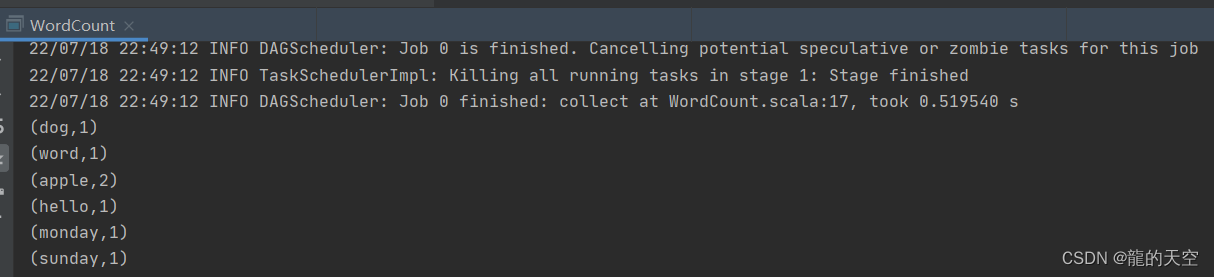

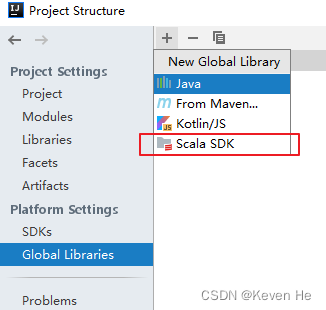

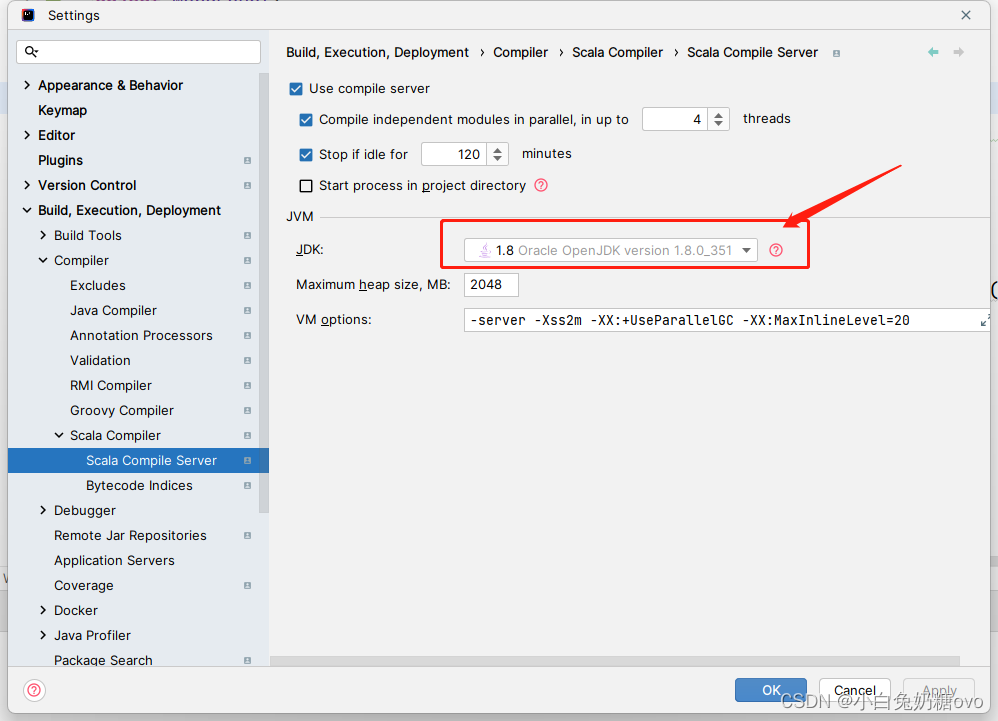

本关我们来配置一个伪分布式的Spark开发环境,与配置Hadoop类似分为三个步骤:

- 下载解压安装包;

- 配置环境变量;

- 配置

Spark环境; - 校验。

下载解压安装包

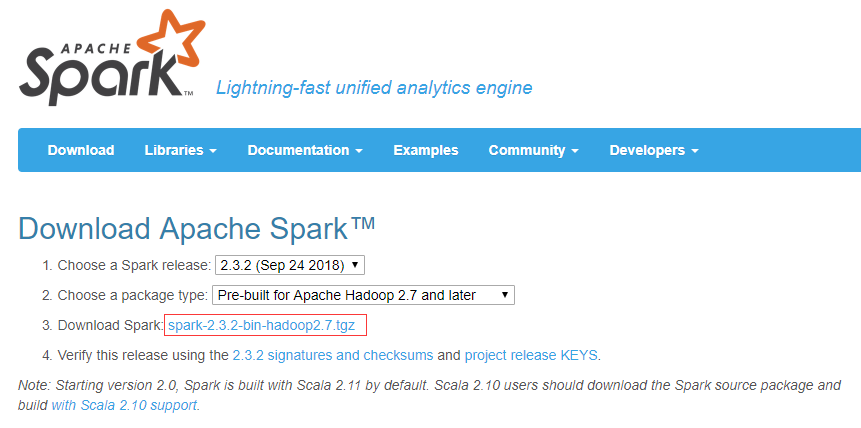

我们从官网下载好安装包,

接下来解压,在平台已经将spark安装包下载到/opt目录下了,所以不需要再下载了