一、安装JDK

本文写于2022年4月,此时最新版的JDK已经更新到了JDK17——下载地址。为了满足开发人员的需要,Oracle仍然提供了JDK8和JDK11可供下载,下载链接也在上面的网站上,只需要把页面下滑即可。

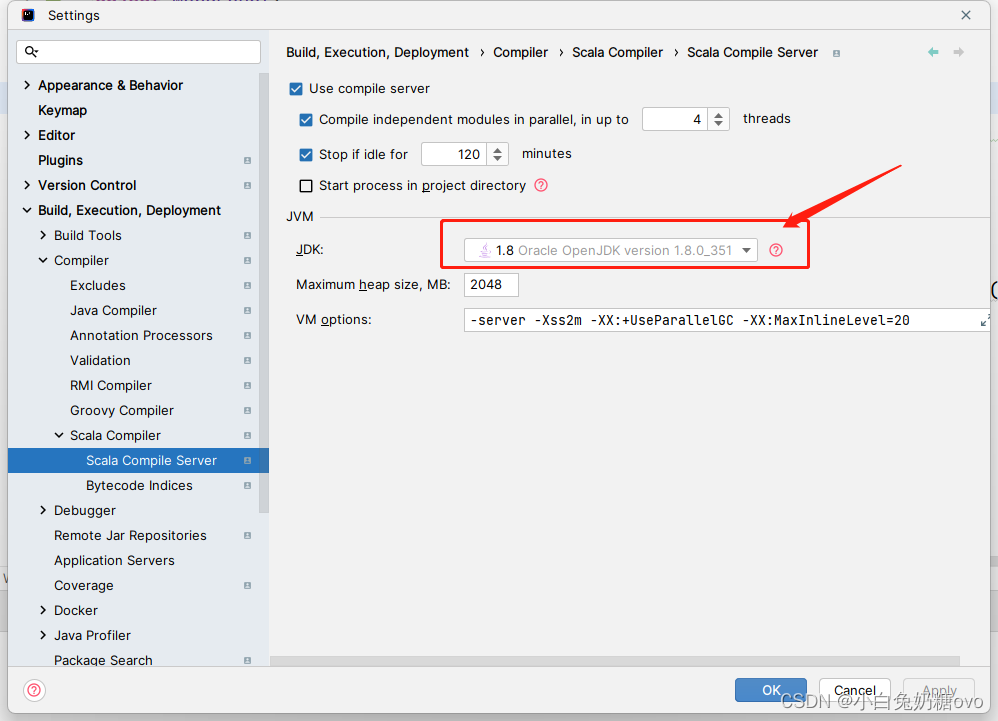

注:由于需要配置Spark,但Spark与较新的JDK兼容性不好,如果使用最新的JDK,后序运行Spark过程中会出现错误。因此,建议初学者安装JDK8即可。

下载完成后即可安装。但需要注意的是,需要为JDK设置三个环境变量PATH、JAVA_HOME、CLASSPATH,网上已经有很多设置环境变量的教程,这里就不再赘述。

环境变量:

创建JAVA_HOME:C:\Program Files\Java\jdk1.8.0_181

创建CLASSPATH:.;%JAVA_HOME%\lib;%JAVA_HOME%\lib\tools.jar(前面有个点号)

Path添加:%JAVA_HOME%\bin;

测试是否安装成功:打开cmd命令行,输入java -version

二、安装intelj IDEA并配置scala插件

https://www.jetbrains.com/idea/

IDEA安装完成后,安装scala插件:启动intelj -> 点击启动页configuration -> Plugins,或者file->setting->Plugins,搜索scala并安装插件。如果搜不到,可能是需要代理:Install JetBrains plugin... -> HTTP Proxy Settings设置代理。

安装完成后要重启IDEA。

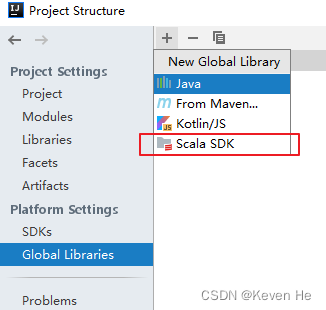

三、安装scala SDK

其版本应与上面spark/jars/中scala版本一致,3.2版本spark对应的scala版本位2.13+ ,我们安装最新版。

https://www.scala-lang.org/download/all.htmlScala 3.1.2 | The Scala Programming Language![]() https://www.scala-lang.org/download/3.1.2.htmlhttps://www.scala-lang.org/download/all.html

https://www.scala-lang.org/download/3.1.2.htmlhttps://www.scala-lang.org/download/all.html

上面链接中提到了多种scala的安装方式,比较省事的是通过已经安装好scala插件的intelj IDEA安装scala SDK(注意区分插件和SDK):File => New => Project,选择scala,输入工程名,如果是第一次新建scala工程,会有一个scala SDK的Create按钮,然后选择需要的版本安装。

而我使用的是安装包安装方式:

环境变量:

创建SCALA_HOME:

Path添加:;%SCALA_HOME%\bin;

测试是否安装成功:打开cmd命令行,输入scala

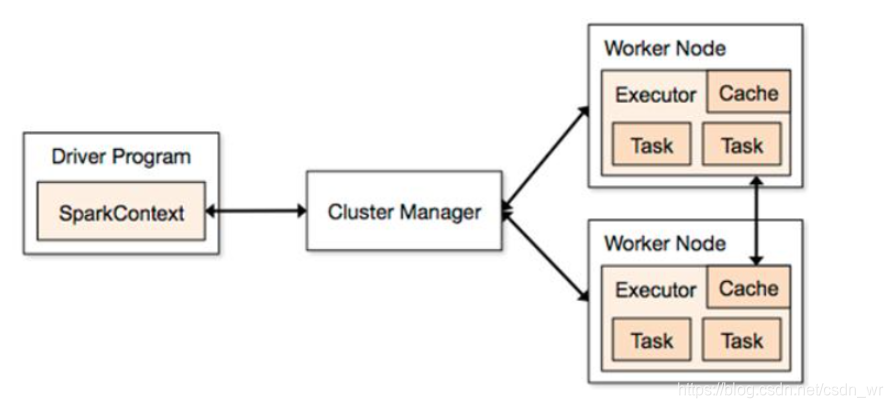

四、安装Scala、Hadoop、Spark

scala和Hadoop下载需要注意一下和Spark的对应版本,通过Spark下载网站,如下图,可以得知对应关系。

Pre-built for Apache Hadoop 3.3 and later是指选择的安装包是已经为Hadoop3.3和3.3之后的版本预编译好的,即Hadoop需要下载3.3之后的版本。最下面写明了Spark3是用Scala 2.12预编译好的,因此我需要下载Scala 2.13 版本。

下载好之后同样需要设置环境变量。

Scala 3.1.2 | The Scala Programming Language

安装Hadoop

说明:如果你只是玩Spark On Standalone的话,就不需要安装hadoop,如果你想玩Spark On Yarn或者是需要去hdfs取数据的话,就应该先装hadoop。关于spark和hadoop的关系,强烈推荐这篇博客:Spark是否会替代Hadoop?

安装上面spark对应版本的hadoop3.2:

hadoop-3.3.2 下载地址 解压到指定目录即可。

使用CMD命令解压Hadoop 到安装目录:start winrar x -y hadoop-3.1.2.tar.gz

直接解压会报错。

环境变量:

创建 HADOOP_HOME :D:\soft\hadoop-3.1.2

Path添加:%HADOOP_HOME%\bin

测试是否安装成功:打开cmd命令行,输入hadoop

Downloads | Apache Spark

下载位置在最下面

Index of /dist/spark

环境变量:

创建SPARK_HOME:D:\soft\spark-3.2.1-bin-hadoop3.2

Path添加:%SPARK_HOME%\bin

测试是否安装成功:打开cmd命令行,输入spark-shell

maven 构建工具安装(如果不用maven构建工具,不用装)

http://maven.apache.org/download.cgi

也是下载后解压即可。

环境变量:

MAVEN_HOME = D:\soft\apache-maven-3.6.3

MAVEN_OPTS = -Xms128m -Xmx512m

path添加:%MAVEN_HOME%\bin

测试是否安装成功:打开cmd,输入mvn help:system