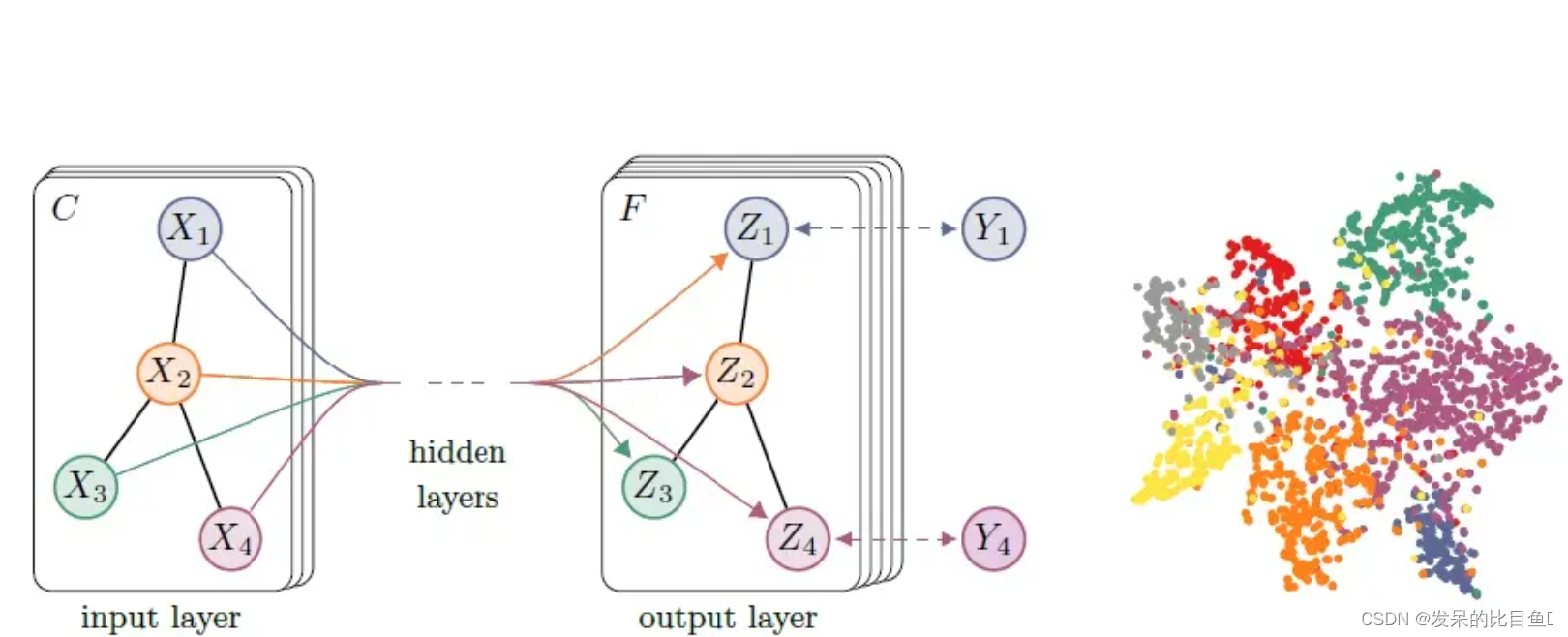

基于图神经网络的节点表征学习

图节点预测或边预测任务过程:使用图神经网络来生成节点表征,并通过基于监督学习的对图神经网络的训练,使得图神经网络学会产生高质量的节点表征。

高质量的节点表征能够用于衡量节点的相似性,同时高质量的节点表征也是准确分类节点的前提。

Cora数据集

Cora是一个论文引用网络,节点代表论文,如果两篇论文存在引用关系,则对应的两个节点之间存在边,各节点的属性都是一个1433维的词包特征向量。

获取并分析数据集

from torch_geometric.datasets import Planetoid

from torch_geometric.transforms import NormalizeFeaturesdataset = Planetoid(root='dataset', name='Cora', transform=NormalizeFeatures())print()

print(f'Dataset: {dataset}:')

print('======================')

print(f'Number of graphs: {len(dataset)}')

print(f'Number of features: {dataset.num_features}')

print(f'Number of classes: {dataset.num_classes}')data = dataset[0] # Get the first graph object.print()

print(data)

print('======================')# Gather some statistics about the graph.

print(f'Number of nodes: {data.num_nodes}')

print(f'Number of edges: {data.num_edges}')

print(f'Average node degree: {data.num_edges / data.num_nodes:.2f}')

print(f'Number of training nodes: {data.train_mask.sum()}')

print(f'Training node label rate: {int(data.train_mask.sum()) / data.num_nodes:.2f}')

print(f'Contains isolated nodes: {data.contains_isolated_nodes()}')

print(f'Contains self-loops: {data.contains_self_loops()}')

print(f'Is undirected: {data.is_undirected()}')运行结果:

Dataset: Cora():

======================

Number of graphs: 1

Number of features: 1433

Number of classes: 7Data(edge_index=[2, 10556], test_mask=[2708], train_mask=[2708], val_mask=[2708], x=[2708, 1433], y=[2708])

======================

Number of nodes: 2708

Number of edges: 10556

Average node degree: 3.90

Number of training nodes: 140

Training node label rate: 0.05

Contains isolated nodes: False

Contains self-loops: False

Is undirected: True

从结果得出,Cora图是无向图,拥有2708个节点,无孤立节点,10556条边,平均节点度为3.9,训练集使用了140个节点,占整体的5%。

可视化节点表征分布

利用TSNE方法将高维的节点表征映射到二维平面空间,然后在二维平面画出节点来实现节点表征分布的可视化。

import matplotlib.pyplot as plt

from sklearn.manifold import TSNEdef visualize(x, y):z = TSNE(n_components=2).fit_transform(x.detach().cpu().numpy())plt.figure(figsize=(10,10))plt.xticks([])plt.yticks([])plt.scatter(z[:, 0], z[:, 1], s=70, c=y, cmap="Set2")plt.show()visualize(data.x, data.y)

使用MLP神经网络进行节点分类

下面构建了一个简单的MLP神经网络,只对输入节点的表征做变换,在所有节点之间共享权重。

第一个线程层将1433维的节点表征嵌入(embedding)到低维空间中(hidden_channels=16),第二个线性层将节点表征嵌入到类别空间中(num_classes=7)。

MLP神经网络

- 模型

import torch

from torch.nn import Linear

import torch.nn.functional as Fclass MLP(torch.nn.Module):def __init__(self, hidden_channels):super(MLP, self).__init__()torch.manual_seed(12345)self.lin1 = Linear(dataset.num_features, hidden_channels)self.lin2 = Linear(hidden_channels, dataset.num_classes)def forward(self, x):x = self.lin1(x)x = x.relu()x = F.dropout(x, p=0.5, training=self.training)x = self.lin2(x)return xmodel = MLP(hidden_channels=16)

print(model)

MLP((lin1): Linear(in_features=1433, out_features=16, bias=True)(lin2): Linear(in_features=16, out_features=7, bias=True)

)

- 训练

model = MLP(hidden_channels=16)

criterion = torch.nn.CrossEntropyLoss() # Define loss criterion.

optimizer = torch.optim.Adam(model.parameters(), lr=0.01, weight_decay=5e-4) # Define optimizer.def train():model.train()optimizer.zero_grad() # Clear gradients.out = model(data.x) # Perform a single forward pass.loss = criterion(out[data.train_mask], data.y[data.train_mask]) # Compute the loss solely based on the training nodes.loss.backward() # Derive gradients.optimizer.step() # Update parameters based on gradients.return lossfor epoch in range(1, 201):loss = train()print(f'Epoch: {epoch:03d}, Loss: {loss:.4f}')Epoch: 001, Loss: 1.9615

Epoch: 002, Loss: 1.9557

Epoch: 003, Loss: 1.9505

Epoch: 004, Loss: 1.9423

Epoch: 005, Loss: 1.9327

...

Epoch: 196, Loss: 0.3615

Epoch: 197, Loss: 0.3985

Epoch: 198, Loss: 0.4664

Epoch: 199, Loss: 0.3714

Epoch: 200, Loss: 0.3810

3.测试

def test():model.eval()out = model(data.x)pred = out.argmax(dim=1) # Use the class with highest probability.test_correct = pred[data.test_mask] == data.y[data.test_mask] # Check against ground-truth labels.test_acc = int(test_correct.sum()) / int(data.test_mask.sum()) # Derive ratio of correct predictions.return test_acctest_acc = test()

print(f'Test Accuracy: {test_acc:.4f}')

Test Accuracy: 0.5900

MLP只有大约59%的测试准确性,该模型表现不佳。

MLP表现不佳其中一个重要原因是,用于训练此神经网络的有标签节点数量过少,产生了过拟合,所以泛化能力较差。

卷积图神经网络(GCN)

PyG中GCNConv 模块说明

GCNConv函数:

GCNConv(in_channels: int, out_channels: int, improved: bool = False, cached: bool = False, add_self_loops: bool = True, normalize: bool = True, bias: bool = True, **kwargs)

in_channels:输入数据维度;out_channels:输出数据维度;improved:如果为true, A ^ = A + 2 I \mathbf{\hat{A}} = \mathbf{A} + 2\mathbf{I} A^=A+2I,其目的在于增强中心节点自身信息;cached:是否存储 D ^ − 1 / 2 A ^ D ^ − 1 / 2 \mathbf{\hat{D}}^{-1/2} \mathbf{\hat{A}} \mathbf{\hat{D}}^{-1/2} D^−1/2A^D^−1/2的计算结果以便后续使用,这个参数只应在归纳学习(transductive learning)的场景中设置为true(归纳学习可以简单理解为在训练、验证、测试、推理(inference)四个阶段都只使用一个数据集);add_self_loops:是否在邻接矩阵中增加自环边;normalize:是否添加自环边并在运行中计算对称归一化系数;bias:是否包含偏置项。

GCNConv官方文档。

- 模型

将MLP中的torch.nn.Linear替换成torch_geometric.nn.GCNConv,就可以得到一个GCN图神经网络

from torch_geometric.nn import GCNConvclass GCN(torch.nn.Module):def __init__(self, hidden_channels):super(GCN, self).__init__()torch.manual_seed(12345)self.conv1 = GCNConv(dataset.num_features, hidden_channels)self.conv2 = GCNConv(hidden_channels, dataset.num_classes)def forward(self, x, edge_index):x = self.conv1(x, edge_index)x = x.relu()x = F.dropout(x, p=0.5, training=self.training)x = self.conv2(x, edge_index)return x未经训练的GCN图神经网络生成的节点表征可视化

model = GCN(hidden_channels=16)

model.eval()out = model(data.x, data.edge_index)

visualize(out, color=data.y)

通过visualize函数的可视化处理,7维特征的节点被映射到2维的平面上,能看到“同类节点群聚”的现象。

- 训练

model = GCN(hidden_channels=16)

optimizer = torch.optim.Adam(model.parameters(), lr=0.01, weight_decay=5e-4)

criterion = torch.nn.CrossEntropyLoss()def train(): model.train() optimizer.zero_grad() # Clear gradients. out = model(data.x, data.edge_index) # Perform a single forward pass. loss = criterion(out[data.train_mask], data.y[data.train_mask]) # Compute the loss solely based on the training nodes. loss.backward() # Derive gradients. optimizer.step() # Update parameters based on gradients. return lossfor epoch in range(1, 201): loss = train() print(f'Epoch: {epoch:03d}, Loss: {loss:.4f}')

- 测试

def test():model.eval()out = model(data.x, data.edge_index)pred = out.argmax(dim=1) # Use the class with highest probability.test_correct = pred[data.test_mask] == data.y[data.test_mask] # Check against ground-truth labels.test_acc = int(test_correct.sum()) / int(data.test_mask.sum()) # Derive ratio of correct predictions.return test_acctest_acc = test()

print(f'Test Accuracy: {test_acc:.4f}')

Test Accuracy: 0.8140

仅仅将torch.nn.Linear替换成torch_geometric.nn.GCNConv,我们获得了81.4%的测试准确率!与MLP图神经网络相比,GCN图神经网络准确性要高很多。这表明节点的邻接信息在取得更好的准确率方面起着关键作用。

训练后的GCN图神经网络生成的节点表征可视化

再来执行一遍可视化代码

model.eval()

out = model(data.x, data.edge_index)

visualize(out, color=data.y)

由可视化训练后的GCN图神经网络生成的节点表征,我们会发现“同类节点群聚”的现象更加明显了。说明GCN图神经网络生成的节点表征质量更高了。

图注意力神经网络(GAT)

PyG中GATConv 模块说明

GATConv构造函数接口:

GATConv(in_channels: Union[int, Tuple[int, int]], out_channels: int, heads: int = 1, concat: bool = True, negative_slope: float = 0.2, dropout: float = 0.0, add_self_loops: bool = True, bias: bool = True, **kwargs)

in_channels:输入数据维度;out_channels:输出数据维度;heads:在GATConv使用多少个注意力模型(Number of multi-head-attentions);concat:如为true,不同注意力模型得到的节点表征被拼接到一起(表征维度翻倍),否则对不同注意力模型得到的节点表征求均值;

GATConv官方文档

GAT图神经网络的构造

将MLP神经网络例子中的torch.nn.Linear替换成torch_geometric.nn.GATConv,来实现GAT图神经网络的构造

import torch

import torch.nn.functional as Ffrom torch_geometric.nn import GATConvclass GAT(torch.nn.Module):def __init__(self, hidden_channels):super(GAT, self).__init__()torch.manual_seed(12345)self.conv1 = GATConv(dataset.num_features, hidden_channels)self.conv2 = GATConv(hidden_channels, dataset.num_classes)def forward(self, x, edge_index):x = self.conv1(x, edge_index)x = x.relu()x = F.dropout(x, p=0.5, training=self.training)x = self.conv2(x, edge_index)return x基于GAT图神经网络的训练和测试,与基于GCN图神经网络的训练和测试相同,最后得到测试准确率有73.8%,效果也还是不错的

Test Accuracy: 0.7380

训练后的GAT图神经网络生成的节点表征可视化图如下

总结

在节点表征的学习中,MLP只考虑了节点自身属性,忽略了节点之间的连接关系,效果果最差的;而GCN与GAT同时考虑了节点自身信息与周围邻接节点的信息,因此结果优于MLP神经网络。图神经网络加入了对周围邻接节点的信息的考虑,是其优于普通深度神经网络的原因。

GCN图神经网络与GAT图神经网络的相同点为:

- 遵循消息传递范式;

- 在邻接节点信息变换阶段,对邻接节点做归一化和线性变换;

- 在邻接节点信息聚合阶段,将变换后的邻接节点信息做求和聚合;

- 在中心节点信息变换阶段,只是简单返回邻接节点信息聚合阶段的聚合结果。

GCN图神经网络与GAT图神经网络的区别在于邻接节点信息聚合过程中的归一化方法不同:

- GCN根据中心节点与邻接节点的度计算归一化系数,GAT根据中心节点与邻接节点的相似度计算归一化系数。

- GCN的归一化方式依赖于图的拓扑结构:不同的节点会有不同的度,同时不同节点的邻接节点的度也不同,于是在一些应用中GCN图神经网络会表现出较差的泛化能力。

- GAT的归一化方式依赖于中心节点与邻接节点的相似度,相似度是训练得到的,因此不受图的拓扑结构的影响,在不同的任务中都会有较好的泛化表现。

参考文献

- PyG中内置的数据转换方法:torch-geometric-transforms

- 一个可视化高纬数据的工具:t-distributed Stochastic Neighbor Embedding

- 提出GCN的论文:Semi-supervised Classification with Graph Convolutional Network

- GCNConv官方文档:torch_geometric.nn.conv.GCNConv

- 提出GAT的论文: Graph Attention Networks

![[图神经网络] 图节点Node表示---GAT](https://img-blog.csdnimg.cn/20210402154628129.png?x-oss-process=image/watermark,type_ZmFuZ3poZW5naGVpdGk,shadow_10,text_aHR0cHM6Ly9ibG9nLmNzZG4ubmV0L3p3cWpveQ==,size_16,color_FFFFFF,t_70)