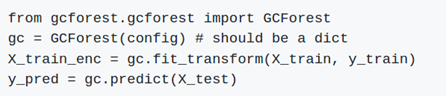

Sutton’sTD(0)算法:考虑当前回报和下一状态的估计值,它的更新公式 :

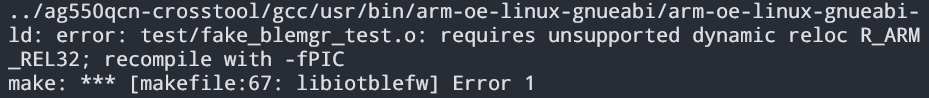

• Q-learing算法:它和Sutton’sTD(0)算法类似,只是将动作集A也考虑进来。 定义动作价值函数Q(s,a),

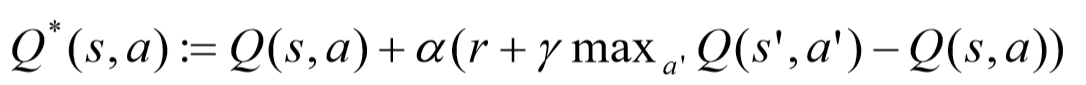

深度强化学习 DRL

深度学习感知能力强;强化学习决策能力强;结合更好!

根据环境做出的奖励来决策

典型应用:DQN

把Q-learning中的价值函数用深度神经网络来近似。

包括主网络和目标网络:

主网络:通过最大Q值选择action,而被选定的Q值则由目标网络生成

目标网络:辅助计算目标Q值,目的是避免网络陷入 目标Q值 与预测Q值的反馈循环。

经验回放experience replay

将系统探索环境得到的数据储存起来,然后随机采样样本****更新深度神经网络的参数。

对于时间序列信息,深度Q网络的处理方法是加入经验回放机制。 但是经验回放的记忆能力有限,每个决策点需要获取整个输入画 面进行感知记忆。

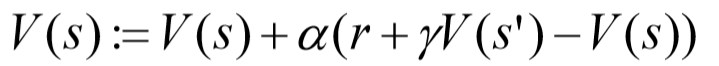

深度森林

决策树(Decision Tree),是一种基于树结构进行决策的机器学习 方法,这恰是人类面临决策时一种很自然的处理机制。

决策树生成过程:

1.寻找适合分割的特征。

2.根据纯度判断方法,寻找优的分割点,基于这一特征把数据分割成 纯度更高的两部分数据。

3.•判断是否达到要求,若未达到,重复步骤一继续分割,直到达到要求 停止为止。

4.剪枝,防止过拟合。

随机森林

随机建立一颗颗决策树,组成森林,决策树之间没有关联。当有一个新的样本输入,就让 每棵树独立 做出判断,按照 多数原则 决定该样本的分类结果。集成学习的思想。

•随机森林的生成方法

1.从样本集中通过重采样的方式产生n个样本

2.假设样本特征数目为a,对n个样本选择a中的k个特征,用建立决策树的方 式获得最佳分割点

3.重复m次,产生m棵决策树

4.按多数投票机制来进行预测

•优势 •

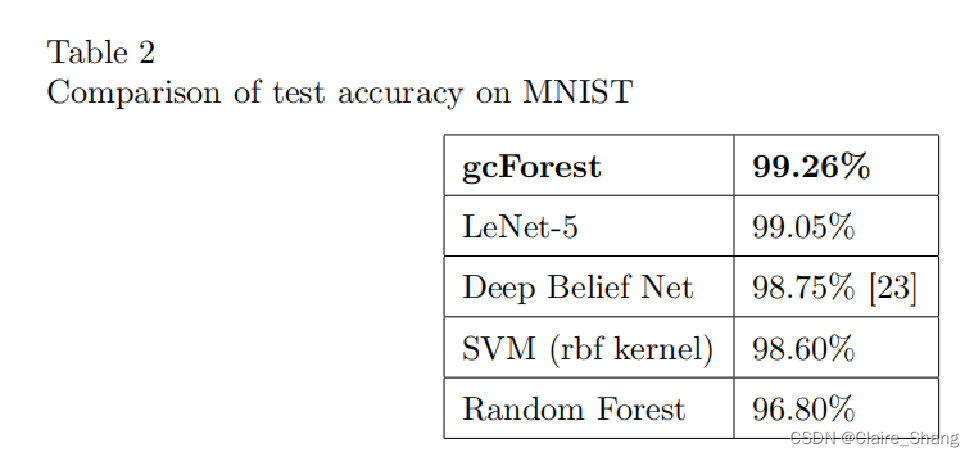

与DNN相比需要的参数更少。

训练速度快。

不仅适合大规模数据也适合小规模数据。

基于树模型解释性比较好

基于森林的自编码器

•自编码器(Auto-Encoder)是神经网络的一种,是一种重要的表 示学习模型,是深度学习的关键要素之一。自编码器的基本结构 是由一个编码器(encoder)和一个解码器(decoder)组成,其中 encoder将输入映射到隐空间,encoder将隐空间的表示重构为 原表示。

•eForest(Encoder-Forest)基于森林的自编码器,能够利用决策 树的决策路径所定义的等效类来进行**后向重建。**利用决策树集成 算法进行向前编码和向后解码的操作。

•前向编码 •在一个有N个已训练决策树的森林中,前向编码过程接受输入 数据并将其发送到集成方法中每棵树的根结点。 •一旦数据遍历(traverse)到所有树的叶结点,该过程将返回 T 维向量,T中的每个元素t 是树t 中的叶结点的整数索引。

•后向解码

•利用决策树进行决策时需要将决策的路径记录下来,而每个决 策路径对应了一个规则(rule)。

•在进行解码重构的过程中,利用森林中N个规则,运用大相 容规则Maximum Compatible Rule(MCR),获取N维编码所 对应的更精确的规则,以此规则进行重构。

•优势

•训练速度较快。如在MNIST和CIFAR10 上的训练速度比基于 神经网络的模型快数倍以上。 •重构误差低。基于规则,而不是计算。 •容损性。编码规则具有强相关性,因此在部分损坏的情况下也 能很好地工作。 •可复用性

•不足

•与神经网络相比编码表达力不足。

•编码、解码速度相对神经网络较慢

深度森林适用条件

•具备逐层处理的任务

•内部特征无变化。

•参数不可微。

•一定的模型复杂度。