文章目录

- 1. 原理解析

- 1.1 什么是图像分类

- 1.2 如何实现图像分类

- 1.2.1 词袋模型(Bag-of-words)

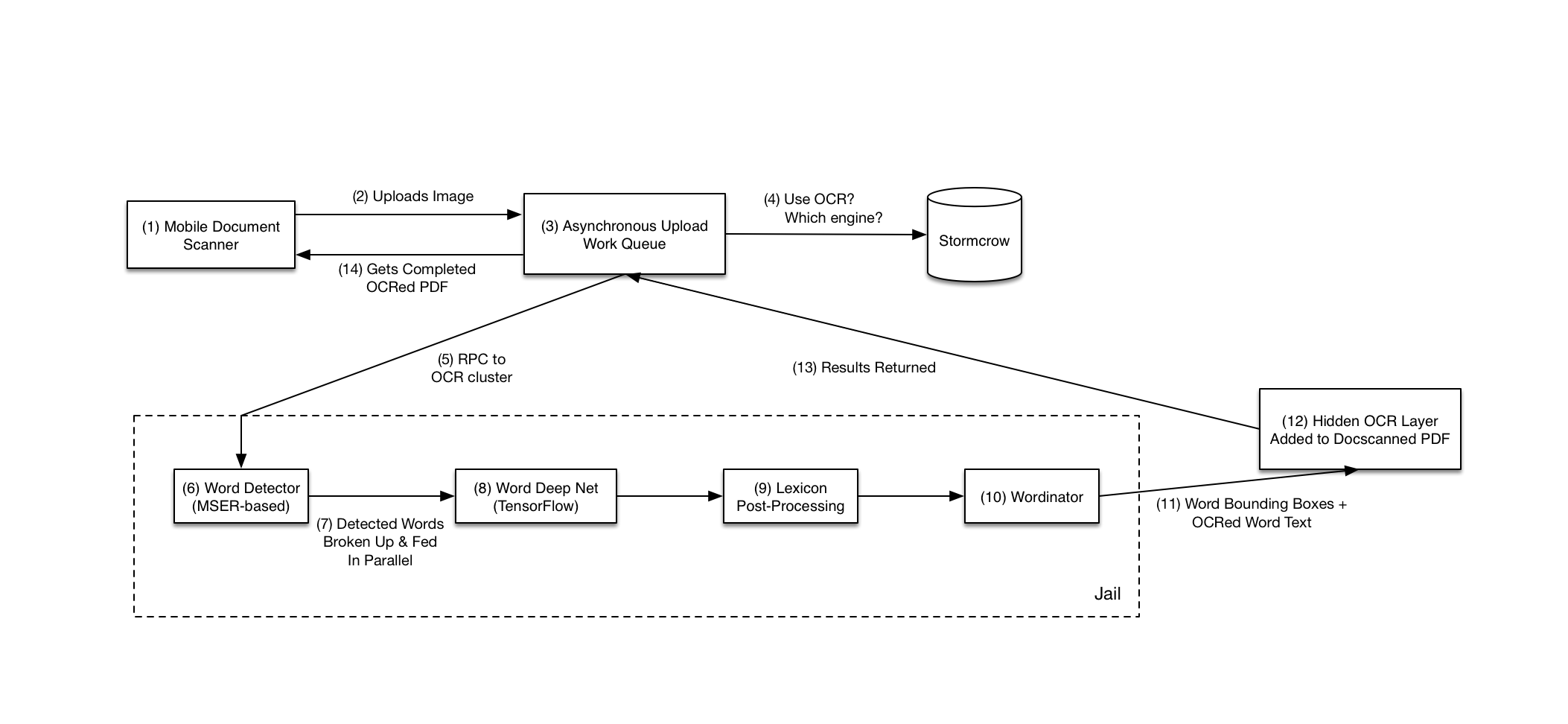

- 1.2.2 Bag-of-features模型

- 1.2.3 Bag-of-features算法

- 1.2.4 Bag-of-features过程

- 1.3 TF-IDF

- 1.4 图像分类遇到的问题

- 1.4.1 类内差异

- 1.4.2 类间差异

- 1.4.3 语义鸿沟

- 2. 代码实现

- 2.1 数据准备

- 2.2 实验过程

- 3. 总结

1. 原理解析

1.1 什么是图像分类

图像分类:即通过图像内容的不同将图像划分为不同的类别,基于内容的图像分类技术不需要对图像的语义信息进行人工标注,而是通过计算机提取图像中所包含的特征,并对特征进行处理和分析,得出分类结果。

常用的图像特征有 图像颜色、纹理、灰度等信息。

而图像分类过程中,提取的特征要求不容易受随机因素干扰,特征的有效提取可提高图像分类的精度。

特征提取完成后,选择合适的算法创建图像类型与视觉特征之间的关联度,对图像进行类别划分。

图像分类领域中,根据图像分类要求,一般可以分为 场景分类和 目标分类两类问题。

-

场景分类也可以称为事件分类,场景分类是对 整幅图像所代表的 整体信息进行分类,或者是对图像中 所发生事件的总体描述。

-

目标分类(又称为物体分类)是对图像中 出现的目标 (物体)进行识别或分类。

1.2 如何实现图像分类

1.2.1 词袋模型(Bag-of-words)

BoW(Bag-of-words)起始可以理解为一种直方图统计,开始是用于自然语言处理和信息检索中的一种简单的文档表示方法。BoW也只是统计频率信息,并没有序列信息。BoW是选择words字典,然后统计字典中每个单词出现的次数。

BoW(Bag of Words)词袋模型最初被用在文本分类中,将文档表示成特征矢量。它的基本思想是假定对于一个文本,忽略其词序和语法、句法,仅仅将其看做是一些词汇的集合,而文本中的每个词汇都是独立的。简单说就是讲每篇文档都看成一个袋子(因为里面装的都是词汇,所以称为词袋,Bag of words即因此而来),然后看这个袋子里装的都是些什么词汇,将其分类。如果文档中猪、马、牛、羊、山谷、土地、拖拉机这样的词汇多些,而银行、大厦、汽车、公园这样的词汇少些,我们就倾向于判断它是一篇描绘乡村的文档,而不是描述城镇的。

1.2.2 Bag-of-features模型

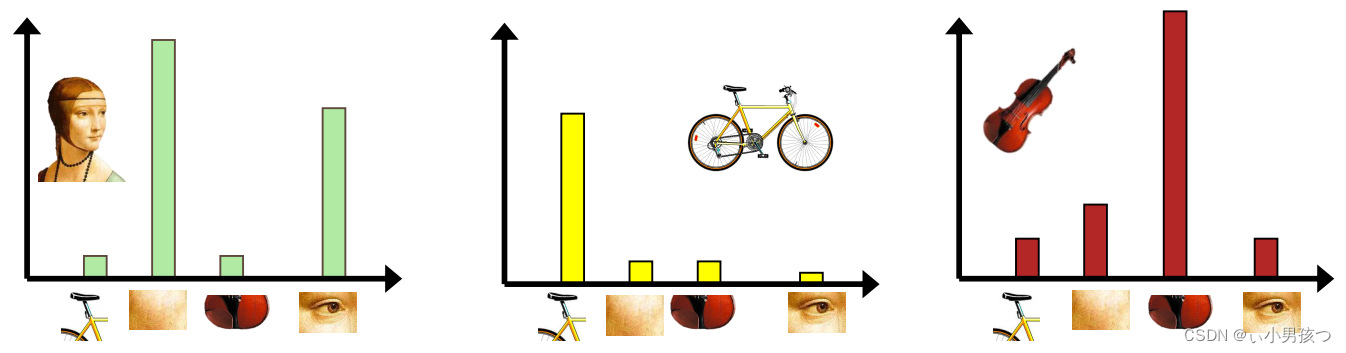

- Bag of Feature 也是借鉴了这种思路,只不过在图像中,我们抽出的不再是一个个word,而是图像的关键特征Feature,所以研究人员将它更名为Bag of Feature。

- Bag of Feature在检索中的算法流程和分类几乎完全一样,唯一的区别在于,对于原始的 BOF 特征,也就是直方图向量,我们引入TF-IDF 权值。

1.2.3 Bag-of-features算法

Bag of Feature的本质是提出一种图像的特征表示方法

按照Bag of Feature算法的思想,首先我们要找到图像中的关键词,而且这些关键词必须具备较高的区分度。实际过程中,通常会采用SIFT特征。

有了特征之后,我们会将这些特征通过聚类算法得出很多聚类中心。这些聚类中心通常具有较高的代表性,比如,对于人脸来说,虽然不同人的眼睛、鼻子等特征都不尽相同,但它们往往具有共性,而这些聚类中心就代表了这类共性。我们将这些聚类中心组合在一起,形成一部字典(CodeBook)。

对于图像中的每个SIFT特征,我们能够在字典中找到最相似的聚类中心,统计这些聚类中心出现的次数,可以得到一个向量表示(有些文章称之为直方图)这些向量就是所谓的Bag。这样,对于不同类别的图片,这个向量应该具有较大的区分度,基于此,我们可以训练出一些分类模型(SVM等),并用其对图片进行分类。

1.2.4 Bag-of-features过程

Bag of Feature大概分为四步:

1)提取图像特征

2)对特征进行聚类,得到一部字典( visual vocabulary )

3)根据字典将图片表示成向量(直方图)

4)把输入图片转化成视觉单词的频率直方图

-

提取图像特征

特征必须具有较高的区分度,而且要满足旋转不变性以及尺寸不变性等,因此,我们通常都会采用SIFT特征(有时为了降低计算量,也会采用其他特征,如:SURF )。SIFT会从图片上提取出很多特征点,每个特征点都是 128 维的向量,因此,如果图片足够多的话,我们会提取出一个巨大的特征向量库。

-

训练字典( visual vocabulary )

提取完特征后,我们会采用一些聚类算法对这些特征向量进行聚类。最常用的聚类算法是 k-means。至于 k-means 中的 k 如何取,要根据具体情况来确定。另外,由于特征的数量可能非常庞大,这个聚类的过程也会非常漫长。聚类完成后,我们就得到了这 k 个向量组成的字典,这 k 个向量有一个通用的表达,叫 visual word。

-

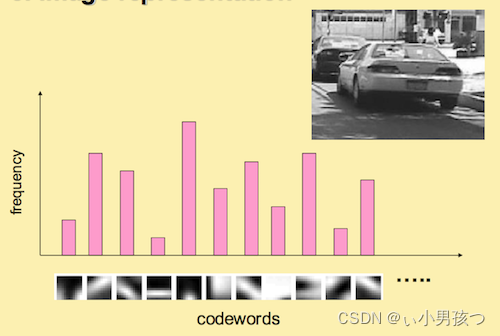

图像直方图表示

上一步训练得到的字典,是为了这一步对图像特征进行量化。对于一幅图像而言,我们可以提取出大量的SIFT特征点,但这些特征点仍然属于一种浅层(low level)的表达,缺乏代表性。因此,这一步的目标,是根据字典重新提取图像的高层特征。

具体做法是,对于图像中的每一个SIFT特征,都可以在字典中找到一个最相似的 visual word,这样,我们可以统计一个 k 维的直方图,代表该图像的SIFT特征在字典中的相似度频率。

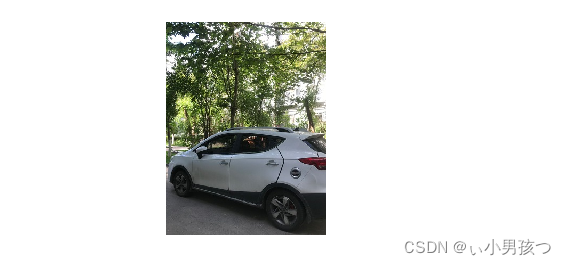

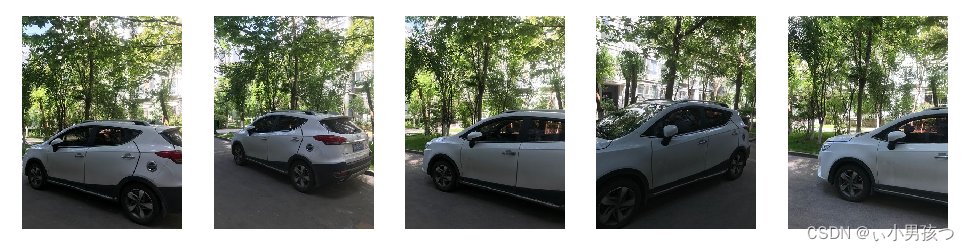

例如:对于上图这辆车的图片,我们匹配图片的SIFT向量与字典中的 visual word,统计出最相似的向量出现的次数,最后得到这幅图片的直方图向量。

- 训练分类器

当我们得到每幅图片的直方图向量后,剩下的这一步跟以往的步骤是一样的。无非是数据库图片的向量以及图片的标签,训练分类器模型。然后对需要预测的图片,我们仍然按照上述方法,提取SIFT特征,再根据字典量化直方图向量,用分类器模型对直方图向量进行分类。当然,也可以直接根据 KNN 算法对直方图向量做相似性判断。

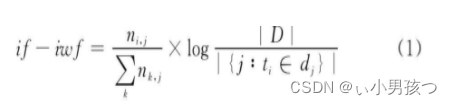

1.3 TF-IDF

TF-IDF(Term frequency-Inverse document frequency)是一种统计方法,用来评估特征词的重要程度。根据TF-IDF公式,特征词的权重与在 语料库中出现的频率有关,也与在文档里出现的频率有关。传统的TF-IDF公式如下:

TF-IDF用以评估一字词对于一个文件集或一个语料库中的其中一份文件的重要程度。字词的重要性随着它在文件中出现的次数成正比增加,但同时会随着它在语料库中出现的频率成反比下降。就目前来说,如果一个 关键词只在很少的网页中出现,我们通过它就 容易锁定搜索目标,它的 权重也就应该 大。反之如果一个词在大量网页中出现,我们看到它仍然 不是很清楚要找什么内容,因此它的权重应该 小。

1.4 图像分类遇到的问题

图像分类的目的是 通过图像内容对一幅未知图像进行分类。

但人类自身进行观察时,由于人们对图像的理解不同,偏重不同,不同的人也会产生不同的结果,而且人为判断一幅图像的类别时,具有一定的主观性。而计算机是客观的,它会通过一定的数据信息来判断图像的类别。因此图像分类是一个比较困难的问题,并且该问题很难达到完美,

现在的分类方法大多都是尽可能地将分类准确率继续提高。

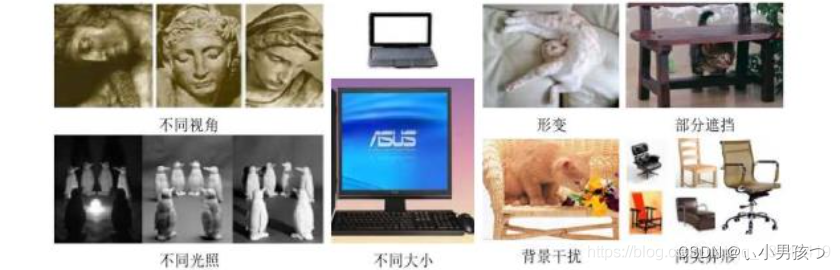

图像分类过程中遇到的问题主要是由 图像的类内变化、 图像类间的语义差异和 语义鸿沟造成的。

1.4.1 类内差异

所谓类内差异表示的是属于同一类的图像,由于各种原因,使图像的内容呈现出多种变化。

类内差异主要包括: 视角差异、目标形变、光照差异、尺度差异、部分遮挡、复杂背景、同类异形等。

1.4.2 类间差异

所谓类间差异指的是不同类别含有相同的底层特征,导致不同类别图像分为同一类别。

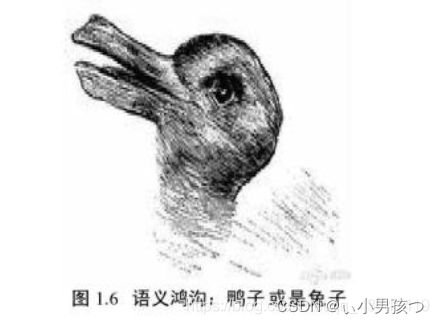

1.4.3 语义鸿沟

长期的知识积累,人类可以通过对图像高层次的抽象理解进而对语义的相似性进行判断。

但计算机只能通过图像底层的统计特征来判断图像类别,不具备人类 对图像进行抽象和推理的能力,导致计算机提取的图像底层视觉特征获取的图像类别信息和人类对图像的理解获取的图像类别信息不一致,造成“语义鸿沟”,

“语义鸿沟” 实际上就是图像的 底层视觉特征与 高层语义信息之间的 客观区别。

2. 代码实现

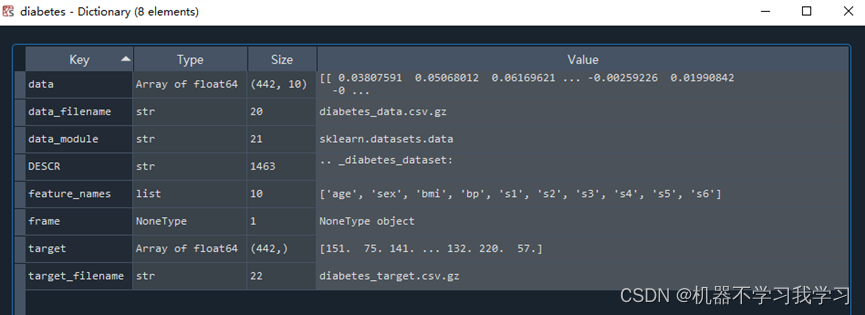

2.1 数据准备

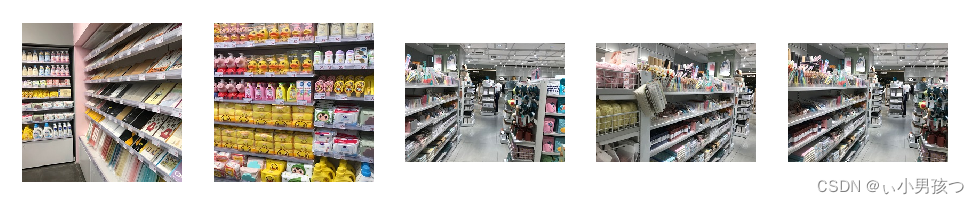

准备两组数据,分别如下所示

2.2 实验过程

(1)特征提取

# -*- coding: utf-8 -*-

import pickle

from PCV.imagesearch import vocabulary

from PCV.tools.imtools import get_imlist

import sift#获取图像列表

#imlist = get_imlist('E:/Python37_course/test7/first1000/')

imlist = get_imlist('C:/Users/abc/Desktop/test7/BOP')

nbr_images = len(imlist)

#获取特征列表

featlist = [imlist[i][:-3]+'sift' for i in range(nbr_images)]#提取文件夹下图像的sift特征

for i in range(nbr_images):sift.process_image(imlist[i], featlist[i])#生成词汇

#voc = vocabulary.Vocabulary('ukbenchtest')

#voc.train(featlist, 1000, 10)

voc = vocabulary.Vocabulary('test77_test')

voc.train(featlist, 122, 10)#保存词汇

# saving vocabulary

'''with open('E:/Python37_course/test7/first1000/vocabulary.pkl', 'wb') as f:pickle.dump(voc, f)'''

with open('C:/Users/abc/Desktop/test7/BOP/vocabulary.pkl', 'wb') as f:pickle.dump(voc, f)

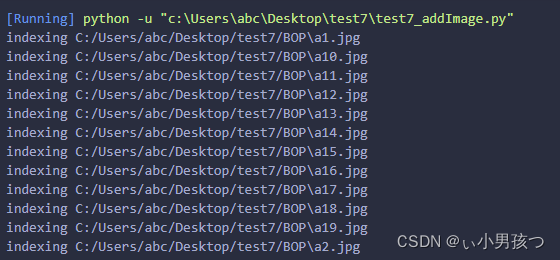

print ('vocabulary is:', voc.name, voc.nbr_words)(2) 将上面得到的数据模型存放数据库testImaAdd.db中,即运行下面代码会生成一个testImaAdd.db数据库文件

# -*- coding: utf-8 -*-

import pickle

from PCV.imagesearch import imagesearch

from PCV.localdescriptors import sift

import sqlite3

from PCV.tools.imtools import get_imlist#获取图像列表

#imlist = get_imlist('E:/Python37_course/test7/first1000/')

imlist = get_imlist('C:/Users/abc/Desktop/test7/BOP')

nbr_images = len(imlist)

#获取特征列表

featlist = [imlist[i][:-3]+'sift' for i in range(nbr_images)]# load vocabulary

#载入词汇

'''with open('E:/Python37_course/test7/first1000/vocabulary.pkl', 'rb') as f:voc = pickle.load(f)'''

with open('C:/Users/abc/Desktop/test7/BOP/vocabulary.pkl', 'rb') as f:voc = pickle.load(f)

#创建索引

indx = imagesearch.Indexer('testImaAdd.db',voc)

indx.create_tables()

# go through all images, project features on vocabulary and insert

#遍历所有的图像,并将它们的特征投影到词汇上#for i in range(nbr_images)[:1000]:

for i in range(nbr_images)[:122]:locs,descr = sift.read_features_from_file(featlist[i])indx.add_to_index(imlist[i],descr)

# commit to database

#提交到数据库

indx.db_commit()con = sqlite3.connect('testImaAdd.db')

print (con.execute('select count (filename) from imlist').fetchone())

print (con.execute('select * from imlist').fetchone())

(3)匹配重排

# -*- coding: utf-8 -*-

import pickle

import sift

from PCV.imagesearch import imagesearch

from PCV.geometry import homography

from PCV.tools.imtools import get_imlist# load image list and vocabulary

#载入图像列表

#imlist = get_imlist('E:/Python37_course/test7/first1000/')

imlist = get_imlist('C:/Users/abc/Desktop/test7/BOP')

nbr_images = len(imlist)

#载入特征列表

featlist = [imlist[i][:-3]+'sift' for i in range(nbr_images)]#载入词汇

'''with open('E:/Python37_course/test7/first1000/vocabulary.pkl', 'rb') as f:voc = pickle.load(f)'''

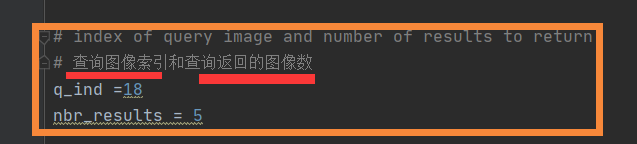

with open('C:/Users/abc/Desktop/test7/BOP/vocabulary.pkl', 'rb') as f:voc = pickle.load(f)src = imagesearch.Searcher('testImaAdd.db',voc)# index of query image and number of results to return

#查询图像索引和查询返回的图像数

q_ind = 111

nbr_results = 6# regular query

# 常规查询(按欧式距离对结果排序)

res_reg = [w[1] for w in src.query(imlist[q_ind])[:nbr_results]]

print ('top matches (regular):', res_reg)# load image features for query image

#载入查询图像特征

q_locs,q_descr = sift.read_features_from_file(featlist[q_ind])

fp = homography.make_homog(q_locs[:,:2].T)# RANSAC model for homography fitting

#用单应性进行拟合建立RANSAC模型

model = homography.RansacModel()

rank = {}# load image features for result

#载入候选图像的特征

for ndx in res_reg[1:]:locs,descr = sift.read_features_from_file(featlist[ndx]) # because 'ndx' is a rowid of the DB that starts at 1# get matchesmatches = sift.match(q_descr,descr)ind = matches.nonzero()[0]ind2 = matches[ind]tp = homography.make_homog(locs[:,:2].T)# compute homography, count inliers. if not enough matches return empty listtry:H,inliers = homography.H_from_ransac(fp[:,ind],tp[:,ind2],model,match_theshold=4)except:inliers = []# store inlier countrank[ndx] = len(inliers)# sort dictionary to get the most inliers first

sorted_rank = sorted(rank.items(), key=lambda t: t[1], reverse=True)

res_geom = [res_reg[0]]+[s[0] for s in sorted_rank]

print ('top matches (homography):', res_geom)# 显示查询结果

imagesearch.plot_results(src,res_reg[:6]) #常规查询

imagesearch.plot_results(src,res_geom[:6]) #重排后的结果(4)测试结果

输入:

输出:

输入:

输出:

3. 总结

-

对输出的结果,首先是载入图像列表、特征列表及词汇。然后创建一个Searcher对象,执行定期查询,并将结果保存在res_reg列表中,然后载入res_reg列表中每一幅图像特征,并和查询的图像进行匹配。当隐形通过计算匹配数和计数内点数得到,最终可通过减少内点数目对包含图像索引和内点数的字典进行排序。最后可视化检索靠前的匹配图像结果。

-

使用Bag-Of-Features的原因:进行图像检索的时候,我们可以用穷举的方法,但是一一匹配效率太过低,工作量过大,于是参考文本信息检索的模型,提取特征点进行降维处理。在文本信息检索中,BOW模型假定对于一个文档,忽略它的单词顺序和语法、句法等要素,将其仅仅看作是若干个词汇的集合,文档中每个单词的出现都是独立的,不依赖于其它单词是否出现。也就是说,文档中任意一个位置出现的任何单词,都不受该文档语意影响而独立选择的。

![[5机器学习]python计算机视觉应用-图片内容识别](https://img-blog.csdnimg.cn/img_convert/891f8f50c41eea0d6a681048835d1c25.png)