第二章 CNN基本部件

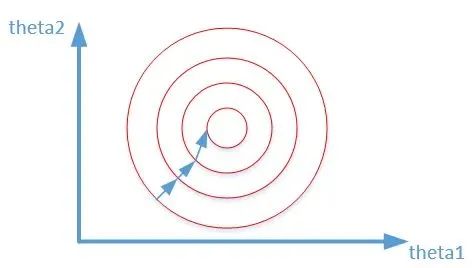

1.理解批处理和随机梯度下降:

训练模型时随机选取n个训练样本作为一个batch(批输入),那么经过设计好的卷积神经网络就可以输出n个预测值,对这n个预测值求其损失函数(注意损失函数绝不是一个样本一个样本求的,它是n个样本的总体误差,需要除以n的),然后用梯度下降的方法更新参数,这样的一次过程就叫批处理(mini-batch)

而我们选取样本的方式是不放回随机抽样直至遍历所有样本,就是我理解的随机梯度下降。

2.理解BP算法:

基于链式法则,其实就是求偏导时换元的问题。

注:

注:

即X(i+1)对w(i)求偏导等于Xi

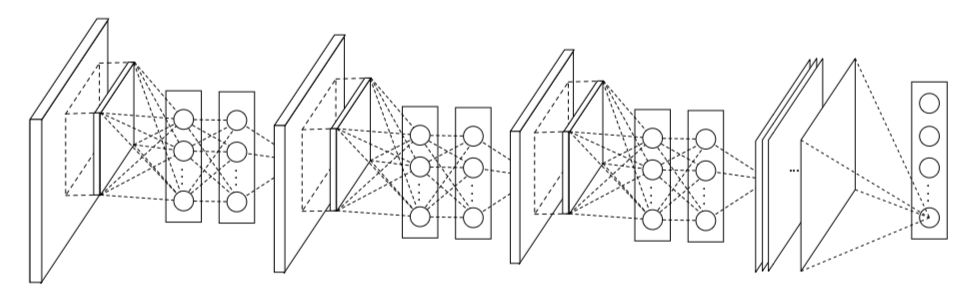

3.理解卷积的操作:

对于黑白图像仅有一个通道很好理解,就是用一个二维(如3X3)的矩阵去不断滑动黑白图像,提取特征。

而对于彩色图像,有RGB三个通道,它的输入比如是(6X6X3),这时我们一个卷积核,注意是一个卷积核,维度就是(比如3X3X3),卷积核的矩阵也需变成三个通道,然后对应相乘相加求和,得出只有一个二维矩阵了。

注意一个卷积核情况下会把原来输入的三个通道的矩阵变成一个通道,而我们可以选择用多个卷积核,比如选三个卷积核,即3个3X3X3矩阵来做卷积运算,此时我们获得矩阵就又有三个通道。

4.池化层:池化层的作用是防止过拟合化以及降低卷积之后得到的矩阵维度,(一般会设置多个卷积核得到多个维度的矩阵,此时池化会降低每个维度下的矩阵大小,从而减少计算量。与卷积操作不同的是,池化这一层它不改变输入的维度。

4.池化层:池化层的作用是防止过拟合化以及降低卷积之后得到的矩阵维度,(一般会设置多个卷积核得到多个维度的矩阵,此时池化会降低每个维度下的矩阵大小,从而减少计算量。与卷积操作不同的是,池化这一层它不改变输入的维度。

![[读书笔录]解析卷机神经网络(魏秀参)——第二章](https://img-blog.csdn.net/20180115175311216?watermark/2/text/aHR0cDovL2Jsb2cuY3Nkbi5uZXQvcG9pc29uMTAxOQ==/font/5a6L5L2T/fontsize/400/fill/I0JBQkFCMA==/dissolve/70/gravity/SouthEast)

![[读书笔录]解析卷机神经网络(魏秀参)——第三章](https://img-blog.csdn.net/20180920114413474?watermark/2/text/aHR0cHM6Ly9ibG9nLmNzZG4ubmV0L3BvaXNvbjEwMTk=/font/5a6L5L2T/fontsize/400/fill/I0JBQkFCMA==/dissolve/70)

![[读书笔录]解析卷积神经网络(魏秀参)——第一章](https://img-blog.csdn.net/20180223110231569?watermark/2/text/aHR0cDovL2Jsb2cuY3Nkbi5uZXQvcG9pc29uMTAxOQ==/font/5a6L5L2T/fontsize/400/fill/I0JBQkFCMA==/dissolve/70)

![[阅读笔记]《解析卷积神经网络_深度学习实践手册》魏秀参著](https://img-blog.csdnimg.cn/20190326224239715.png?x-oss-process=image/watermark,type_ZmFuZ3poZW5naGVpdGk,shadow_10,text_aHR0cHM6Ly9ibG9nLmNzZG4ubmV0L3FxXzMxODk1OTQz,size_16,color_FFFFFF,t_70)