文章目录

- 一、动作识别

- 二、动作识别的难点

- 三、动作识别现在常用的方法

- 四、行为识别的两个方向

- 五、常用数据集

- 六、常用框架介绍

一、动作识别

主要目标是判断一段视频中人的行为的类别,所以也可以叫做 Human Action Recognition。

二、动作识别的难点

1.类内和类之间差异, 同样一个动作,不同人的表现可能有极大的差异。

2.环境差异, 遮挡、多视角、光照、低分辨率、动态背景.

3.时间变化, 人在执行动作时的速度变化很大,很难确定动作的

起始点,从而在对视频提取特征表示动作时影响最大。

4.缺乏标注良好的大的数据集

三、动作识别现在常用的方法

1.传统方法:iDT

(1)密集轨迹算法(DT算法)

2.当前深度学习的方法

(1)GB+光流(two-stream、TSN)

(2)i3D、3D、(2+1D)卷积

(3)RNN(LSTM/GPU)

四、行为识别的两个方向

1.Action Recognition:

给定一个视频片段进行分类,一般使用的数据库都先将动作分割好了,一个视频片段中包含一段明确的动作,时间比较短。(其实就是输入一个视频,输出其动作分类)常用数据库:UCF101,HMDB51等等

2.Temporal Action Localization:

不仅要知道动作在视频中是否发生,还要知道动作发生在视频的哪段时间(开始和结束时间)。特点是处理较长的、未分割的视频。而且视频通常有较多的干扰,目标动作一般只占视频的一小部分。常用的数据库包括HUMOS2014/2015,ActivityNet。

五、常用数据集

1.The HMDB-51 Dataset(2011):

Brown university大学发布的HMDB51,视频多数来源于电影,还有一部分来自公共数据库以及YouTube等网络视频库.数据库包含有6849段样本,分为51类,每类至少包含有101段样本。

2.UCF-101(2012):

来源为YouTube视频,共计101类动作,13320段视频。共有5个大类的动作:1)人-物交互;2)肢体运动;3)人-人交互;4)弹奏乐器;5)运动.

3.Sport-1M(2014):

Sports1M包含487类各项运动,约110万个视频。此外,Sports1M 的视频长度平均超过5分钟,而标签预测的动作可能仅在整个视频的很小一部分时间中发生。Sports1M的标注通过分析和 youtube视频相关的文本元数据自动地生成,因此是不准确的。

4.Kinetics-600(2017):

Kinetics-600是一个大规模,高质量的YouTube视频网址数据集,其中包括各种人的行动。

该数据集由大约50万个视频剪辑组成,涵盖600个人类行为类,每个行为类至少有600个视频剪辑。每个剪辑持续约10秒钟,并标记一个类。所有剪辑都经过了多轮人工注释,每个剪辑都来自单独的YouTube视频。这些行为涵盖了广泛的类别,包括人与物体的互动,如演奏乐器,以及人与人之间的互动,如握手和拥抱。

六、常用框架介绍

1.iDT(2013):

DT 方法(是深度学习进入该领域前效果最好,稳定性最好,可靠性最高的方法,不过算法速度很慢(在于计算光流速度很慢)。

基本思路为利用光流场来获得视频序列中的一些轨迹,再沿着轨迹提取HOF,HOG,MBH,trajectory4种特征,其中HOF基于灰度图计算,另外几个均基于dense optical flow(密集光流)计算。最后利用FV(Fisher Vector)方法对特征进行编码,再基于编码结果训练SVM分类器。

2.two-stream(2014):

基本框架就是:一个是空间流网络或者叫RGB通路(Spatial stream ConvNet),一个是时间流网络或者叫光流通路(Temporal stream ConvNet)。主要优点就是既通过了图片来判断分类,又通过了动作来判断类,双重保障。

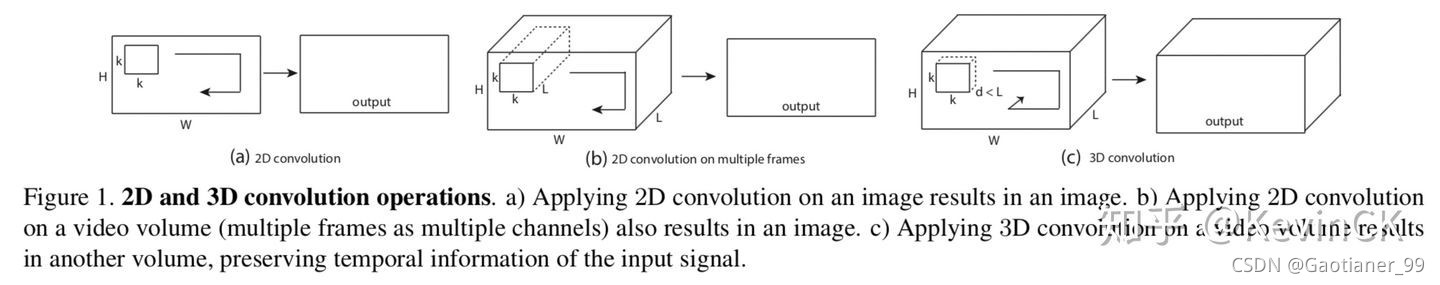

3.C3D(2015):

C3D卷积具备简单可靠、通用、高效和容易实现等特性。C3D可以汇聚视频的目标、场景和动作等相关信息,并适用于多重任务。C3D可以接受整个视频的帧,设计深层次的3D卷积时,借鉴了传统的2D卷积,并得到了一个相对最优的模型。

4.I3D

动作在单个帧中可能不明确,然而,现有动作识别数据集的局限性意味着性能最佳的视频架构不会明显偏离单图分析,因为他们依赖在ImageNet上训练的强大图像分类器。I3D用基于inception-V1模型,将2D卷积扩展到3D卷积。I3D性能更好的原因:一是I3D的架构更好,二是Kinetic数据集更具有普适性。

5.TSN(见后面的文章)