一、简介

ELK,包含三款产品,Elasticsearch、Logstash、Kibana,可在项目中作为日志框架使用。

项目中框架整合所需技术:

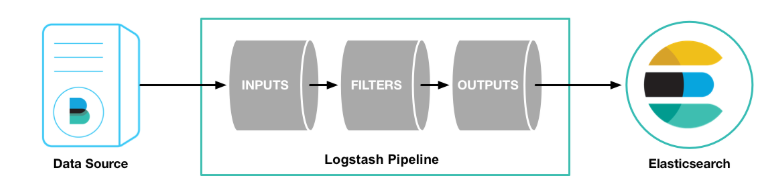

在整个方案中,各组件的作用如下:

- 应用服务

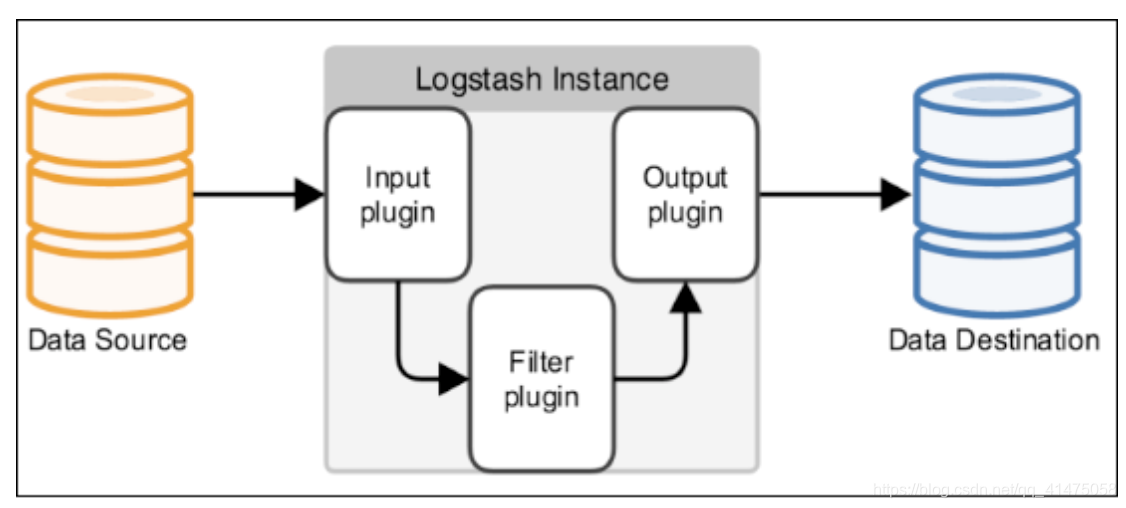

生产日志,通过Logger产生日志并输出。 - Logstash

收集日志,通过http接收应用服务产生的日志。 - Elasticsearch

为日志提供全文检索功能。 - kibana

为Elasticsearch提供图形化界面。

二、安装过程

环境

本文使用docker-compose启动elk,所以需要先安装好docker与docker-compose。

教程分别在《还不会安装docker?这里帮你搞定》,《如何安装docker-compose》。

服务端配置

创建文件夹,用来存放elk相关的数据

$ mkdir /data/elk

创建logstash配置文件:logstash-springboot.conf

$ touch /data/elk/logstash/logstash-springboot.conf

编辑logstash-springboot.conf文件,写入以下内容

input {tcp {mode => "server"host => "0.0.0.0"port => 4560codec => json_lines}

}

output {elasticsearch {hosts => "es:9200"index => "springboot-logstash-%{+YYYY.MM.dd}"}

}

创建docker-compose.yml文件

$ touch /data/elk/docker-compose.yml

编写docker-compose.yml文件,写入以下内容

version: '3'

services:elasticsearch:image: elasticsearch:7.6.2container_name: elasticsearchprivileged: trueuser: rootenvironment:- "cluster.name=elasticsearch" #设置集群名称为elasticsearch- "discovery.type=single-node" #以单一节点模式启动- "ES_JAVA_OPTS=-Xms512m -Xmx512m" #设置使用jvm内存大小volumes:- /data/elk/elasticsearch/plugins:/usr/share/elasticsearch/plugins #插件文件挂载- /data/elk/elasticsearch/data:/usr/share/elasticsearch/data #数据文件挂载ports:- 9200:9200- 9300:9300logstash:image: logstash:7.6.2container_name: logstashprivileged: trueenvironment:- TZ=Asia/Shanghaivolumes:- /data/elk/logstash/logstash-springboot.conf:/usr/share/logstash/pipeline/logstash.conf #挂载logstash的配置文件depends_on:- elasticsearch #logstash在elasticsearch启动之后再启动links:- elasticsearch:es #可以用es这个域名访问elasticsearch服务ports:- 4560:4560kibana:image: kibana:7.6.2container_name: kibanaprivileged: truelinks:- elasticsearch:es #可以用es这个域名访问elasticsearch服务depends_on:- elasticsearch #kibana在elasticsearch启动之后再启动environment:- "elasticsearch.hosts=http://es:9200" #设置访问elasticsearch的地址ports:- 5601:5601在docker-compose.yml所在目录执行启动命令

$ docker-compose up -d

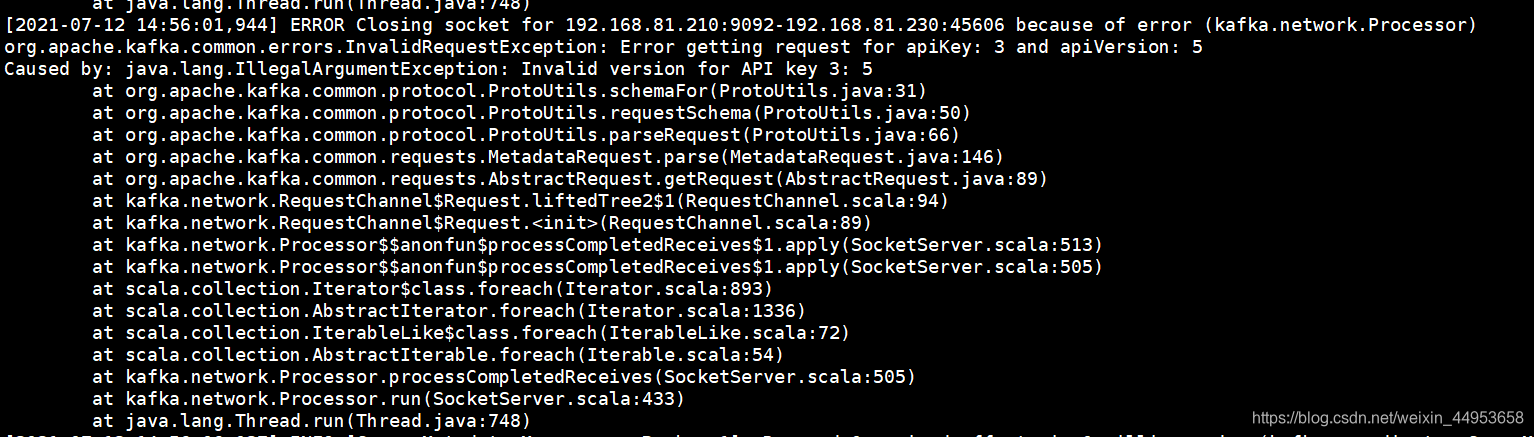

如果Elasticsearch启动报错,/usr/share/elasticsearch/data下的文件无权限,请给宿主机挂载的/data/elk/elasticsearch/data赋予权限:

$ chmod 777 /data/elk/elasticsearch/data

遇到错误时先关闭并删除容器

$ docker-compose down

在logstash中安装json_lines插件

# 进入logstash容器

docker exec -it logstash /bin/bash

# 进入bin目录

cd /bin/

# 安装插件

logstash-plugin install logstash-codec-json_lines

# 退出容器

exit

# 重启logstash服务

docker restart logstash

客户端配置

注意:本例应用服务是基于springboot开发的项目。

在pom.xml中引入依赖

<!--集成logstash-->

<dependency><groupId>net.logstash.logback</groupId><artifactId>logstash-logback-encoder</artifactId><version>5.3</version>

</dependency>

在resources文件夹下增加 logback-spring.xml文件,并写入以下内容

<?xml version="1.0" encoding="UTF-8"?>

<!DOCTYPE configuration>

<configuration><include resource="org/springframework/boot/logging/logback/defaults.xml"/><include resource="org/springframework/boot/logging/logback/console-appender.xml"/><!--应用名称--><property name="APP_NAME" value="springboot-logback-elk-demo"/><!--日志文件保存路径--><property name="LOG_FILE_PATH" value="${LOG_FILE:-${LOG_PATH:-${LOG_TEMP:-${java.io.tmpdir:-/tmp}}}/logs}"/><contextName>${APP_NAME}</contextName><!--每天记录日志到文件appender--><appender name="FILE" class="ch.qos.logback.core.rolling.RollingFileAppender"><rollingPolicy class="ch.qos.logback.core.rolling.TimeBasedRollingPolicy"><fileNamePattern>${LOG_FILE_PATH}/${APP_NAME}-%d{yyyy-MM-dd}.log</fileNamePattern><maxHistory>30</maxHistory></rollingPolicy><encoder><pattern>${FILE_LOG_PATTERN}</pattern></encoder></appender><!--输出到logstash的appender--><appender name="LOGSTASH" class="net.logstash.logback.appender.LogstashTcpSocketAppender"><!--可以访问的logstash日志收集端口--><destination>192.168.0.150:4560</destination><encoder charset="UTF-8" class="net.logstash.logback.encoder.LogstashEncoder"/></appender><root level="INFO"><appender-ref ref="CONSOLE"/><appender-ref ref="FILE"/><appender-ref ref="LOGSTASH"/></root>

</configuration>192.168.0.150:4560为我本机logstash的ip和端口,请自行设置。

重新启动项目后,项目输出的日志都会被收集到elk中。

Kibana

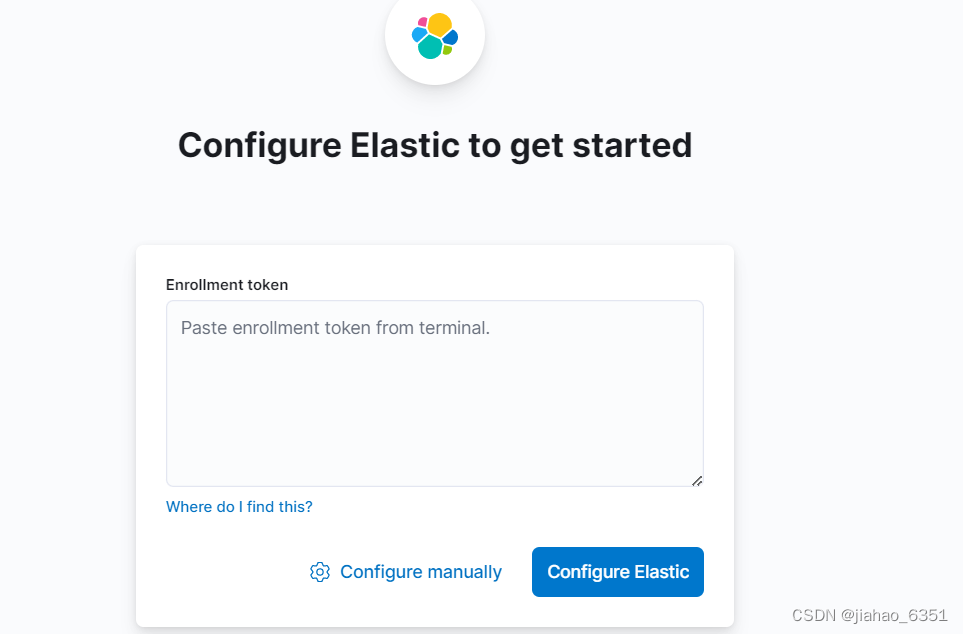

浏览器输入http://192.168.0.150:5601,访问Kibana web界面。

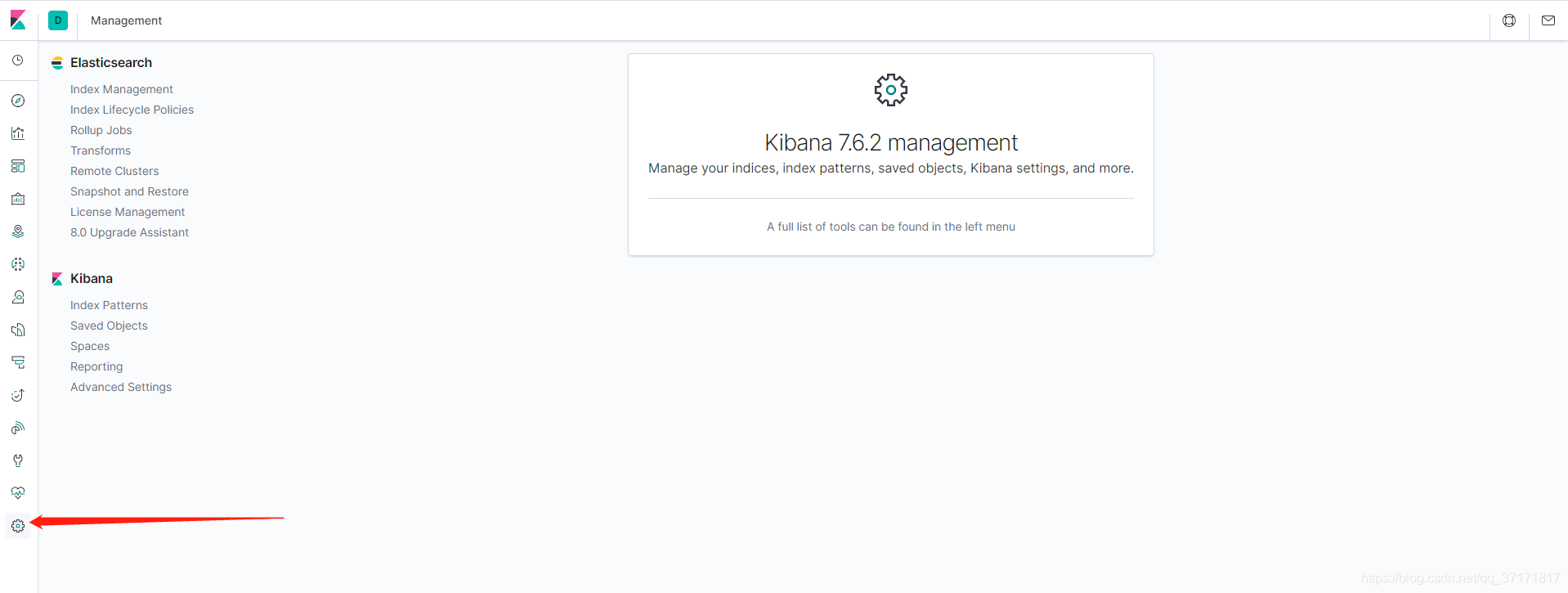

点击左侧设置,进入Management界面

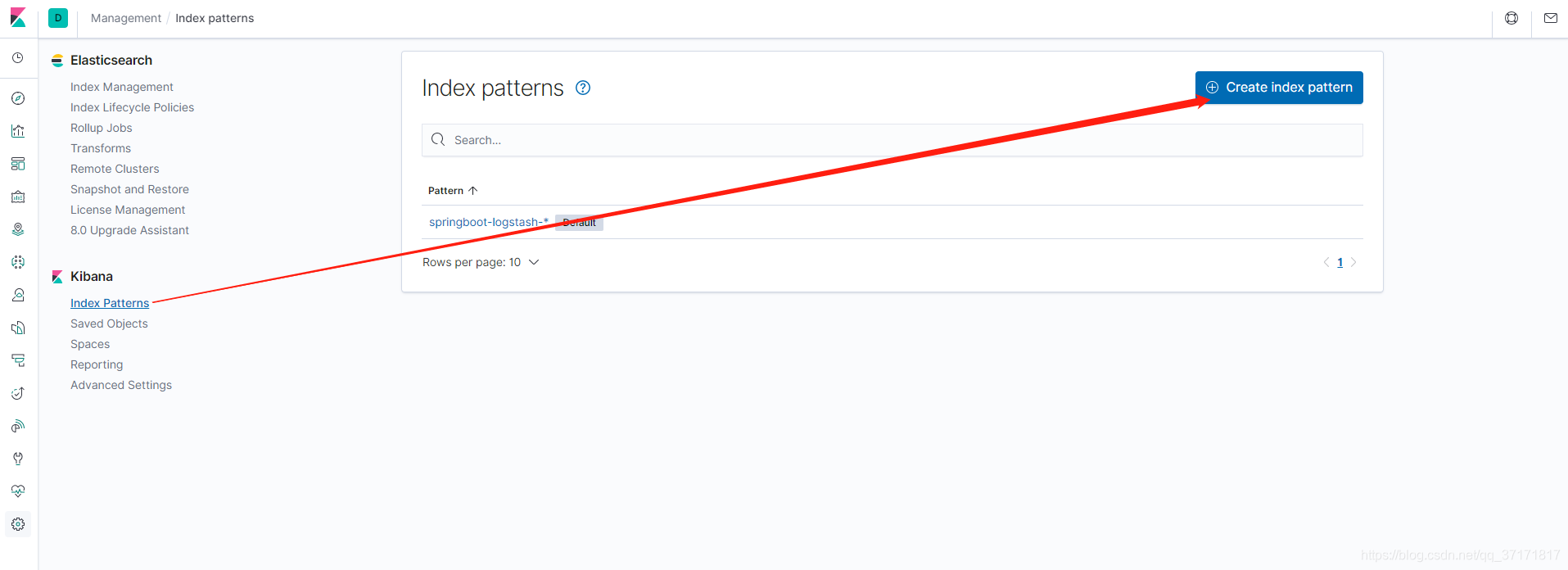

点击index Patterns后,点击创建索引

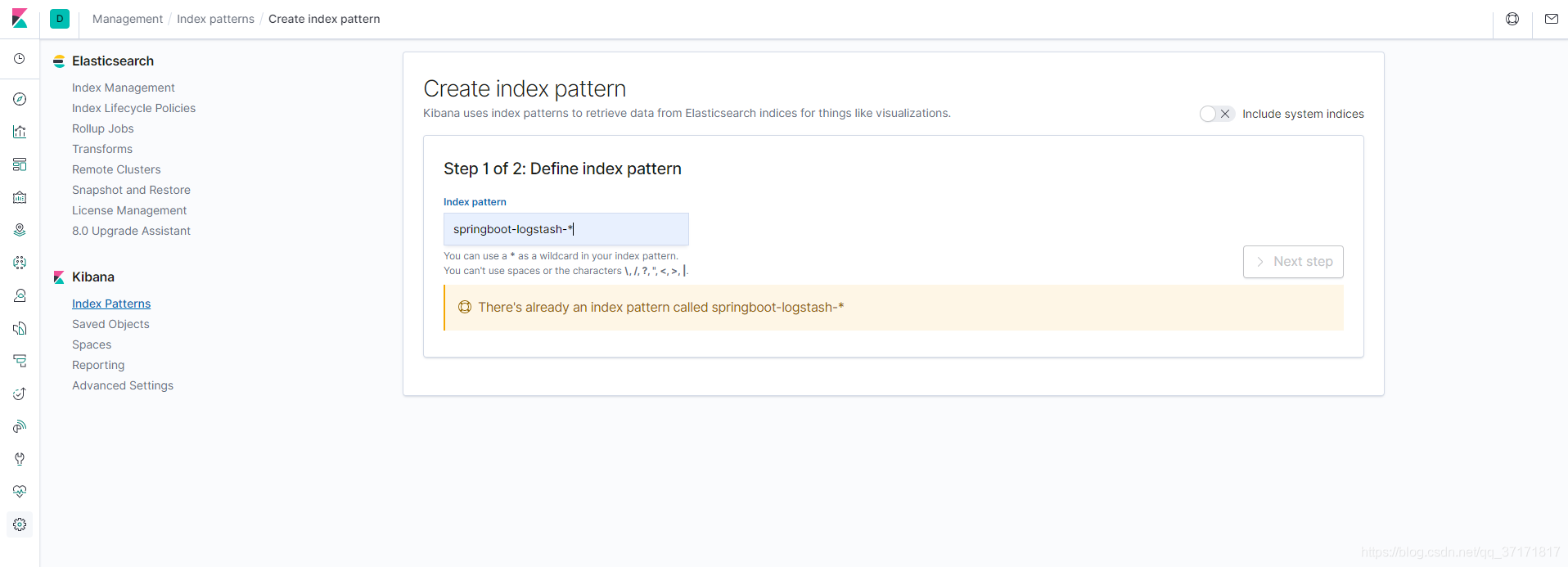

创建名称为springboot-logstash-*的index,然后在Next Step(下一步)中选择@timestamp的filter

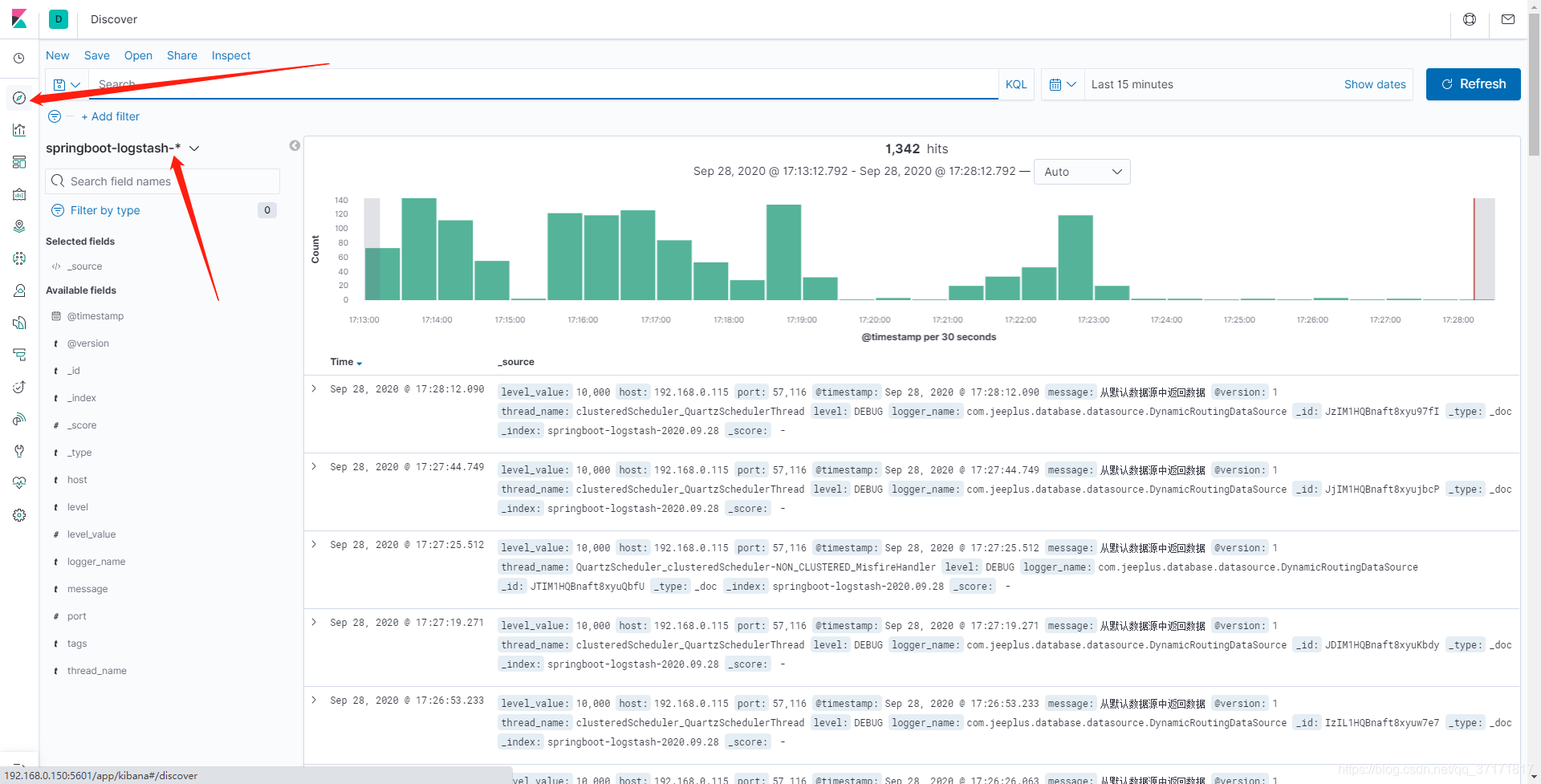

创建完成之后,点击Discover,并选择刚才创建的index

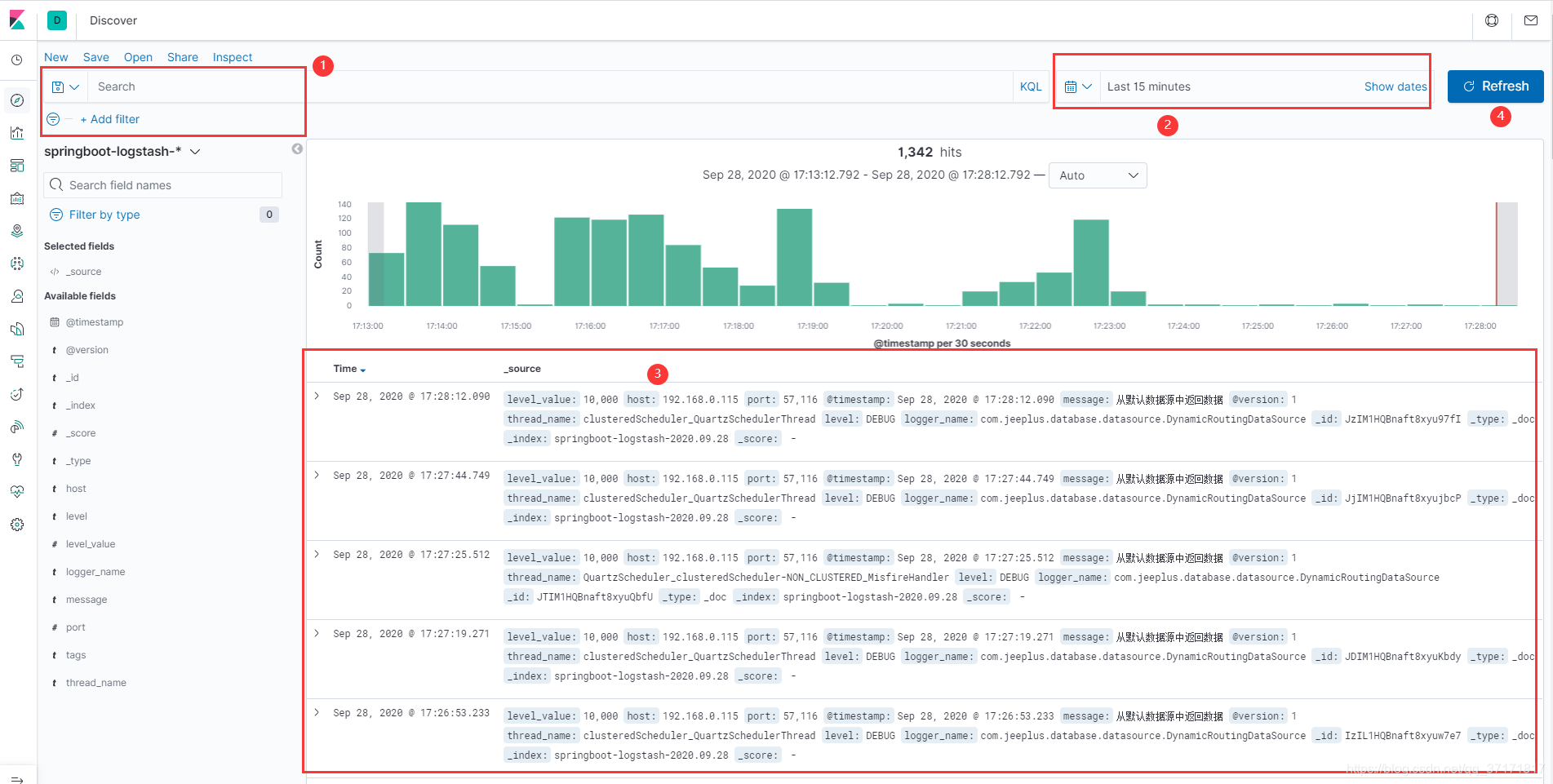

1为搜索区域,可以根据Elasticsearch的搜索规则对日志进行搜索。

2为时间选择区域,默认过滤出最近15分钟的日志。

3为日志内容,即为应用服务输出的日志。

4为搜索按钮。

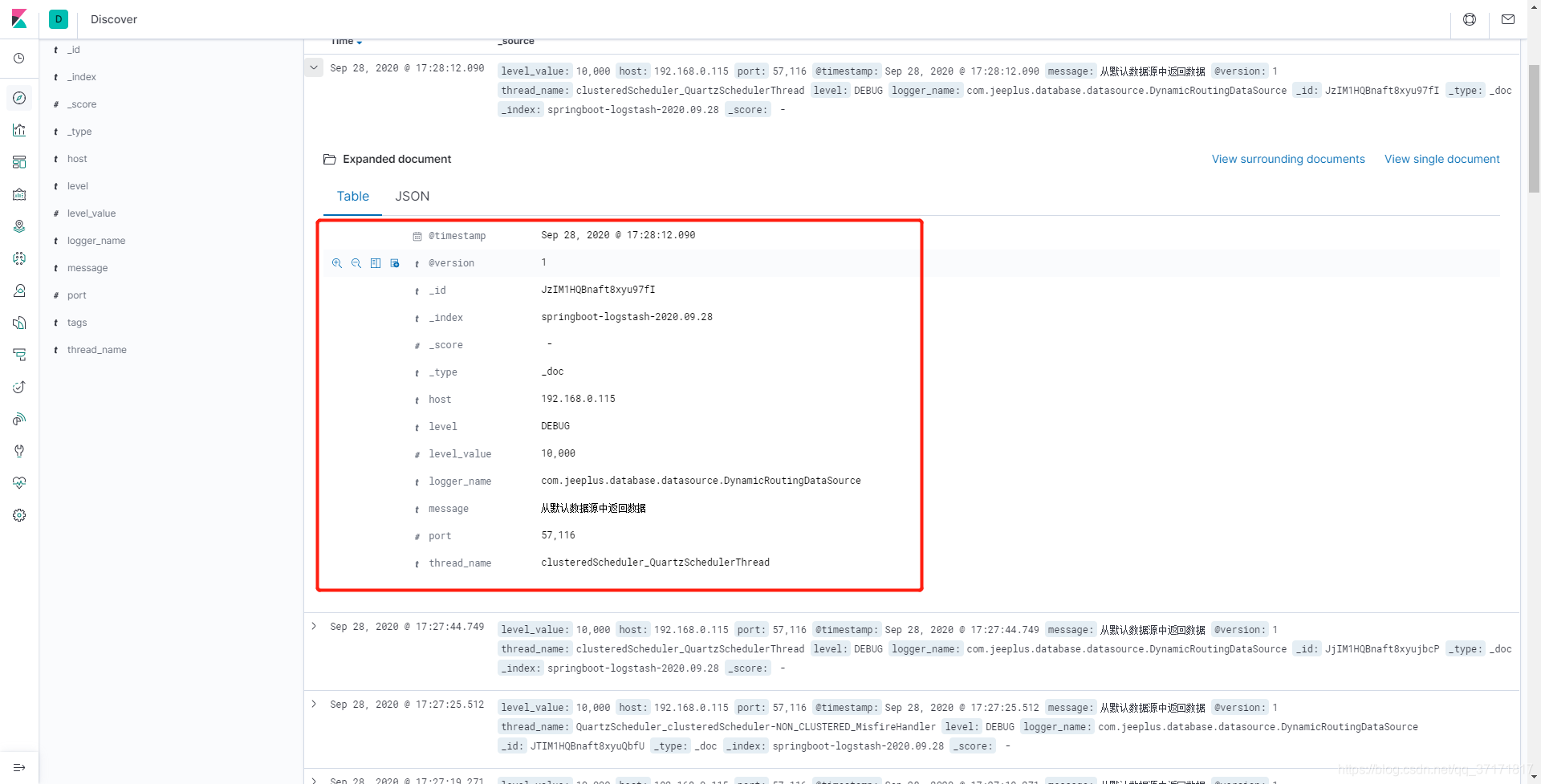

日志详情

三、总结

传统记录日志:

将日志追加到文件中,每天产生的单个日志文件至少500兆,文件太大时不利于从日志中排查错误,也不利于分析等等。

elk:

将日志记录到分布式搜索中间件中,有利于横向扩展,增加吞吐量。且全文检索很好地支持大数据量的检索,高效。