jieba分词特点

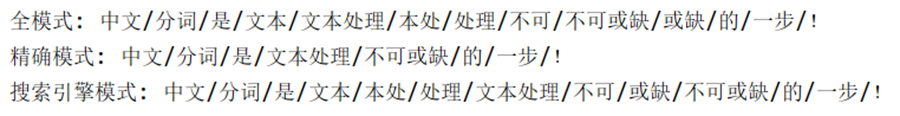

支持四种分词模式:

精确模式

试图将句子最精确地切开,适合文本分析;全模式

把句子中所有的可以成词的词语都扫描出来, 速度非常快,但是不能解决歧义;搜索引擎模式

在精确模式的基础上,对长词再次切分,提高召回率,适合用于搜索引擎分词。paddle模式

利用PaddlePaddle深度学习框架,训练序列标注(双向GRU)网络模型实现分词。同时支持词性标注。

paddle模式使用需安装paddlepaddle-tiny.

jieba分词安装

全自动安装:

pip install jieba (window环境)pip3 install jieba (Linux环境)

半自动安装:

先下载 http://pypi.python.org/pypi/jieba/

解压后运行 python setup.py install

手动安装:

将 jieba 目录放置于当前目录或者 site-packages 目录

通过 import jieba 来引用

如果需要使用paddle模式下的分词和词性标注功能,请先安装paddlepaddle-tiny,pip install paddlepaddle-tiny==1.6.1。

主要功能

分词

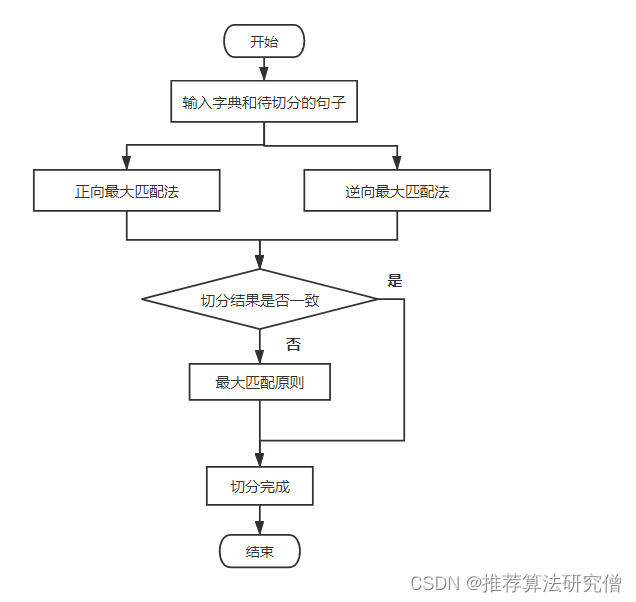

1、基本步骤

初始化初始化时,先加载词典文件dict.txt,遍历每一行,生成词语-词数的键值对和总词数,并将生成结果保存到cache中,下次直接从cache中读取即可。

初始化可以简单理解为,读取词典文件,构建词语-词数键值对,方便后面步骤中查词典,也就是字符串匹配。

切分短语首先进行将语句转换为UTF-8或者GBK。

然后根据用户指定的模式,是否全模式,是否采用HMM隐马尔科夫,来设置cut方式。

然后根据正则,将输入文本分为一个个语句。

最后遍历语句,对每个语句单独进行分词。

看构建DAG的过程。

先遍历一个个切分好的短语,对这些短语来进行分词。

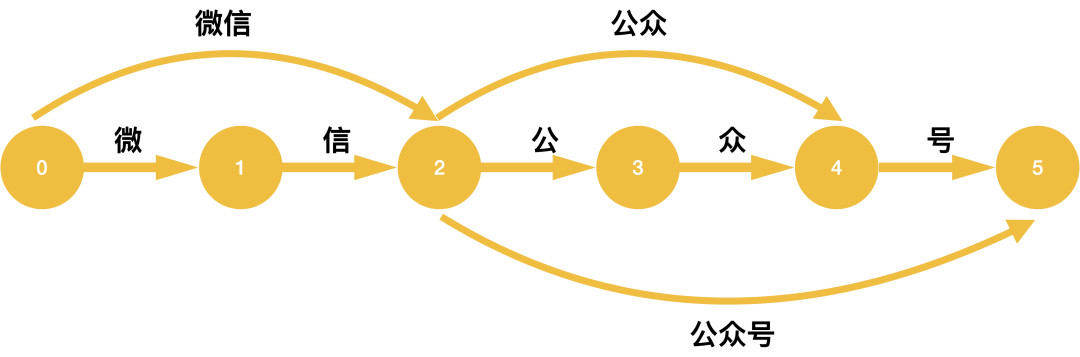

首先要构建短语的有向无环图DAG。查词典进行字符串匹配的过程中,可能会出现好几种可能的切分方式,将这些组合构成有向无环图,如下图所示:

得到语句的有向无环图DAG,DAG中记录了某个词的开始位置和它可能的结束位置。开始位置作为key,结束位置是一个list。

上面语句的完整DAG为:

{ 0: [1, 2], 1: [2], 2: [3, 4, 5], 3: [4], 4: [5] }

比如位置0的DAG表达为 {0: [1, 2]}, 也就是说0位置为词的开始位置时,1, 2位置都有可能是词的结束位置。

动态规划构建Route,计算从语句末尾到语句起始,DAG中每个节点到语句结束位置的最大路径概率,以及概率最大时节点对应词语的结束位置。

def calc(self, sentence, DAG, route):N = len(sentence)route[N] = (0, 0)logtotal = log(self.total)for idx in xrange(N - 1, -1, -1):

# route[idx] = (该汉字到最后一个汉字的最大路径概率, # 最大路径概率时该汉字对应的词语结束位置).

# 遍历DAG中该汉字节点的结束位置,也就是DAG[idx],# 计算idx到x之间构成的词语的概率,然后乘以x到语句结束位置的最大概率,# 即可得到idx到语句结束的路径最大概率.route[idx] = max((log(self.FREQ.get(sentence[idx:x + 1]) or 1) - log(total) + route[x + 1][0], x) for x in DAG[idx])

# 每个词的概率 = 字典中该词的词数 / 字典总词数。

对于上图构建每个节点的最大路径概率的过程如下:

p(5)= 1, p(4)= max(p(5) * p(4->5)),

p(3)= max(p(4) * p(3->4)),

p(2)= max(p(3) * p(2->3), p(4) * p(2->4), p(5) * p(2->5)),

对于节点2,他有2->3, 2->4, 2->4三条路径,我们取概率最大的路径作为节点2的路径概率,并记下概率最大时节点2的结束位置。p(1) = max(p(2) * p(1->2)) p(0) = max(p(1) * p(0->1), p(2) * p(0->2))

遍历每个节点的Route,组装词语组合。

如果词语不在字典中,也就是新词,使用HMM隐马尔科夫模型进行分割。

通过yield将词语逐个返回。

2、基本方法

待分词的字符串可以是 unicode 或 UTF-8 字符串、GBK 字符串。注意:不建议直接输入 GBK 字符串,可能无法预料地错误解码成 UTF-8。

jieba.cut(sentence, cut_all=False, HMM=True, use_paddle=False)

sentence: 需要分词的字符串

cut_all: 用来控制是否采用全模式

HMM: 用来控制是否使用 HMM 模型

use_paddle: 用来控制是否使用paddle模式下的分词模式,paddle模式采用延迟加载方式,通过enable_paddle接口

jieba.cut_for_search(sentence, HMM=True)

该方法适合用于搜索引擎构建倒排索引的分词,粒度比较细。

sentence: 分词的字符串

HMM: 使用 HMM 模型

jieba.cut 以及 jieba.cut_for_search 返回的结构都是一个可迭代的 generator,可以使用 for 循环来获得分词后得到的每一个词语(unicode)

jieba.lcut 以及 jieba.lcut_for_search 直接返回 list

jieba.Tokenizer(dictionary=DEFAULT_DICT) 新建自定义分词器,可用于同时使用不同词典。jieba.dt 为默认分词器,所有全局分词相关函数都是该分词器的映射。

代码示例:

# encoding=utf-8

import jiebajieba.enable_paddle()# 启动paddle模式。

strs=["我关注了数据STUDIO","我是数据分析师","四川大学"]

for str in strs:seg_list = jieba.cut(str,use_paddle=True) # 使用paddle模式print("Paddle Mode: " + '/'.join(list(seg_list)))seg_list = jieba.cut("我毕业于四川大学,我关注了数据STUDIO", cut_all=True)

print("Full Mode: " + "/ ".join(seg_list)) # 全模式seg_list = jieba.cut("我毕业于四川大学,我关注了数据STUDIO", cut_all=False)

print("Default Mode: " + "/ ".join(seg_list)) # 精确模式seg_list = jieba.cut("他来到了网易杭研大厦") # 默认是精确模式

print(", ".join(seg_list))seg_list = jieba.cut_for_search("我是云朵君,我关注了数据STUDIO") # 搜索引擎模式

print(", ".join(seg_list))

Paddle enabled successfully......

Paddle Mode: 我/关注/了/数据/STUDIO

Paddle Mode: 我/是/数据/分析师

Paddle Mode: 四川大学

Full Mode: 我/ 毕业/ 于/ 四川/ 四川大学/ 大学/ ,/ 我/ 关注/ 了/ 数据/ STUDIO

Default Mode: 我/ 毕业/ 于/ 四川大学/ ,/ 我/ 关注/ 了/ 数据/ STUDIO

他, 来到, 了, 网易, 杭研, 大厦

我, 是, 云朵, 君, ,, 我, 关注, 了, 数据, STUDIO

添加自定义词典

1、原始词典

词典是基于字符串匹配的分词算法的关键所在,决定了最终分词的准确度。jieba词典dict.txt是jieba作者采集了超大规模的语料数据,统计得到的。有5M,包含349,046条词语。每一行对应一个词语,包含词语 词数 词性三部分。

2、载入词典

开发者可以指定自己自定义的词典,以便包含 jieba 词库里没有的词。虽然 jieba 有新词识别能力,但是自行添加新词可以保证更高的正确率。

jieba.load_userdict(file_name)

词典格式和 dict.txt 一样,一个词占一行;每一行分三部分:词语、词频(可省略)、词性(可省略),用空格隔开,顺序不可颠倒。

file_name 为文件类对象或自定义词典的路径,若为路径或二进制方式打开的文件,则文件必须为 UTF-8 编码。

词频省略时使用自动计算的能保证分出该词的词频。

例如:

创新办 3 i

云计算 5

凱特琳 nz

台中

更改分词器(默认为 jieba.dt)的 tmp_dir 和 cache_file 属性,可分别指定缓存文件所在的文件夹及其文件名,用于受限的文件系统。

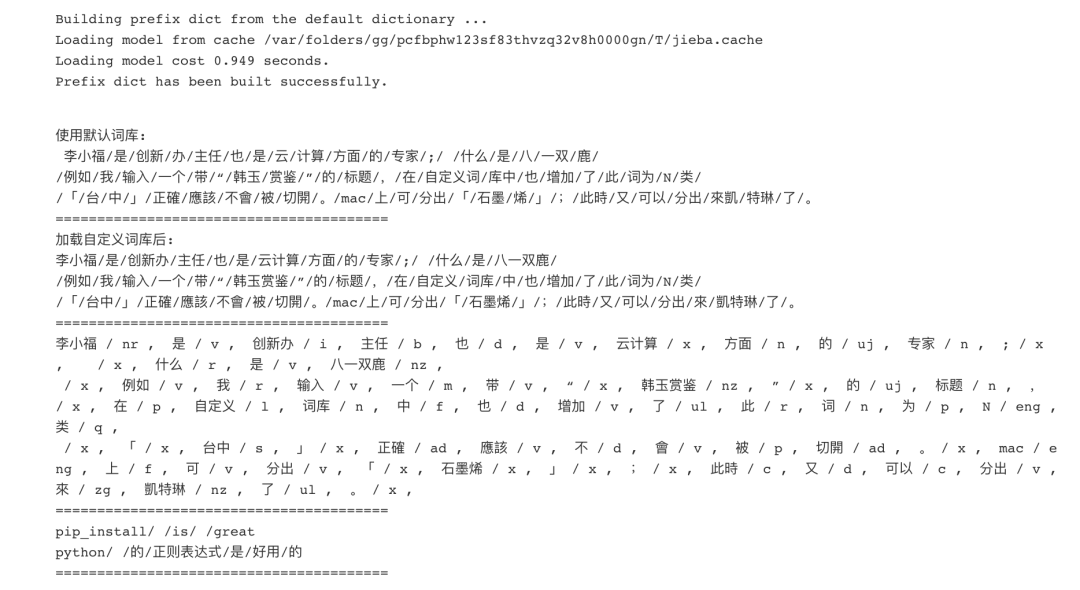

代码示例:

#encoding=utf-8

import sys

sys.path.append("../")

import jieba

import jieba.posseg as psegtest_sent = (

"李小福是创新办主任也是云计算方面的专家; 什么是八一双鹿\n"

"例如我输入一个带“韩玉赏鉴”的标题,在自定义词库中也增加了此词为N类\n"

"「台中」正確應該不會被切開。mac上可分出「石墨烯」;此時又可以分出來凱特琳了。"

)

words = jieba.cut(test_sent)

print("使用默认词库:\n {}".format('/'.join(words)))

print("="*40)jieba.load_userdict("userdict.txt")

"""

userdict.txt

云计算 5

李小福 2 nr

创新办 3 i

pip_install 3 eng

好用 300

韩玉赏鉴 3 nz

八一双鹿 3 nz

台中

凱特琳 nz

Edu Trust认证 2000

"""

jieba.add_word('石墨烯')

jieba.add_word('凱特琳')

jieba.del_word('自定义词')words = jieba.cut(test_sent)

print("加载自定义词库后: \n{}".format('/'.join(words)))

print("="*40)# 带有词性的分词

result = pseg.cut(test_sent)for w in result:print(w.word, "/", w.flag, ", ", end=' ')

print("\n" + "="*40)terms = jieba.cut('pip_install is great')

print('/'.join(terms))

terms = jieba.cut('python 的正则表达式是好用的')

print('/'.join(terms))

print("="*40)

使用默认词库::

李小福 / 是 / 创新 / 办 / 主任 / 也 / 是 / 云 / 计算 / 方面 / 的 / 专家 /加载自定义词库后:

李小福 / 是 / 创新办 / 主任 / 也 / 是 / 云计算 / 方面 / 的 / 专家 /

3、调整词典

使用 add_word(word, freq=None, tag=None) 和 del_word(word) 可在程序中动态修改词典。

使用 get_FREQ(word) 用来统计当前词的词频。

使用 suggest_freq(segment, tune=True) 可调节单个词语的词频,使其能(或不能)被分出来。

注意:自动计算的词频在使用 HMM 新词发现功能时可能无效。

代码示例:

# test frequency tune

testlist = [

('今天天气不错', ('今天', '天气')),

('如果放到post中将出错。', ('中', '将')),

('我们中出了一个叛徒', ('中', '出')),

]for sent, seg in testlist:print('/'.join(jieba.cut(sent, HMM=False)))word = ''.join(seg)print('%s Before: %s, After: %s' % (word, jieba.get_FREQ(word), jieba.suggest_freq(seg, True)))print('/'.join(jieba.cut(sent, HMM=False)))print("-"*40)

今天天气/不错

今天天气 Before: 3, After: 0

今天/天气/不错如果/放到/post/中将/出错/

中将 Before: 763, After: 494

如果/放到/post/中/将/出错/。我们/中/出/了/一个/叛徒

中出 Before: 3, After: 3

我们/中/出/了/一个/叛徒

通过用户自定义词典来增强歧义纠错能力[2]

参考资料

[1]

jieba分词: https://github.com/fxsjy/jieba

[2]用户自定义词典: https://github.com/fxsjy/jieba/issues/14

-- 数据STUDIO --