花卉识别–五个类别的检测

文章目录

- 花卉识别--五个类别的检测

- 一、数据集的观察与查看

- 二、将数据集分为data_train(训练集)和data_test(测试集)

- 三、明确网络流程、建立网络结构

- 四、定义损失函数、学习率、是否使用正则化

- 五、存储模型、已经调用现有的训练好的模型进行测试

- 六、画roc曲线、pr曲线等,评判效果

- 七、制作QT界面

- 八、PPT的制作

- 九、参考地址

- 欢迎大家关注集大人工智能,让我们一起交流讨论

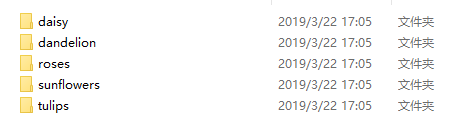

一、数据集的观察与查看

一个五个类别,每个

在这里插入图片描述

在这里插入图片描述

在这里插入图片描述

每个类别大概有650张图片,则将每个图片对应的文件夹按照七三或者八二分成训练集合测试集

注意对于,每张图片的大小都是不同的,所以要先对图片的尺寸进行**resize(),**使得每张图片的大小都一样

对于数据的扩展,可以将图片进行旋转、图片亮度的调节、图片模糊处理等,这样的可以使得你在测试的时候不管你属于的图片质量怎么样,你都能够正确识别出图片的内容

二、将数据集分为data_train(训练集)和data_test(测试集)

#path 图片文件夹的路径

def read_img(path):cate=[path+x for x in os.listdir(path) if os.path.isdir(path+x)]imgs=[]labels=[]for idx,folder in enumerate(cate):for im in glob.glob(folder+'/*.jpg'):print('reading the images:%s'%(im))img=io.imread(im)img=transform.resize(img,(w,h))imgs.append(img)labels.append(idx)return np.asarray(imgs,np.float32),np.asarray(labels,np.int32)

data,label=read_img(path)#打乱顺序

#将图片的保存的顺序打乱

num_example=data.shape[0]

arr=np.arange(num_example)

np.random.shuffle(arr)

data=data[arr]

label=label[arr]#这里将文件八二分,对文件进行处理

#将所有数据分为训练集和验证集

ratio=0.8

s=np.int(num_example*ratio)

x_train=data[:s]

y_train=label[:s]

x_val=data[s:]

y_val=label[s:]缺点:

-

上述代码并没有图片保存到我们自己建立的数据集中,只是存放在内存中也就是说我们每次运行程序都需要重新制作我们的数据集,这样非常的耗费时间,但是如果我们将我们的数据集存到一个文件当中,我们每次直接读取文件就可以,无需再重新设置标签、打乱顺序等繁琐操作。我们直接可以从文件中读取到一个矩阵

-

我们在制作数据集的时候,很少会将图片和标签进行分开的储存,通常我们会直接保存在一个data_train、data_test。我们将数据的标签和特征储存在一个列表当中,并不分开储存

[ [[img1],lable1] [[img2],lable2] [[img3],lable3] [[img4],lable4] [[img5],lable5] [[img6],lable6] ]

三、明确网络流程、建立网络结构

我们推荐的参考链接的代码流程

则这个网络基本上就是整个网络的流程,但在代码中,有一些对数据进行非线性激活函数activation function、正则化(BN)等操作并没有列在上面,在大家答辩的时候,最好要弄懂每一步的维度变化

#占位符

x=tf.placeholder(tf.float32,shape=[None,w,h,c],name='x')

y_=tf.placeholder(tf.int32,shape=[None,],name='y_')def inference(input_tensor, train, regularizer):with tf.variable_scope('layer1-conv1'):#-----卷积核kernel的权重的初始化----------conv1_weights = tf.get_variable("weight",[5,5,3,32],initializer=tf.truncated_normal_initializer(stddev=0.1))#-------偏置项的初始化-----------------------conv1_biases = tf.get_variable("bias", [32], initializer=tf.constant_initializer(0.0))#----------卷积函数-----------------------conv1 = tf.nn.conv2d(input_tensor, conv1_weights, strides=[1, 1, 1, 1], padding='SAME')#-------------------激活函数----------------relu1 = tf.nn.relu(tf.nn.bias_add(conv1, conv1_biases)) with tf.name_scope("layer2-pool1"):#--------------------池化函数----------------pool1 = tf.nn.max_pool(relu1, ksize = [1,2,2,1],strides=[1,2,2,1],padding="VALID")#-------------------------------第一层卷积和池化结束-------------------------

#-------------------------------第二层卷积池化开始------------------------with tf.variable_scope("layer3-conv2"):conv2_weights = tf.get_variable("weight",[5,5,32,64],initializer=tf.truncated_normal_initializer(stddev=0.1))conv2_biases = tf.get_variable("bias", [64], initializer=tf.constant_initializer(0.0))conv2 = tf.nn.conv2d(pool1, conv2_weights, strides=[1, 1, 1, 1], padding='SAME')relu2 = tf.nn.relu(tf.nn.bias_add(conv2, conv2_biases))with tf.name_scope("layer4-pool2"):pool2 = tf.nn.max_pool(relu2, ksize=[1, 2, 2, 1], strides=[1, 2, 2, 1], padding='VALID')with tf.variable_scope("layer5-conv3"):conv3_weights = tf.get_variable("weight",[3,3,64,128],initializer=tf.truncated_normal_initializer(stddev=0.1))conv3_biases = tf.get_variable("bias", [128], initializer=tf.constant_initializer(0.0))conv3 = tf.nn.conv2d(pool2, conv3_weights, strides=[1, 1, 1, 1], padding='SAME')relu3 = tf.nn.relu(tf.nn.bias_add(conv3, conv3_biases))with tf.name_scope("layer6-pool3"):pool3 = tf.nn.max_pool(relu3, ksize=[1, 2, 2, 1], strides=[1, 2, 2, 1], padding='VALID')with tf.variable_scope("layer7-conv4"):conv4_weights = tf.get_variable("weight",[3,3,128,128],initializer=tf.truncated_normal_initializer(stddev=0.1))conv4_biases = tf.get_variable("bias", [128], initializer=tf.constant_initializer(0.0))conv4 = tf.nn.conv2d(pool3, conv4_weights, strides=[1, 1, 1, 1], padding='SAME')relu4 = tf.nn.relu(tf.nn.bias_add(conv4, conv4_biases))with tf.name_scope("layer8-pool4"):pool4 = tf.nn.max_pool(relu4, ksize=[1, 2, 2, 1], strides=[1, 2, 2, 1], padding='VALID')nodes = 6*6*128reshaped = tf.reshape(pool4,[-1,nodes])

#=================================卷积层到此全部结束=====================-====== with tf.variable_scope('layer9-fc1'):#----------------------------初始化全连接层权重----------------fc1_weights = tf.get_variable("weight", [nodes, 1024],initializer=tf.truncated_normal_initializer(stddev=0.1))#-------------------------是否使用正则化------------------- if regularizer != None: tf.add_to_collection('losses', regularizer(fc1_weights))#----------------------全连接层偏置项的设置------------------fc1_biases = tf.get_variable("bias", [1024], initializer=tf.constant_initializer(0.1))#--------------------全连接层实现加上激活函数-------------------fc1 = tf.nn.relu(tf.matmul(reshaped, fc1_weights) + fc1_biases)#--------------------是否使用dropout防止过度拟合--------------if train: fc1 = tf.nn.dropout(fc1, 0.5)with tf.variable_scope('layer10-fc2'):fc2_weights = tf.get_variable("weight", [1024, 512],initializer=tf.truncated_normal_initializer(stddev=0.1))if regularizer != None: tf.add_to_collection('losses', regularizer(fc2_weights))fc2_biases = tf.get_variable("bias", [512], initializer=tf.constant_initializer(0.1))fc2 = tf.nn.relu(tf.matmul(fc1, fc2_weights) + fc2_biases)if train: fc2 = tf.nn.dropout(fc2, 0.5)with tf.variable_scope('layer11-fc3'):fc3_weights = tf.get_variable("weight", [512, 5],initializer=tf.truncated_normal_initializer(stddev=0.1))if regularizer != None: tf.add_to_collection('losses', regularizer(fc3_weights))fc3_biases = tf.get_variable("bias", [5], initializer=tf.constant_initializer(0.1))logit = tf.matmul(fc2, fc3_weights) + fc3_biasesreturn logit#---------------------------网络结束---------------------------

以上是一个很简单的卷积神经网络、网络的层数不多。

大家可以百度一些常见的网络的流程,比如VGG、Lenet等网络。但注意网络的深度不宜过深,不然大家的电脑跑不动,就算勉强跑动,但是banch_size会变的很小,这样对准确率提升会有害

四、定义损失函数、学习率、是否使用正则化

#----------------------正则化的定义---------------------------------

regularizer = tf.contrib.layers.l2_regularizer(0.0001)

#-------------------这个函数就是我们上一步自定义的网络结构的函数-------------

logits = inference(x,False,regularizer)#(小处理)将logits乘以1赋值给logits_eval,定义name,方便在后续调用模型时通过tensor名字调用输出tensor

b = tf.constant(value=1,dtype=tf.float32)

logits_eval = tf.multiply(logits,b,name='logits_eval')

#--------------------------------损失函数的定义-------------------------

loss=tf.nn.sparse_softmax_cross_entropy_with_logits(logits=logits, labels=y_)

#--------------------------------权重的优化函数---反向传播用到----------------

train_op=tf.train.AdamOptimizer(learning_rate=0.001).minimize(loss)

#------------------------------准确率计算-------------------------

correct_prediction = tf.equal(tf.cast(tf.argmax(logits,1),tf.int32), y_)

acc= tf.reduce_mean(tf.cast(correct_prediction, tf.float32))#定义一个函数,按批次取数据

def minibatches(inputs=None, targets=None, batch_size=None, shuffle=False):assert len(inputs) == len(targets)if shuffle:indices = np.arange(len(inputs))np.random.shuffle(indices)for start_idx in range(0, len(inputs) - batch_size + 1, batch_size):if shuffle:excerpt = indices[start_idx:start_idx + batch_size]else:excerpt = slice(start_idx, start_idx + batch_size)yield inputs[excerpt], targets[excerpt]#训练和测试数据,可将n_epoch设置更大一些

n_epoch=10#迭代的次数

batch_size=64

#---------------模型的建立和保存-----------------

saver=tf.train.Saver()

sess=tf.Session()

sess.run(tf.global_variables_initializer())

for epoch in range(n_epoch):start_time = time.time()#trainingtrain_loss, train_acc, n_batch = 0, 0, 0for x_train_a, y_train_a in minibatches(x_train, y_train, batch_size, shuffle=True):_,err,ac=sess.run([train_op,loss,acc], feed_dict={x: x_train_a, y_: y_train_a})train_loss += err; train_acc += ac; n_batch += 1print(" train loss: %f" % (np.sum(train_loss)/ n_batch))print(" train acc: %f" % (np.sum(train_acc)/ n_batch))#validationval_loss, val_acc, n_batch = 0, 0, 0for x_val_a, y_val_a in minibatches(x_val, y_val, batch_size, shuffle=False):err, ac = sess.run([loss,acc], feed_dict={x: x_val_a, y_: y_val_a})val_loss += err; val_acc += ac; n_batch += 1print(" validation loss: %f" % (np.sum(val_loss)/ n_batch))print(" validation acc: %f" % (np.sum(val_acc)/ n_batch))

#---------------------model_path:模型储存的地址--------------------------

saver.save(sess,model_path)

sess.close()

大家看完代码后,要明确损失函数是什么、学习率、正则化这些都是什么,这些大家在进行最后一轮的答辩都会用的到。我们放到群里的书上都有详细介绍,百度的介绍则更加全面

五、存储模型、已经调用现有的训练好的模型进行测试

上面我们已经训练好了模型,并将模型已经储存起来了,以下的是测试的例子:

from skimage import io,transform

import tensorflow as tf

import numpy as np

#------------------------五张要查看的图片保存的路径-----------------

path1 = "E:/data/datasets/flower_photos/daisy/5547758_eea9edfd54_n.jpg"

path2 = "E:/data/datasets/flower_photos/dandelion/7355522_b66e5d3078_m.jpg"

path3 = "E:/data/datasets/flower_photos/roses/394990940_7af082cf8d_n.jpg"

path4 = "E:/data/datasets/flower_photos/sunflowers/6953297_8576bf4ea3.jpg"

path5 = "E:/data/datasets/flower_photos/tulips/10791227_7168491604.jpg"

#----------------------标签对应的花是什么----------------------------

flower_dict = {0:'dasiy',1:'dandelion',2:'roses',3:'sunflowers',4:'tulips'}w=100

h=100

c=3

#-----------------------读取图片的函数----------------------

def read_one_image(path):img = io.imread(path)img = transform.resize(img,(w,h))return np.asarray(img)with tf.Session() as sess:data = []data1 = read_one_image(path1)data2 = read_one_image(path2)data3 = read_one_image(path3)data4 = read_one_image(path4)data5 = read_one_image(path5)data.append(data1)data.append(data2)data.append(data3)data.append(data4)data.append(data5)#------------------取出我们已经训练好的模型------------------------saver = tf.train.import_meta_graph('E:/data/model/flower/model.ckpt.meta')saver.restore(sess,tf.train.latest_checkpoint('E:/data/model/flower/'))#---------------------喂入我们要测试的图片------------------graph = tf.get_default_graph()x = graph.get_tensor_by_name("x:0")feed_dict = {x:data}logits = graph.get_tensor_by_name("logits_eval:0")classification_result = sess.run(logits,feed_dict)#打印出预测矩阵print(classification_result)#打印出预测矩阵每一行最大值的索引print(tf.argmax(classification_result,1).eval())#根据索引通过字典对应花的分类output = []output = tf.argmax(classification_result,1).eval()for i in range(len(output)):print("第",i+1,"朵花预测:"+flower_dict[output[i]])

这里的输入就是到时候大家要做的界面的接口、输出则是对应的输出这朵花是什么

同时,我们当输入的不是一朵花的时候,要告诉我们这可能不是五朵花中的一种

六、画roc曲线、pr曲线等,评判效果

pr曲线参考链接

[https://www.cnblogs.com/dlml/p/4403482.html roc的参考链接

七、制作QT界面

我们希望大家的结果是以图形界面展示给我们看的,只要大家能做出界面,至于是那种语言的界面我们并不关心,我们只在乎的是这个的结果

下面这个就是最基本的界面,当你按输入图片的按钮时,我们希望我们至少可以从电脑的文件目录中任意选择一张图片作为输入

八、PPT的制作

每一页必须有一张图片,尽量用英文,用一些专业的术语。我们不需要花里胡哨的PPT,我们希望看到的是一个图文并茂的PPT

九、参考地址

[[https://blog.csdn.net/qq_25987491/article/details/80889446]]代码地址

[http://download.tensorflow.org/example_images/flower_photos.tgz]: 数据集的地址

欢迎大家关注集大人工智能,让我们一起交流讨论