总第179篇/张俊红

这一篇我们讲讲统计中的最小样本量计算。大家先想想为什么叫最小样本量,而不是最大或者直接叫样本量计算呢?

这是因为最小样本量这个概念主要用在抽样统计中,抽样统计为了研究某一事物的情况而从整体中抽取部分样本来进行研究,并用抽取的样本来代替整体的情况。比如要研究中学生的平均身高,你不太可能把全国的中学生身高都量一遍,然后求出一个平均值。比较简单的方法就是从全国中学生群体中抽取一部分,然后用这一部分同学的平均身高代替全国中学生的平均身高。

既然是用抽样样本的平均身高代替整体的平均身高,我们就需要考虑一个问题,就是抽出来的样本能不能代表整体。假设全国有1000万名中学生,你只抽了100个同学,想用这100位同学的平均身高代替这1000万同学的平均身高,很明显是不太合理的。那我们应该最少抽取多少样本才能够代表整体呢?这个最少抽取样本就是最小样本量,表示最少需要这么多样本量,当然也可以比这多,抽样样本越多结果越具有代表性。但是由于现实中尽可能多的样本很难获取,又为了保证抽样结果足够具有代表性,所以我们一般选择最小样本量。那这个最小样本量怎么确定呢?就是我们这一篇重点要讲的内容。

在讲最小样本量之前,我们先讲一下另一个概念,统计功效,即power值。这个在之前的文章中也提过,我们再提一下。

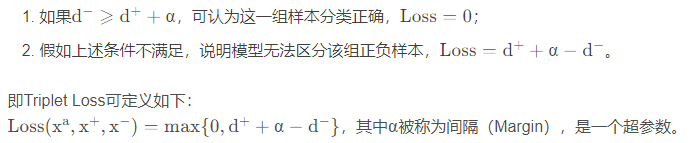

在假设检验中如果计算出来的P值小于等于显著性水平α,则拒绝零假设,否则接受原假设。在这个决策的过程中容易犯两种错误:第一类错误(I型错误)叫做弃真错误,通俗一点就是漏诊,就是本来是生病了(假设是正确的),但是你没有检测出来,所以给拒绝掉了;第二类错误(II型错误)是取伪错误,通俗一点就是误诊,就是本来没病(假设是错误的),结果你诊断说生病了(假设是正确的),所以就把假设给接受了。

| 最终判断 | H0本来正确 | H0本来错误 |

|---|---|---|

| 拒绝H0假设 | 犯I型错误 | 正确 |

| 接受H0假设 | 正确 | 犯II错误 |

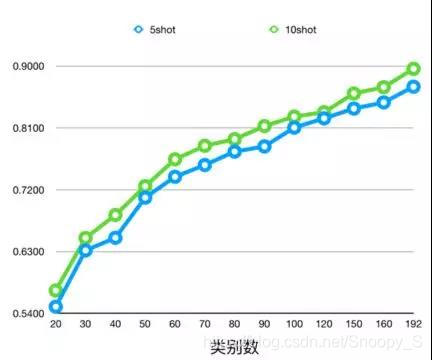

下图中左边的分布图为H0对应的分布,右边的分布图为H1对应的分布,α为一型错误值,β为二型错误值。I型错误的值一般为0.05,II型错误的值一般为0.1或0.2,而power = 1 - β,表示H1分布下判断正确的把握是多少,即你有多大把握能够正确的拒绝掉H0假设。

(图片来源知乎@邱宗满)

上图中H1分布下对应的整体面积减去图中紫色部分的面积就是power的大小,具体计算公式如下:

Φ表示求z值对应的累计概率,即正态分布中的面积,Δ是两组样本均值之差, σ为各组样本标准差,n为样本数。

在一般AB实验中,我们假设AB两组是同质的,且样本量是一致的,所以有σ1 = σ2,n1 = n2,将上面的power公式进行转换最后可以得到如下关于样本量公式:

需要注意的是不同检验满足的分布是不一样的,对应的power公式也是不一样,而最小样本量公式也是从power来的,所以不同检验方式对应的最小样本量公式也是不一样的。我们本篇是以满足正态分布的Z检验为例。

你还可以看:

聊聊置信度与置信区间

统计学的假设检验