如何看待ChatGPT

如何看待ChatGPT,语言学家乔姆斯基说,这是一个抄袭的机器。

欺骗性机器

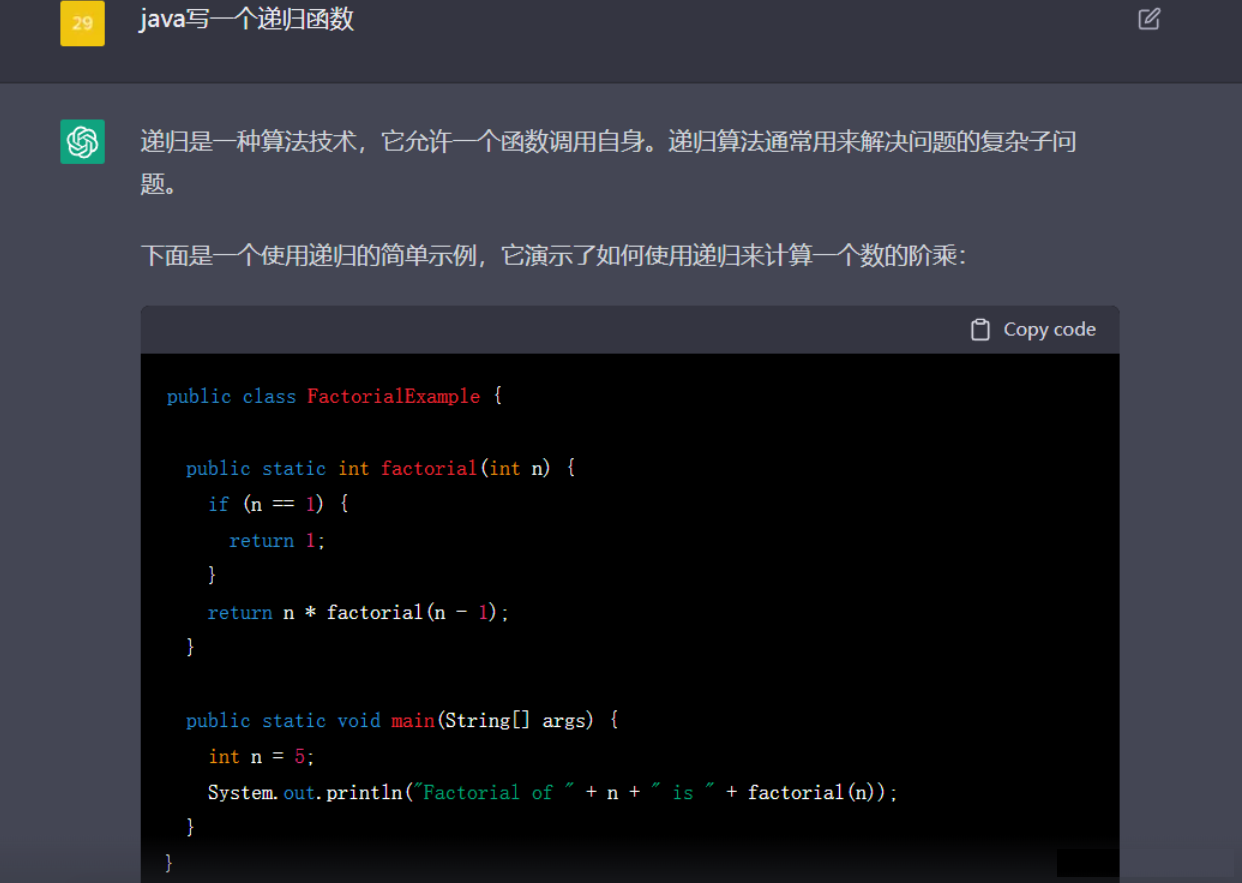

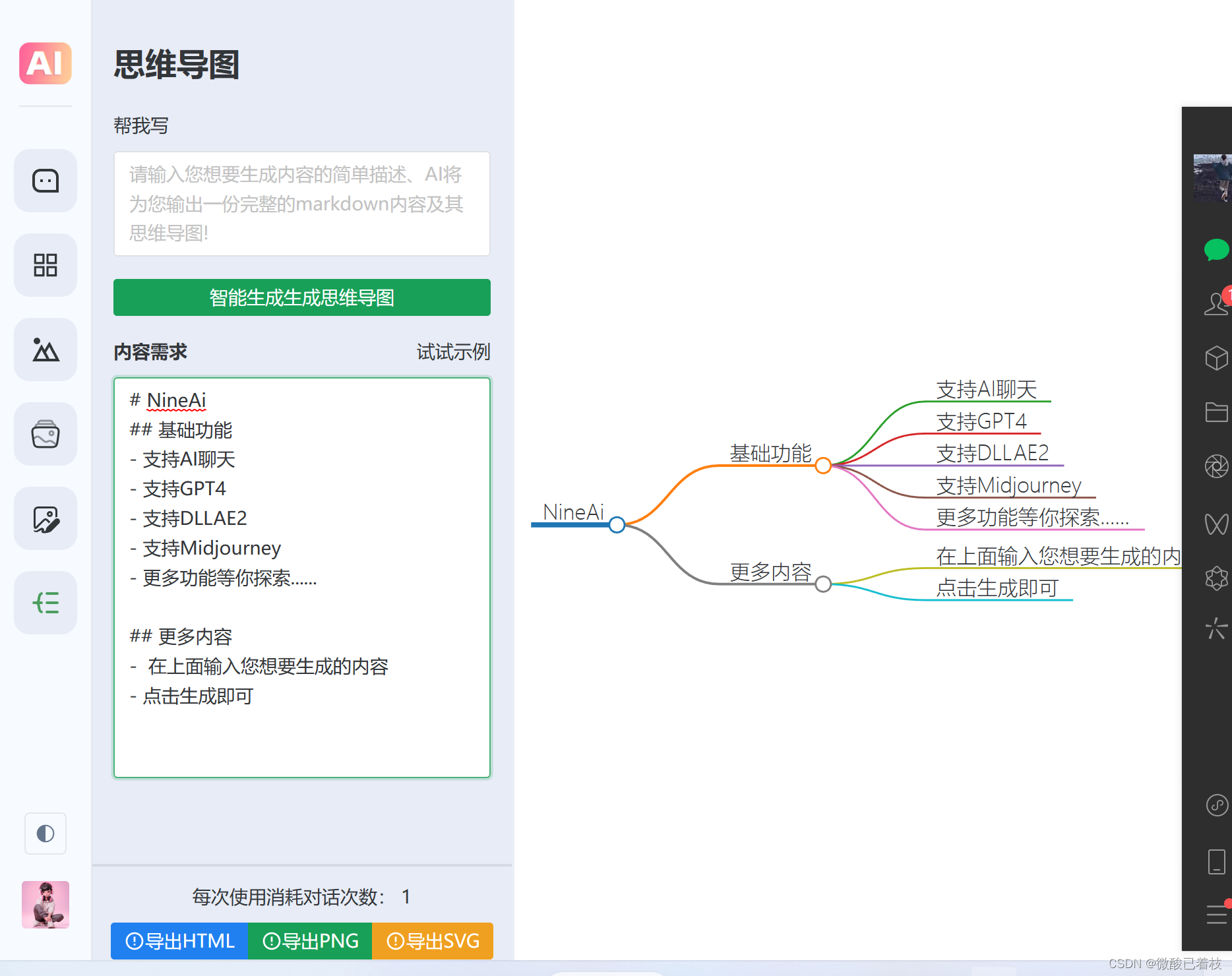

ChatGPT使用大量文本数据进行训练,然后以一种令人信服的修饰语句展现,这使得它和人的互动能力更加契合,但是仍然不是一个充满创造力的智能机器。

如果这种欺骗性的观点使人轻易信服,那么,世界将会被蒙蔽在一些谎言中。

记住,真理和创造力掌握在少数人手中,很难不考虑到ChatGPT对人类创作力的扼杀。

提高机械化工作的效率,但是也容易扼杀创造力

不可否认,ChatGPT提高了一些人的工作效率。记住一项技术永远是中性的,不带有邪恶和善良之分,但是应用者很难不会被诱惑,使用ChatGPT追求短平快的创作。人类的创造力是缓慢的,需要时间积累,而你的老板却只追求速度和效益。

最终人类的信息空间被垃圾所填充,人类在浩瀚的信息垃圾中找不到本应该属于生物理性的归属感,到处充斥着由机器创造的相同垃圾信息,此时反而增加了信息的处理成本。

意识形态危机和政治欺骗

除此以外,还存在一个重要的问题,那就是政治观点更中庸,更具有欺骗性。

人类世界如此花里胡哨的观点和价值观念,最终被机器处理成千篇一律的观点。举个简单的例子,当ChatGPT采用西方社会的互联网文本观点进行训练时,这就是对非英文地区文化和价值观的抹杀。

这就导致西方更愿意采用欺骗性的观点发动战争,实施意识形态对抗。东西方价值观冲突是十分明显的,利用西方意识形态训练的机器对于我们是危机,特别是我国国际媒体话语能力竞争能力弱,机器很容易篡改本应该属于人类的观点,或者在浩瀚的信息中完全忽视少数人的存在。

机器追随于大众,而不是理性

大众往往对某件事依据于自己的认知作出评价,而这些评价最终会被用于训练机器。

显然,大众的情绪并不是完全理性的,不会基于某种推导或者深度知识给与理性的文本。所以,这部分数据将是错误引导的。

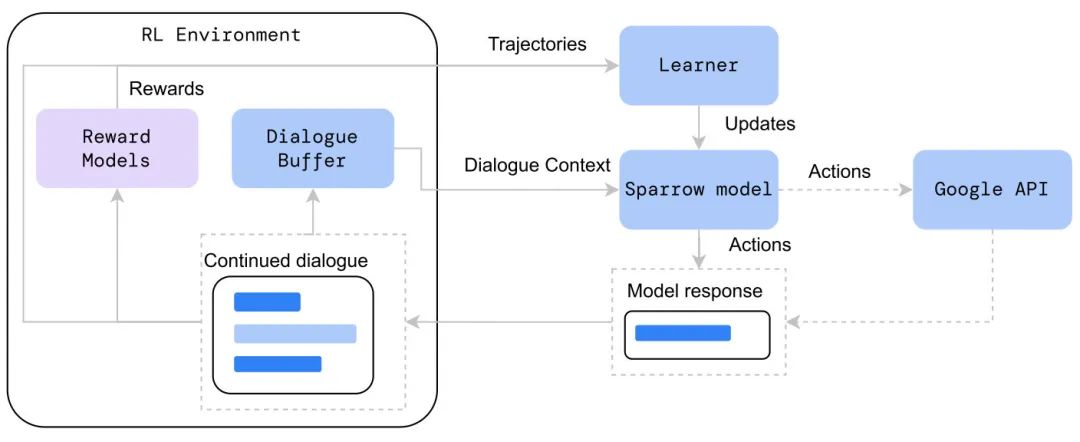

这一点在ChatGPT开发中被设计人员所考虑,解决方案是设计一个数据库,包含着各种诸如暴力等的信息,通过算法惩罚保证ChatGPT不会被这种负面信息所污染。

但是,负面信息数据库不是万能的,毕竟是机器,总会被大众微弱放的情绪所感染。

未来最宝贵的是理性判断力

学会审视、保持学习和清醒的认知