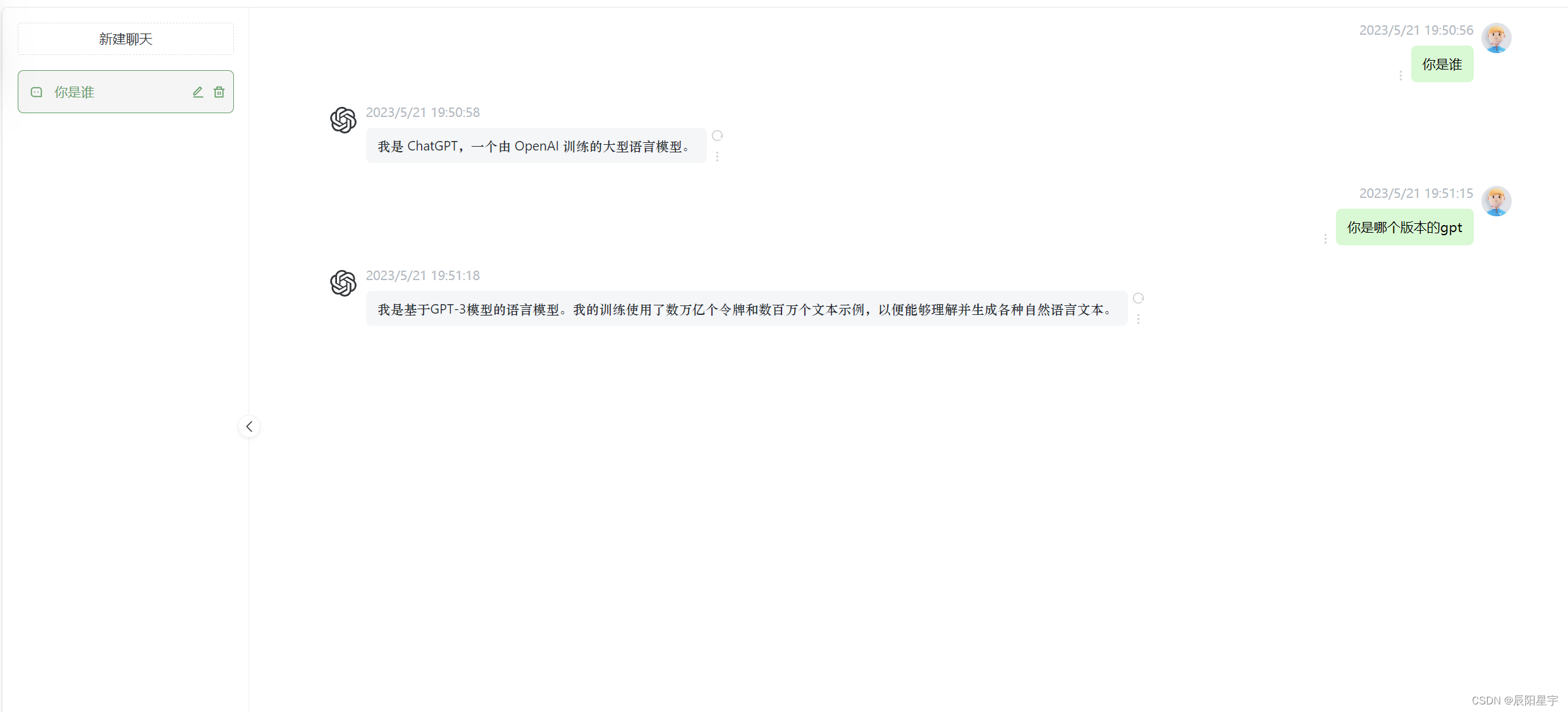

ChatGPT是一个基于Transformer模型的开源聊天机器人框架,其核心为GPT-2模型,支持自定义语料训练,并可通过API接口方便地进行在线使用。本文将通过一个简单的示例,介绍如何使用ChatGPT进行应用实战。

环境配置

在开始使用ChatGPT之前,需要确保已安装Python 3环境,并且安装了相关依赖包。可以通过以下命令安装:

pip install torch transformers flask

其中,torch和transformers是ChatGPT的核心依赖包,flask是一个Python的Web框架,用于实现API接口。

模型训练

首先,我们需要准备用于训练的语料,这里以《红楼梦》为例。可以使用一些现成的中文文本处理工具将其处理成一行一行的句子,并保存到一个文本文件中,如下所示:

由此又提起宝玉自幼时学识渊博,标致高雅,慧根聪颖,依然日进。尤其精通诗词文辞、绘画琴棋书画,一度被先皇嘉许,命为质选之君,未几乃不悦,召还园林,细心编制“石头记”。阿凤自觉她们前途未卜,也留了几句话,拿着银灯照一照毕见其数。只见凤姐也摸着宝玉,道:“我先问问他。”黛玉低声哭道:“我死了还不放心呢!你们竟要顺着他!”这句话说出来,众人方知~黛玉心中有血海深仇。仿佛宝玉所言,也得他的一份情,遂都拍手赞助。

然后,我们使用以下代码进行模型训练:

from chatgpt import ChatGPT# 创建ChatGPT对象

chatbot = ChatGPT()# 读取语料文件

with open('hongloumeng.txt', 'r', encoding='utf-8') as f:corpus = f.read()# 开始训练模型

chatbot.train(corpus=corpus, max_tokens=1024, num_epochs=2)

在训练过程中,ChatGPT会自动进行分词、编码、训练等一系列过程,用时可能较长。训练完成后,ChatGPT会自动保存训练好的模型,可以供后续代码使用。

模型测试

训练完成后,我们可以使用以下代码进行模型测试:

from chatgpt import ChatGPT# 创建ChatGPT对象

chatbot = ChatGPT()# 加载训练好的模型

chatbot.load_model()# 进行模型测试

response = chatbot.chat('这本书怎么样?')

print(response)

其中,chat方法用于输入一个问题,返回机器人回答的结果。执行代码后,ChatGPT会根据输入的问题进行处理,并输出机器人的回答。输出结果如下:

它很有趣味性,推荐阅读。

可以看到,在经过语料训练后,ChatGPT已经可以较好地理解中文,生成出了一条相对较为合理的回答。

在线API接口

除了本地测试外,ChatGPT还可通过API接口进行在线应用。以下为一个使用Flask框架实现的API接口代码:

from chatgpt import ChatGPT

from flask import Flask, request, jsonify# 创建ChatGPT对象

chatbot = ChatGPT()# 加载训练好的模型

chatbot.load_model()# 创建 flask 应用实例

app = Flask(__name__)# API接口

@app.route('/chat', methods=['POST'])

def chat():# 获取输入参数input_text = request.form['input_text']# ChatGPT处理response = chatbot.chat(input_text)# 返回处理结果return jsonify({'success': True,'response': response})if __name__ == '__main__':app.run(debug=True)

在启动Flask应用后,可以使用以下方式进行在线测试:

curl -X POST http://127.0.0.1:5000/chat -d "input_text=这本书怎么样?"

服务器会返回以下结果:

{"response": "它很有趣味性,推荐阅读。", "success": true

}

可以看到,ChatGPT已经可以正常处理API请求,并返回机器人回答的结果。

总结

通过使用ChatGPT,我们可以快速构建一个中文聊天机器人,并提供API接口用于在线应用。当然,为了实现更好的聊天效果,我们需要收集足够的语料,并对模型进行充分训练和调整。但无论如何,对于许多中小型应用场景,ChatGPT已经提供了一个方便、快速、高效的解决方案。